Google Drive for Desktop ha appena introdotto una funzione che promette di riscrivere il modo in cui pensiamo alla protezione dei file: un motore di rilevamento ransomware basato su intelligenza artificiale, addestrato su milioni di campioni reali, capace di bloccare attività sospette prima che la devastazione si propaghi. È un annuncio che suona come una dichiarazione di guerra digitale, un manifesto in cui Mountain View si autoelegge guardiano dei nostri dati personali e aziendali. Dietro la patina di comunicazione corporate, tuttavia, si nasconde una riflessione più profonda: stiamo delegando sempre più la sopravvivenza dei nostri sistemi all’interpretazione probabilistica di un modello, senza neppure renderci conto delle implicazioni.

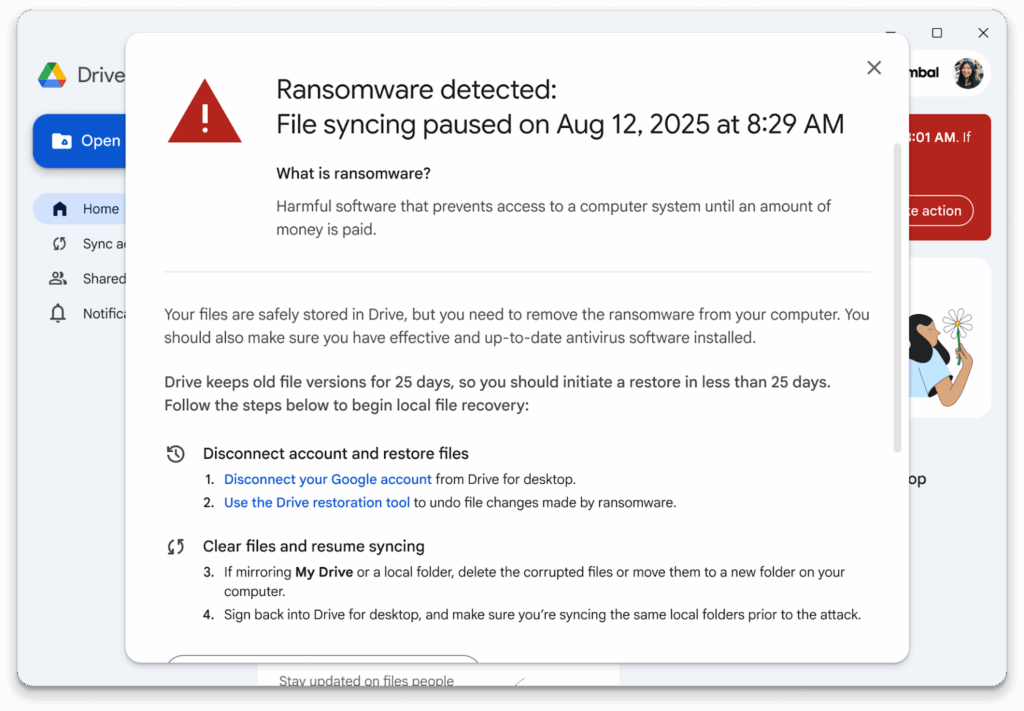

L’AI di Google osserva i file e cerca segnali che indicano una modifica malevola. Non si tratta di magia, ma di analisi statistica, pattern recognition e integrazione con fonti di intelligence come VirusTotal. In pratica, un sistema nervoso digitale che intercetta anomalie nei comportamenti dei file, come cifrature massive o corruzioni improvvise, e decide di interrompere la sincronizzazione prima che sia troppo tardi. L’utente riceve un avviso sul desktop, una notifica via email e l’opzione di ripristinare versioni precedenti. Un approccio quasi paternalistico, che dice: non ti preoccupare, penso io a fermare il danno. È il rovescio della logica che per anni ha dominato la sicurezza IT, dove il dogma era prevenire a monte; qui siamo già dentro l’incendio e Google prova a limitare i danni.

Non mancano le contraddizioni. Da un lato, l’azienda dichiara che il modello si adatta ai nuovi ransomware in modo dinamico, analizzando continuamente i cambiamenti e incorporando nuova intelligence. Dall’altro, nessuno ha ancora pubblicato metriche ufficiali su falsi positivi o falsi negativi, e sappiamo che il diavolo è nei dettagli. Basta un ransomware particolarmente silenzioso o un attacco costruito con varianti ancora sconosciute, e l’intero castello di prevenzione rischia di cadere. È il paradosso di ogni difesa basata su machine learning: potente nel generalizzare, vulnerabile nell’eccezione.

La mossa di Google si colloca in un contesto tutt’altro che rassicurante. I dati dell’Office of the Director of National Intelligence parlano chiaro: nel 2024 si sono registrati 5.289 attacchi ransomware nel mondo, con un incremento del 15 per cento rispetto all’anno precedente. Non un’ondata, ma una costante marea che cresce e si insinua ovunque. Il ransomware è ormai un’industria con supply chain, marketplace e modelli di business degni di startup di successo. In questo scenario, la decisione di Google di inserire un livello di protezione direttamente nel cuore della sua applicazione di sincronizzazione non è un atto filantropico, ma un investimento per blindare la fiducia degli utenti in un prodotto che è diventato infrastruttura critica per milioni di aziende.

Non bisogna dimenticare che Drive non è solo uno strumento di backup, è l’ossatura collaborativa di team globali, il ponte tra individui e organizzazioni. Se improvvisamente i file condivisi diventano ostaggio di un ransomware, non si parla solo di perdite economiche, ma di interruzione totale del lavoro. E in un’epoca in cui le aziende dipendono da piattaforme SaaS per ogni minima attività, il tempo di inattività è letale. Per questo la Google Drive ransomware detection non è semplicemente un’opzione simpatica, ma una feature di sopravvivenza.

La retorica di Google, come sempre, è perfetta: “Abbiamo costruito un modello specializzato, addestrato su milioni di campioni reali, per individuare segnali che indicano modifiche malevole.” La traduzione pratica è che il sistema è un enorme filtro statistico che cerca di distinguere tra un utente che comprime legittimamente un archivio e un malware che inizia a criptare cartelle in serie. Un compito tutt’altro che banale, perché il confine tra attività sospetta e uso legittimo può essere sottile. E qui torna il tema centrale: fidarsi di un modello probabilistico per proteggere ciò che di più critico possediamo, i nostri dati. È come consegnare le chiavi della cassaforte a un algoritmo che decide in autonomia quando chiuderla o aprirla.

Il contesto è ancora più ironico se consideriamo che Google Docs e Sheets, i file nativi della suite, non sono attaccabili nello stesso modo da ransomware locali. Sono già nel cloud, gestiti in formati proprietari che non si prestano a cifrature massive da parte di un malware tradizionale. In altre parole, la protezione più avanzata serve soprattutto ai file legacy, quelli di Word, Excel, PDF e immagini, che ancora rappresentano la stragrande maggioranza del traffico digitale. È un’ammissione implicita: per quanto predichiamo la nuvola, i nostri comportamenti restano ancorati a formati vecchi di decenni, vulnerabili e fragili. L’AI di Google non difende il futuro, difende il passato che non riusciamo ad abbandonare.

C’è poi la questione aziendale. Una notifica via email o desktop va bene per un freelance, ma in un contesto enterprise serve molto di più. Serve integrazione con sistemi di sicurezza centralizzati, serve che l’allarme possa attivare un SIEM o un EDR, serve orchestrazione. Altrimenti l’alert diventa l’ennesima finestra che nessuno legge. Google qui gioca un gioco rischioso: se non garantisce estensioni per le grandi aziende, rischia che la funzione resti un gadget consumer. Ma se invece la integra nei flussi corporate, può diventare un punto di svolta, un argine che evita blackout produttivi e milioni di dollari in perdite.

Gli attacchi ransomware non sono in calo, e non lo saranno presto. La ragione è banale: funzionano. Offrono un ritorno economico veloce agli attaccanti e sfruttano la debolezza intrinseca delle organizzazioni, che preferiscono pagare pur di riprendere l’operatività. Finché il modello di business criminale resta redditizio, la curva rimarrà ascendente. Per questo la Google Drive ransomware detection va letta anche come un segnale politico: una delle Big Tech decide di non aspettare le patch di Microsoft o le difese di terze parti, ma inserisce direttamente un livello AI nella sua pipeline di sincronizzazione. Un colpo basso ai competitor e un avvertimento implicito: se usi il nostro ecosistema, avrai protezione end-to-end; se no, arrangiati.

Naturalmente, il rischio più grande non viene solo dagli hacker, ma dagli errori di percezione. Un falso positivo che blocca la sincronizzazione di file critici in un momento delicato può avere effetti disastrosi quanto un attacco vero. Immaginate un board meeting globale che non riesce ad accedere ai documenti perché il modello ha deciso che un comportamento era sospetto. In quel momento, la fiducia nella piattaforma si incrina. E qui Google cammina su una linea sottilissima: l’AI deve essere abbastanza aggressiva da fermare i veri attacchi, ma non tanto da paralizzare il business degli utenti. È l’eterna tensione tra sicurezza e operatività, ora delegata a un algoritmo.

Questa funzione arriva in open beta e sarà resa disponibile a tutti entro fine anno, ma la vera partita si giocherà nella percezione del pubblico. Gli utenti si sentiranno protetti o si sentiranno sorvegliati? L’AI di Google viene presentata come un guardiano benevolo, ma resta sempre un motore che osserva ogni modifica ai file, e questa consapevolezza potrebbe non piacere a chi già sospetta un eccesso di controllo. È il prezzo da pagare per vivere in un mondo dove il ransomware è diventato la tassa occulta dell’era digitale.

La verità è che la Google Drive ransomware detection non risolve il problema, lo incapsula. Non elimina la minaccia, ma costruisce un muro temporaneo per guadagnare tempo. È come l’airbag in un’auto: non evita l’incidente, ma riduce i danni. La vera sfida resta quella di ripensare i modelli di sicurezza, di educare gli utenti, di ridurre la superficie d’attacco. Fino a quando la nostra vita digitale sarà dipendente da file vulnerabili, ogni AI di protezione sarà solo un palliativo intelligente.

Per chi guida aziende e team tecnologici, la lezione è chiara. Non basta installare l’ultimo strato di difesa sperando che l’AI faccia tutto. Serve governance, serve integrazione con i processi, serve documentare incidenti e risposte, serve cultura. L’AI di Google è uno strumento potente, ma resta uno strumento. Il resto lo deve fare l’uomo, con scelte consapevoli e strategie lungimiranti. In fondo, come diceva un analista di sicurezza con ironia: l’intelligenza artificiale è bravissima a fermare attacchi stupidi, ma contro la stupidità umana non c’è algoritmo che tenga.