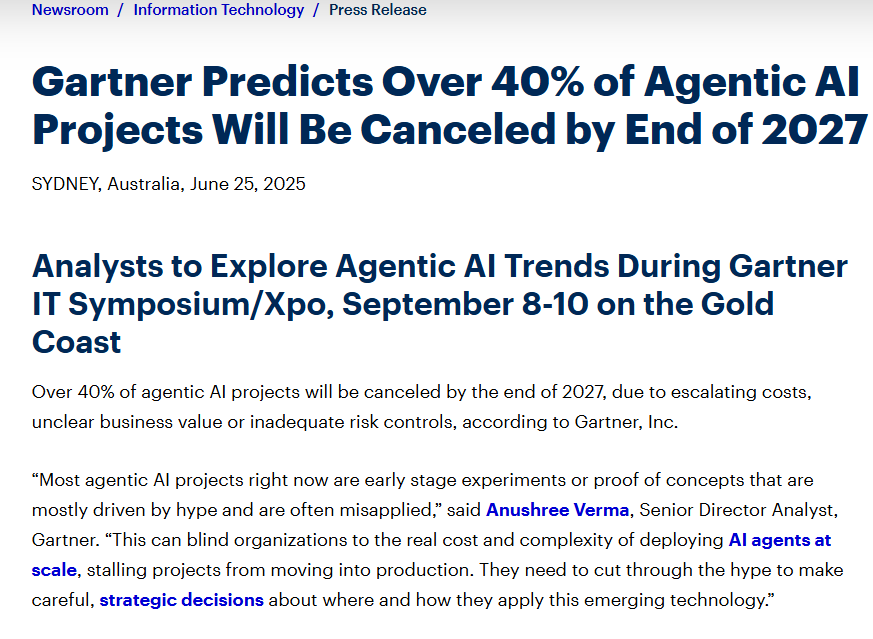

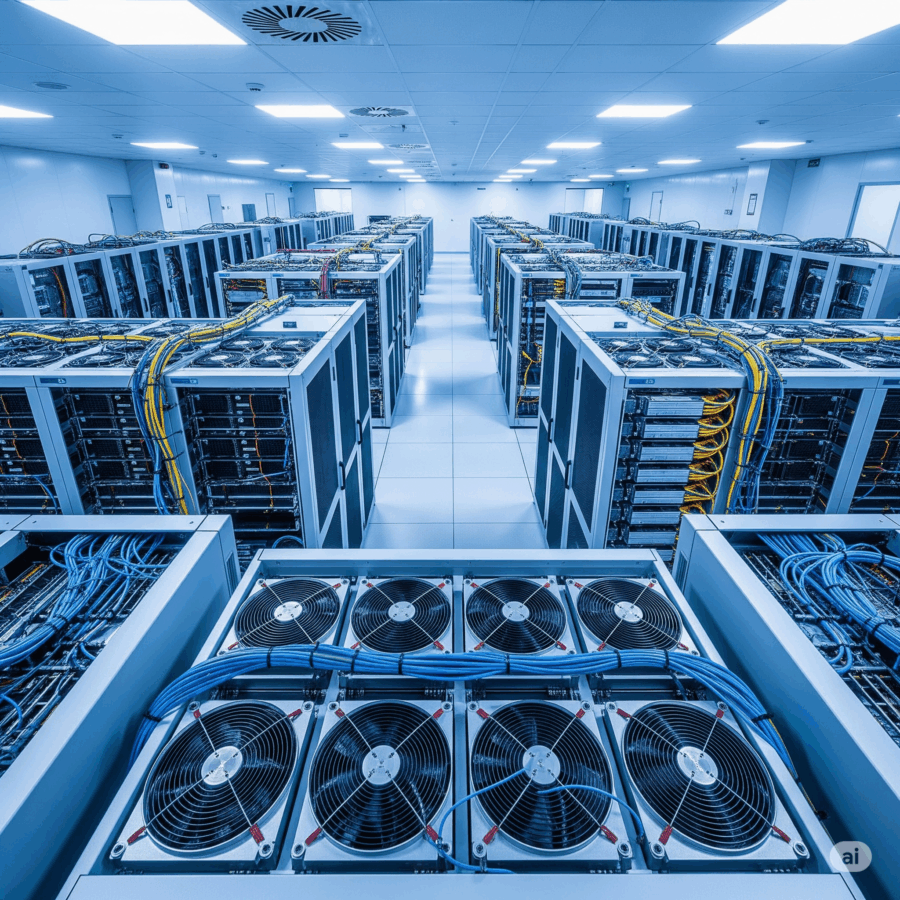

Gartner ha appena tirato giù la maschera sul mito degli agenti AI, e la realtà è molto meno entusiasmante di quanto il marketing tech ci voglia far credere. Un fulmine a ciel sereno: oltre il 40% dei progetti di intelligenza artificiale agentica sarà cancellato entro il 2027. Non è una previsione da lunedì mattina, ma un avvertimento che scuote le fondamenta di chi ha investito a occhi chiusi nel “prossimo grande salto” dell’automazione intelligente.

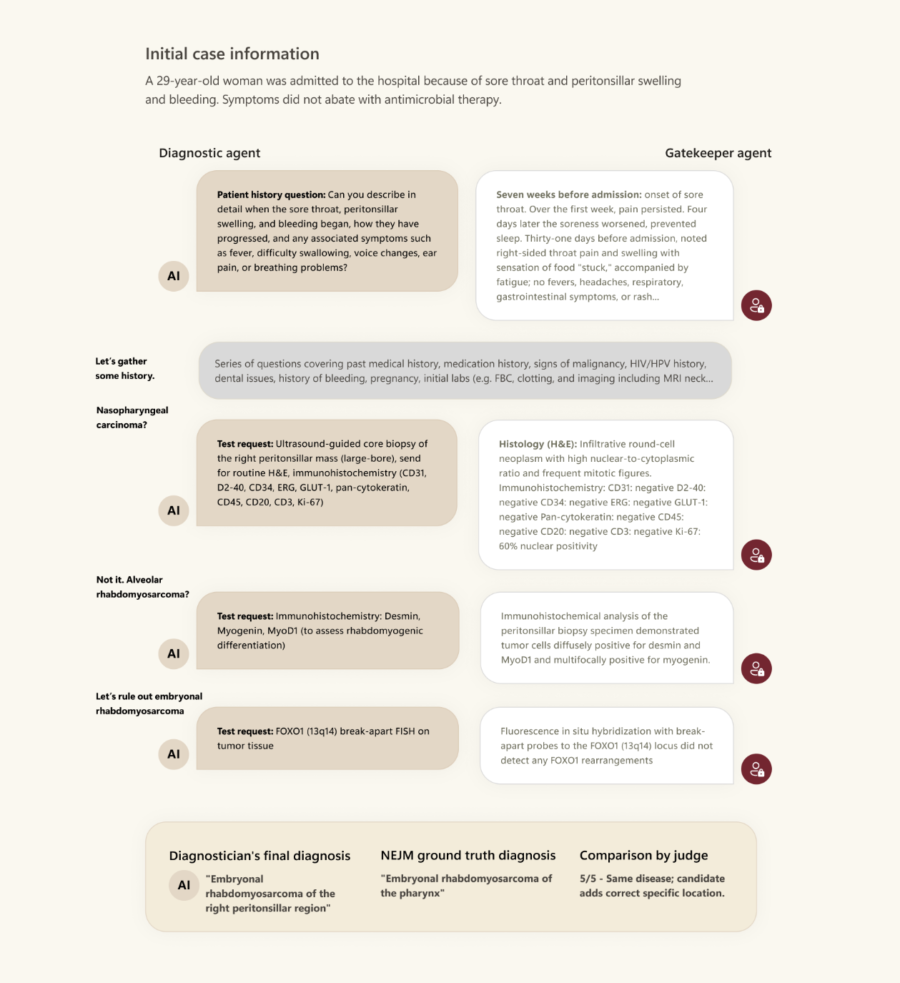

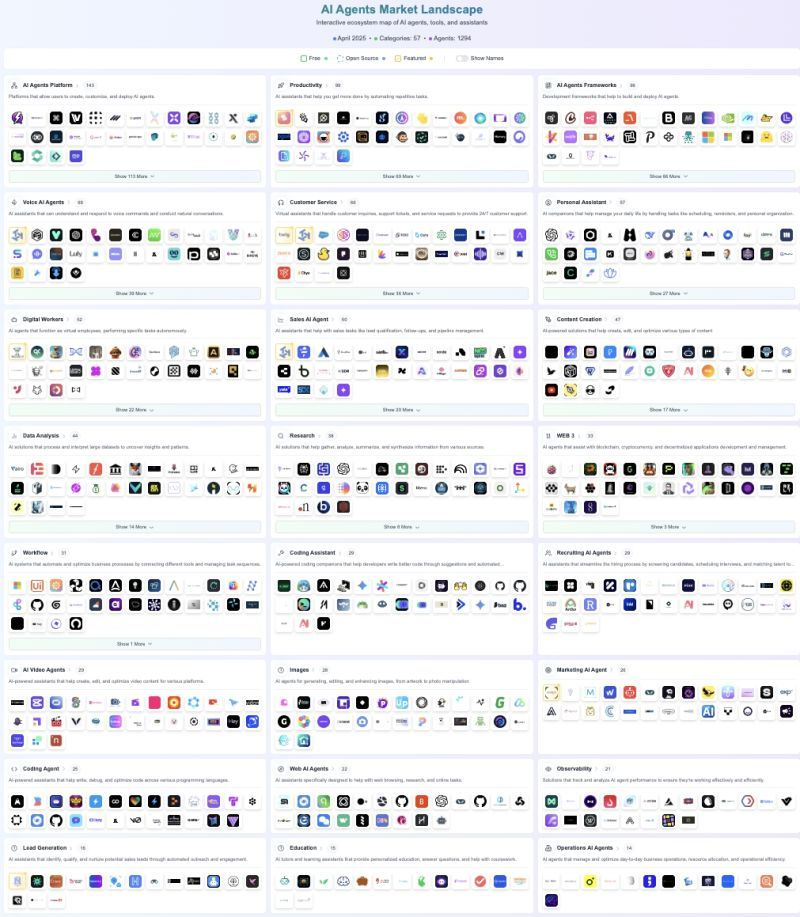

Se pensavate che “agenti AI” significasse robot autonomi che risolvono problemi complessi mentre voi sorseggiate il vostro caffè, beh, è meglio rivedere le aspettative. Gartner parla chiaro: non c’è un ROI chiaro, i costi esplodono e la tecnologia “cool” non regge sotto pressione. Il risultato? Un boom di hype, battezzato con il termine icastico di “agent washing” — roba da rinnovare chat bot o RPA con una semplice etichetta nuova, senza un briciolo di vera intelligenza autonoma.