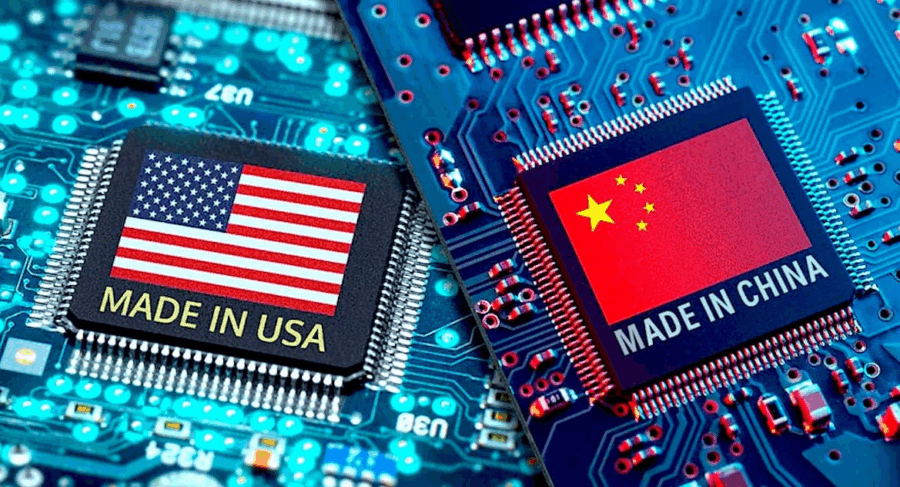

Quando l’America decide di regalare qualcosa alla Cina, non si tratta mai di panda o hamburger. Di solito si tratta di silicio, o meglio, del software che permette a chiunque, ovunque, di disegnare il cuore pulsante del mondo moderno: il chip. Dopo anni di schermaglie tecnologiche, restrizioni e guerre a colpi di export control, gli Stati Uniti hanno improvvisamente deciso di togliere il guinzaglio a Siemens, Synopsys e Cadence, i tre pilastri dell’EDA, ovvero Electronic Design Automation, lasciandoli liberi di vendere i loro strumenti di progettazione di semiconduttori alla Cina. E no, non è uno scherzo. È geopolitica in tempo reale, nella sua versione più sofisticata: quella che si scrive con righe di codice e clausole di licensing.

Categoria: Chip Pagina 1 di 3

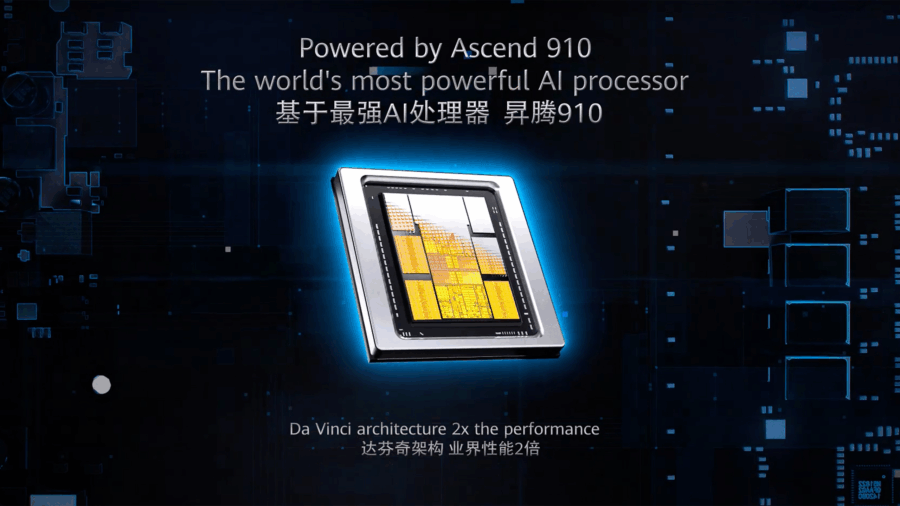

Huawei ha appena rilasciato come open source due modelli della sua famiglia Pangu e una serie di tecnologie di reasoning. Una mossa concertata non per mera filantropia tech ma per collocare i suoi chip Ascend nel cuore di migliaia di servizi enterprise. L’obiettivo è chiaro: chi adotta i modelli Pangu, sempre più ottimizzati solo per Ascend, sarà poi spinto – quasi inevitabilmente – verso l’hardware proprietario Huawei.

La strategia non è solo convoluzione hardware‑software, ma un’architettura verticale simile a quella di Google: chip, software, toolchain, piattaforma cloud. Questo crea un lock-in pesante, attirando milioni di sviluppatori e partner globali. Alla fine apri il modello perché è gratis, ma poi paghi l’integrazione e la performance via Ascend.

Per anni ci siamo raccontati che i dati fossero il nuovo petrolio. Una narrazione comoda, elegante, quasi poetica, che dava un senso alle guerre silenziose combattute a colpi di privacy policy e scraping selvaggi. Ma mentre l’industria dell’intelligenza artificiale entra in una fase muscolare, fatta di centri dati da miliardi e chip che costano quanto miniere d’oro, una nuova verità emerge, brutale e ineludibile: è il compute, non i dati, a decidere chi guida e chi insegue.

Il report di Konstantin Pilz, James M. S., Robi Rahman e Lennart Heim, che analizza oltre 500 supercomputer AI tra il 2019 e il 2025, è una specie di radiografia del cuore pulsante dell’economia cognitiva. Altro che narrativa da laboratorio accademico. Qui si parla di infrastrutture pesanti, di consumi energetici che rivaleggiano con piccole nazioni, e di una concentrazione di potere computazionale che fa impallidire anche i più accaniti critici del capitalismo digitale.

Il trend più impressionante? Le performance di calcolo stanno raddoppiando ogni 9 mesi. Avete letto bene: siamo in un’era in cui la velocità con cui raddoppiano le capacità computazionali supera persino la mitica Legge di Moore. E ogni raddoppio non è un semplice upgrade. È un salto quantico che permette ad alcune entità poche, selezionatissime di costruire modelli sempre più grandi, sempre più potenti, sempre più inaccessibili.

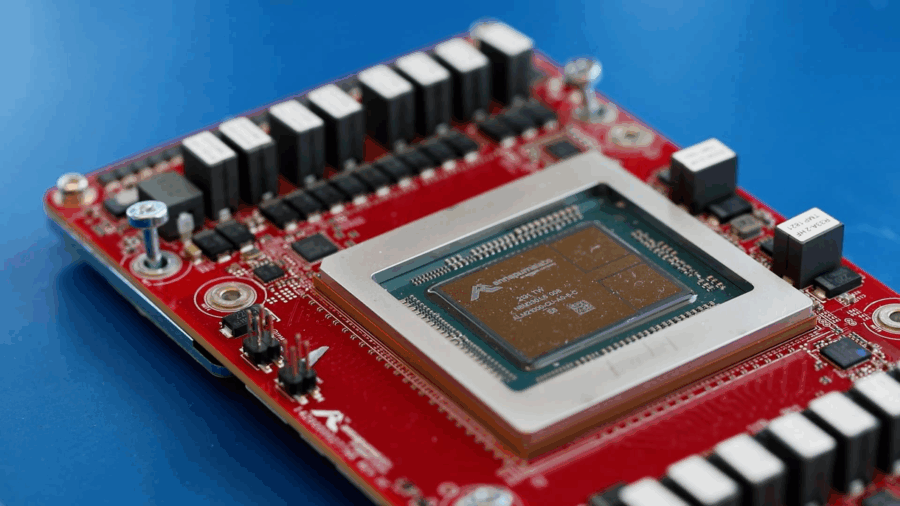

Non chiamatela solo “sostituzione tecnologica”, perché la Cina non sta semplicemente cercando alternative ai chip americani. Sta costruendo un nuovo culto della resilienza artificiale, e lo sta facendo con una determinazione che gronda di strategia industriale, orgoglio sovranista e calcolo geopolitico. La notizia che Sophgo, produttore cinese di semiconduttori, abbia adattato con successo la sua compute card FP300 per far girare il modello di ragionamento DeepSeek R1, non è un semplice annuncio tecnico. È un atto di guerra, anche se siliconica. È l’ennesimo tassello del grande mosaico che Pechino sta costruendo per liberarsi dal giogo delle GPU Nvidia e dall’ecosistema software che, fino a ieri, sembrava imprescindibile per chiunque volesse fare intelligenza artificiale ad alto livello.

Microsoft ha annunciato un ritardo significativo nella produzione del suo chip AI di nuova generazione, Maia, noto anche come Braga. La produzione di massa, inizialmente prevista per il 2025, è stata posticipata al 2026. Secondo quanto riportato da Reuters, la causa principale del ritardo sono stati cambiamenti imprevisti nel design del chip, problemi di personale e un elevato turnover all’interno del team di sviluppo.

Questo ritardo pone Microsoft in una posizione delicata, soprattutto considerando la rapida evoluzione del mercato dei chip AI. Nvidia, con il suo chip Blackwell, ha già stabilito uno standard elevato, e il ritardo di Microsoft potrebbe significare che il chip Maia sarà meno competitivo al momento del lancio.

Se pensavate che la sfida tra colossi dell’intelligenza artificiale fosse solo una questione di algoritmi e modelli, vi siete persi la partita più sottile ma decisiva: quella dell’hardware. OpenAI, da sempre uno dei maggiori clienti di Nvidia, ha iniziato a spostare parte del proprio carico di lavoro verso i chip AI più economici di Google, i celebri TPU (Tensor Processing Unit). Un cambio di rotta che somiglia a una manovra tattica degna di un generale digitale, in una battaglia che si gioca anche – e forse soprattutto – sui costi, sull’efficienza e sul controllo tecnologico.

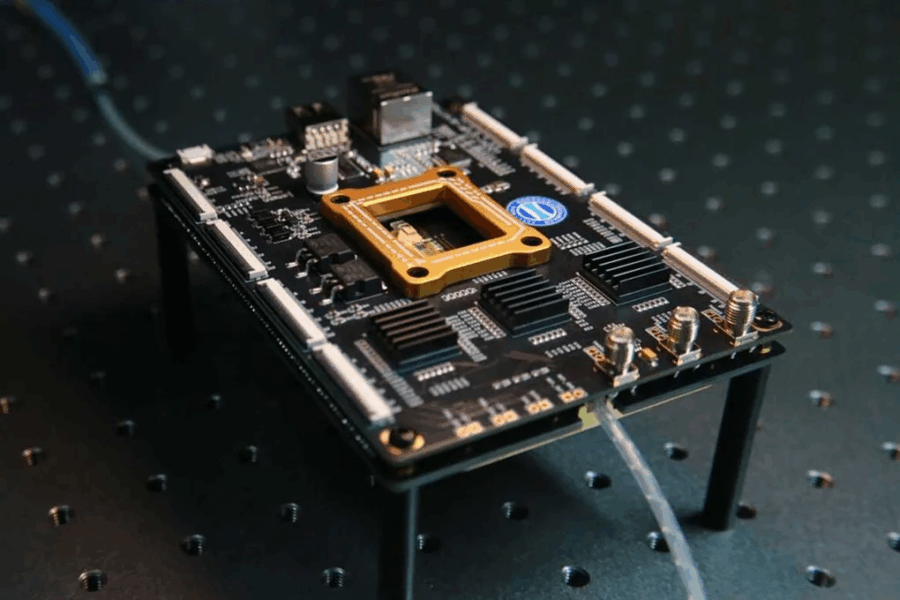

Un nome che suona come un asteroide dallo spazio, ma è l’ultima arma di Pechino nella guerra fredda dei chip: meteor‑1. Messo a punto dal Shanghai Institute of Optics and Fine Mechanics insieme alla Nanyang Technological University, è un chip fotonico ottico “molto parallelo” capace di erogare una potenza teorica di 2 560 TOPS a 50 GHz – numeri che lo piazzano fianco a fianco con le GPU di punta di Nvidia, il cui RTX 4090 arriva a 1 321 TOPS e il più recente RTX 5090 tocca 3 352 TOPS. A qualcuno suona come un colpo di avvertimento.

Nel cortile sempre più ristretto del tech globale, Huawei non solo sopravvive, ma orchestra una sinfonia propria. HarmonyOS 6 non è solo un aggiornamento di sistema operativo. È una dichiarazione di guerra, gentile quanto spietata, al duopolio Apple-Google. Ma, come in ogni opera orientale, l’apparente lentezza del gesto nasconde una potenza zen.

All’annuale Developer Conference, Richard Yu – lo Steve Jobs del delta del fiume delle Perle – ha messo sul tavolo la beta di HarmonyOS 6, insieme a una nuova generazione di agenti AI, i modelli Pangu 5.5 e l’architettura CloudMatrix 384. È il tentativo più ambizioso della compagnia per costruire un ecosistema software cinese a prova di sanzioni statunitensi.

Huawei ha svelato un’architettura che non si limita a rincorrere Nvidia: la scavalca. CloudMatrix 384 è il campo dove 384 NPU Ascend 910C e 192 CPU Kunpeng si uniscono in un “AI supernodo” ad altissima banda, bassa latenza, con bus unificato – nient’altro che una centrale di calcolo su misura per LLM spinti come DeepSeek R1 da 671 miliardi di parametri.

Il documento tecnico rilasciato su arXiv espone numeri che suonano come sfida: fase prefill con 6.688 token/s per NPU su prompt da 4.000 token (4,45 token/s per TFLOPS), fase decode con 1.943 token/s e latenza inferiore a 50 ms per token (1,29 token/s per TFLOPS). Più performante dell’H800 (e perfino dell’H100 in SGLang), dice Huawei, con cifre superiori sia in throughput sia in efficienza reale.

Nel panorama tecnologico odierno, dominato da Nvidia con la sua piattaforma CUDA, Amazon ha deciso di lanciare la sua sfida nel mercato dei chip per l’intelligenza artificiale (AI). Con l’introduzione dei chip personalizzati come Trainium e Inferentia, sviluppati dalla sua controllata Annapurna Labs, Amazon mira a ridurre la dipendenza da fornitori esterni e a offrire soluzioni più economiche e ottimizzate per i carichi di lavoro AI.

Pechino, luglio. Il termometro schizzerà sopra i 35 gradi, ma non sarà solo colpa del clima monsonico. La temperatura vera sarà quella che si respirerà tra gli stand climatizzati della China International Supply Chain Expo, dove – sorpresa? – farà il suo debutto una delle multinazionali americane più sorvegliate dell’era digitale: Nvidia.

Quella Nvidia che Washington tenta di tenere al guinzaglio con regolamenti tagliati su misura, come si fa con un cane che morde troppo forte. Quella Nvidia che, tra un H100 proibito e un H20 castrato, adesso prepara un nuovo giocattolo per Pechino: il B30, una versione “compliant” con le restrizioni americane, un chip in stile Giano bifronte, progettato per obbedire a due padroni che si detestano.

In un’epoca dove i transistor valgono più del petrolio e i wafer hanno il peso geopolitico delle testate nucleari, la mossa di Taiwan sembra più una fiondata al cuore che una formalità amministrativa. Con un aggiornamento della Strategic High-Tech Commodities Entity List, l’Isola ha inserito Huawei Technologies e Semiconductor Manufacturing International Corp (SMIC) in una blacklist che suona più come un ultimatum al Dragone che un banale documento ministeriale.

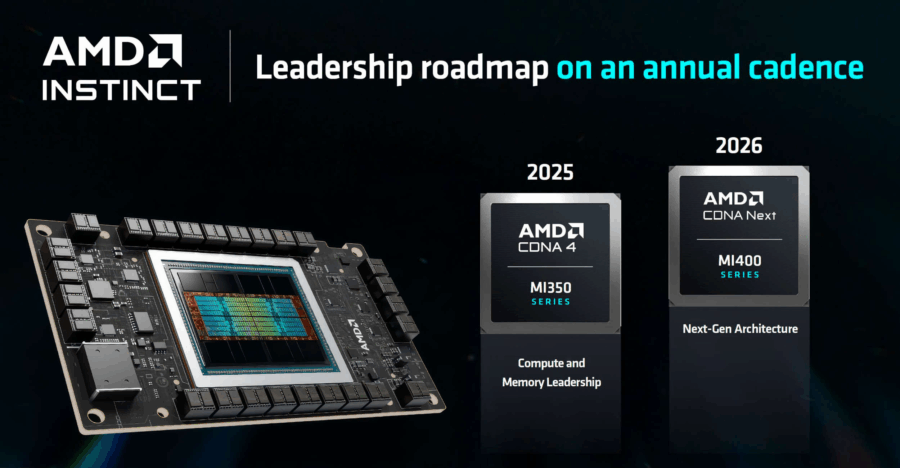

AMD ha acceso i riflettori su sé stessa, ma lo spettacolo vero non era sul palco. Il lancio della nuova serie MI350, celebrata con il solito repertorio di slide scintillanti e testimonial di peso, ha in realtà lasciato il pubblico – e soprattutto gli investitori – con lo sguardo rivolto al futuro. E quel futuro ha un nome: MI400. Un numero, una promessa, forse una scommessa colossale per entrare finalmente nel ring di Nvidia.

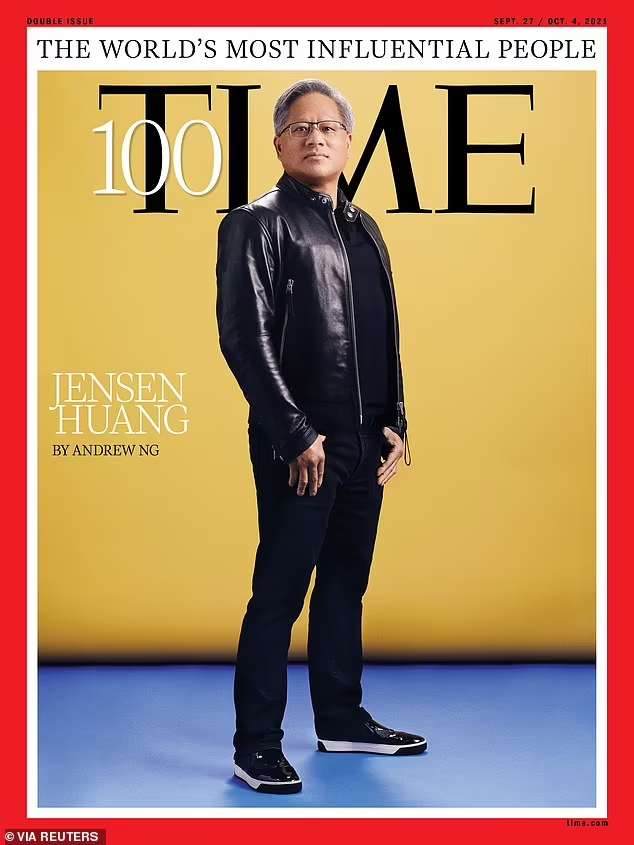

Se fosse davvero così facile costruire chip per l’intelligenza artificiale, allora perché Jensen Huang sembra uscito da un rave tech senza fine, invecchiato di dieci anni in dodici mesi ma ancora in cima alla catena alimentare dell’AI?

Parlando con l’aria stanca ma trionfante a Parigi — la città che ti fa sentire elegante anche quando parli di semiconduttori — il CEO di Nvidia ha mostrato con l’aria di chi la sa lunga che non è minimamente minacciato dal fatto che i suoi clienti più importanti, da Amazon Web Services a Microsoft fino a OpenAI, stiano tentando di fabbricare chip proprietari. Il tono? Mezzo ironico, mezzo “siete tutti i benvenuti a provarci, ma fallirete”.

Lisa Su, CEO di AMD, ha dichiarato che la domanda di inferenza AI crescerà dell’80% all’anno. Ma dietro questa previsione ottimistica si cela una realtà più complessa.

Nel 2024, AMD ha generato oltre 5 miliardi di dollari di entrate dalle sue GPU Instinct, con previsioni di crescita significativa nel segmento AI. Su ha dichiarato che la società prevede che le entrate annuali derivanti dai chip AI raggiungano “decine di miliardi di dollari nei prossimi anni”.

È curioso come il sogno dell’autosufficienza tecnologica finisca spesso per trasformarsi in una beffa amara. Liu Qingfeng, il visionario ma pragmatico chairman di iFlytek, ha ammesso senza troppi giri di parole che affidarsi ai semiconduttori prodotti in Cina continentale – in particolare l’Ascend 910B di Huawei – comporta un ritardo di tre mesi nello sviluppo dei modelli di intelligenza artificiale rispetto all’utilizzo delle ben più mature soluzioni Nvidia. Un piccolo dettaglio che però non frena la sua testardaggine: “Meglio perdere tempo che perdere l’autonomia”, sembra dire, ostinandosi a proseguire sulla strada dei chip locali, malgrado l’inevitabile gap prestazionale.

Nel cuore pulsante della provincia di Jiangsu, a Wuxi, si muove qualcosa che non fa rumore. Nessun sibilo di elettroni, solo la danza silenziosa della luce su wafer di niobato di litio. Benvenuti nel futuro fotonico della Cina, dove CHIPX – una creatura semiaccademica nata dall’ecosistema tentacolare di Shanghai Jiao Tong University – ha appena acceso la macchina del tempo. O meglio, la macchina del sorpasso.

Siamo abituati a pensare ai chip come a microforeste di silicio, una geometria di transistor che obbedisce ai limiti della fisica classica. Eppure, in questo preciso momento, la Cina ha scelto un’altra via: quella dei chip fotonici, dove le informazioni viaggiano sotto forma di luce e non di elettroni, dove la velocità di elaborazione può toccare vette esoteriche, e dove l’Occidente, complice la propria arroganza sanzionatoria, rischia di restare al palo.

Huawei, il colosso cinese delle telecomunicazioni che da anni è sotto l’occhio del ciclone geopolitico, ammette candidamente un fatto che fa tremare gli ingenui. I suoi chip Ascend, per quanto presentati come meraviglie della tecnologia, sono ancora “una generazione” dietro quelli statunitensi. Ma attenzione: non è la fine del mondo, né la resa incondizionata di Pechino alla supremazia tecnologica d’oltreoceano. Anzi, l’arte di arrangiarsi con metodi “non convenzionali” come stacking e clustering promette performance paragonabili ai giganti del settore. Una magia tutta cinese, fatta di impilamenti di chiplet brevettati che rendono il processore più compatto, più furbo, più scalabile.

Questa confessione arriva direttamente da Ren Zhengfei, il fondatore di Huawei, nel contesto di un’intervista di copertina sul People’s Daily, l’organo ufficiale del Partito Comunista. Primo a rompere il silenzio dopo il lancio di ChatGPT e la nuova ondata di sanzioni USA, Ren non si limita a una difesa d’ufficio. Non nasconde le difficoltà e riconosce che la tecnologia made in USA è “una generazione avanti”, ma rivendica con veemenza la capacità della Cina di colmare il gap con ingegnose soluzioni tecniche. E, soprattutto, sottolinea la forza di un ecosistema nazionale che ha ben altri vantaggi competitivi: centinaia di milioni di giovani, una rete elettrica robusta e una infrastruttura di telecomunicazioni che, a suo dire, è la più sviluppata al mondo.

Immaginate un cervello che non ragiona più solo in 0 e 1, ma anche in forse, chissà, probabilmente. Per decenni, l’informatica è stata una religione binaria, fondata sull’assioma del “sì o no”, “vero o falso”, “0 o 1”. Adesso, dalla Cina, arriva un’eresia. Un chip non-binario, un ibrido tra l’efficienza spietata del silicio e la mollezza stocastica della probabilità. Una via di mezzo tra il calcolo deterministico e il caos quantistico. Con buona pace di Turing, Von Neumann e – sì – del Dipartimento del Commercio degli Stati Uniti.

Non è una provocazione teorica. È un’applicazione industriale su larga scala. Il primo al mondo. Ed è cinese.

Dietro il colpo di teatro c’è il professor Li Hongge della Beihang University, che ha orchestrato la mossa in pieno stile go – il gioco da tavolo orientale che privilegia la strategia lenta, le mosse indirette, il controllo degli spazi vuoti. La sua arma segreta? Un sistema numerico chiamato Hybrid Stochastic Number (HSN). Un matrimonio poco ortodosso tra numeri binari e logica probabilistica. L’obiettivo? Scavalcare due ostacoli architettonici che da anni tengono in ostaggio il progresso del computing: il power wall e l’architecture wall.

Il settore più noioso dell’alta tecnologia – il software per la progettazione dei chip – si è trasformato nel protagonista indiscusso della nuova guerra fredda. E no, non è un’esagerazione giornalistica.

Quando Washington ha ordinato a Cadence, Synopsys e Siemens EDA di smettere di vendere in Cina, la notizia non ha fatto solo tremare i server di Pechino: ha acceso una miccia nella borsa di Shenzhen. Perché? Perché l’EDA, quell’oscuro acronimo che significa Electronic Design Automation, è letteralmente il software che pensa i chip, li disegna, li simula, li testa. Senza EDA non c’è chip. Senza chip non c’è AI. Senza AI non c’è dominio tecnologico. E senza dominio, in questo secolo, sei solo un gigantesco mercato di consumatori.

Pochi bit, molta guerra. Altro che microchip: qui si gioca a Risiko con le chiavi della civiltà digitale. Synopsys, colosso americano del software per il design di semiconduttori, ha appena dato un bel calcio al tavolo cinese. Un’email interna, nemmeno troppo criptica, ha ordinato lo stop immediato a vendite, servizi e nuovi ordini in Cina. Nessun dettaglio sfuggito a una comunicazione ufficiale. Nessun giro di parole. Dal 29 maggio 2025, blackout totale. Perché? Perché gli USA hanno aggiornato le “regole del gioco” e, come sempre, chi ha il pallone decide chi può giocare.

Non lo dicono ancora ufficialmente, ma la tensione è palpabile. Nvidia è finita nel mezzo di una guerra che non ha voluto combattere, ma da cui non può uscire. Il gigante dell’intelligenza artificiale, la fabbrica di chip più ambita del pianeta, ha appena fatto una mezza ammissione: il chip AI per la Cina non è pronto. Tradotto: l’America ha colpito, e Nvidia sta ancora cercando di capire dove sanguina.

Jensen Huang, CEO con la giacca di pelle e lo sguardo da filosofo californiano, lo ha detto durante l’ultima earnings call con la freddezza tipica di chi sa che ogni parola sarà sezionata da analisti, burocrati e lupi di Wall Street. “Non abbiamo nulla da annunciare al momento”, ha detto, lasciando intendere che qualcosa bolle in pentola, ma che per ora il fuoco è spento. O meglio: bloccato da Washington.

Nel teatro geopolitico dei semiconduttori, dove si combatte con wafer e transistor invece che con baionette e bandiere, Nvidia si presenta come quel personaggio improbabile che, pur zoppicando vistosamente, arriva comunque primo al traguardo. Sì, perché l’azienda guidata da Jensen Huang si è appena vista sfilare dal tavolo cinese 8 miliardi di dollari come se niente fosse, per effetto dei nuovi controlli sulle esportazioni imposti da Washington, eppure… il trimestre vola. E non vola a caso: +50% sul fatturato anno su anno, previsione a 45 miliardi. In pratica, Nvidia stampa soldi anche quando dovrebbe affogare.

Questa è la nuova aritmetica del capitalismo AI-driven: puoi perdere un intero mercato (la Cina) e continuare a macinare record su record. Il segreto? Semplice: essere l’unico spacciatore autorizzato di droga computazionale per i modelli linguistici di nuova generazione. Loro hanno gli H100, tu no. Fine della discussione.

Trump ha detto no. Il Deep State del chip ha risposto: “Ok, ma solo fino alla prossima trimestrale.”

È il genere di teatro geopolitico che solo il capitalismo terminale può offrire con così tanta grazia grottesca. Mentre la Casa Bianca chiude i rubinetti tecnologici alla Cina, Nvidia – il dio monoculare dell’AI moderno – continua a macinare utili con la naturalezza con cui un server Apache gestisce richieste: freddamente, incessantemente, incurante del contesto.

Il blocco dei chip AI verso Pechino è stato sbandierato da Trump come una mossa patriottica, un colpo di karate economico alla gola dell’intelligenza artificiale cinese. In realtà, è servito a ben poco: Nvidia ha appena pubblicato numeri talmente buoni da far arrossire persino Cupertino e Mountain View. 26 miliardi di free cash flow in un solo trimestre. Roba che nemmeno la somma di Apple e Google riesce a replicare. E mentre la Cina scompare dalla mappa delle vendite (con un buco dichiarato di 10,5 miliardi su due trimestri), gli USA e i loro alleati tecnologici si accalcano a comprare ogni singolo transistor disponibile.

La notizia, riportata con toni trionfali da metà stampa europea, è che Taiwan Semiconductor Manufacturing Company l’indiscusso Leviatano della produzione globale di chip ha deciso di piazzare il suo primo Design Centre nel cuore pulsante della Germania tecnoindustriale: Monaco di Baviera. C’è chi parla di svolta, chi di “autonomia strategica europea”, chi ancora di “rivincita contro Cina e USA”. La realtà, però, è meno poetica e molto più cinica: l’Europa sta solo comprando un biglietto in economy su un aereo che vola da anni verso l’intelligenza artificiale.

Il centro progettuale TSMC, attivo dal terzo trimestre 2025, sarà dedicato a sviluppare chip “high-density, high-performance, energy-efficient” per settori nobili come l’automotive, l’industriale, l’IoT e, ovviamente, l’AI. Ma attenzione: progettare non significa produrre, e soprattutto non significa decidere.

Il mondo delle tecnologie avanzate, dove ogni dichiarazione di un colosso come Xiaomi diventa un campo di battaglia di parole, brevetti e sogni di autonomia. L’ultimo episodio? La presunta “dipendenza” dal chip Arm nel nuovissimo XRing O1 da 3 nanometri. Leggenda metropolitana, o realtà da marketing? Xiaomi non ci sta e, con un tono che sfiora il cinismo, spazza via le illazioni con la forza di chi conosce i segreti di un mercato spietato.

Partiamo dal nocciolo: il chip XRing O1 utilizza, sì, i core Cortex-X925, A725 e A520 di Arm, ma Xiaomi tiene a precisare che non si tratta di una soluzione pronta e su misura fornita da Arm. È un po’ come dire che hai comprato un motore Ferrari, ma hai costruito da zero la carrozzeria, l’elettronica e persino il telaio. Quindi, stop alle teorie complottiste di un chip “personalizzato” da Arm: il lavoro sporco e creativo è tutto made in Xiaomi, e la società non ha badato a spese, investendo quattro anni di ricerca e sviluppo per mettere a punto un SoC che possa seriamente giocarsela con Apple, Samsung e Huawei.

Ogni epoca ha il suo Golia, e ogni Golia ha bisogno di un Davide con una fionda ben calibrata. Oggi il Golia si chiama Nvidia, l’onnipotente fornitore di GPU che domina l’intelligenza artificiale globale come un monarca assoluto. E il Davide? Beh, si chiama Huawei, che con una fionda chiamata Supernode 384 mira dritto alla fronte del monopolio siliconico a stelle e strisce.

Siamo nel cuore pulsante dell’era dell’intelligenza artificiale generativa, dove non vince il chip più potente, ma l’architettura più scalabile. Ed è qui che Huawei ha lanciato la sua controffensiva silenziosa, elegante e profondamente cinica. Non potendo più importare semiconduttori avanzati dagli Stati Uniti per via delle sanzioni, ha deciso di sovvertire il paradigma stesso dell’infrastruttura di calcolo.

Non è più una questione di prompt engineering. È la resa dei conti tra l’addestramento supervisionato e l’autodidattica brutale delle macchine. NVIDIA ha rilasciato AceReason-Nemotron, e non è un’altra versione pompata di ChatGPT o un clone open source a metà cottura. Qui siamo davanti a una nuova filosofia di intelligenza artificiale: quella che sbaglia, soffre, migliora. Un’IA che diventa ragionevole solo dopo essersi schiantata migliaia di volte contro il muro del fallimento. E no, non è una metafora: l’hanno lasciata lì, a soffrire in solitaria, ad affrontare esercizi matematici e problemi di programmazione senza nessuna babysitter supervisionata.

Ogni volta che Nvidia prova a vendere un chip in Cina, gli USA glielo strappano via come un osso al cane. Ma il cane, questa volta, torna con un osso più piccolo. È il nuovo chip AI basato su architettura Blackwell, pensato appositamente per la Cina un Frankenstein tecnologico mutilato e venduto a un prezzo “di compromesso” tra $6.500 e $8.000. Una farsa high-tech, un altro episodio nella tragicommedia della Guerra Fredda digitale che Silicon Valley e Pechino continuano a recitare a soggetto.

La keyword qui è chip AI Nvidia Cina, ma non aspettarti miracoli di potenza. Questo giocattolino una versione castrata e semplificata del celebrato H20 è l’unico modo che Nvidia ha per non scomparire del tutto da un mercato che, fino al 2022, rappresentava il 95% del suo market share locale. Oggi? Solo il 50%. E Jensen Huang, il CEO col look da rockstar del deep learning, lo ha detto chiaro: “Se continua così, regaliamo il mercato a Huawei”.

Quando il CEO di Xiaomi, Lei Jun, si alza sul palco e proclama che lo XRing O1 è “molto potente”, il mondo tecnologico sa che sta per arrivare uno di quei momenti che rimbombano nei laboratori di Cupertino e nelle camere bianche di Taiwan. Lo dice con quella sicurezza che solo chi ha bruciato miliardi di yuan può permettersi. E lo dice proprio mentre mostra un chip che, a detta dei benchmark presentati, avrebbe superato — sì, proprio superato l’A18 Pro di Apple. Hai capito, Tim?

La keyword qui è “chip Xiaomi”, le secondarie obbligate sono “XRing O1” e “processore 3nm”, il tutto incastonato in un contesto che puzza di geopolitica, siliconi e una certa vendetta orientale ben pianificata.

Quando un CEO di Silicon Valley smette di usare il linguaggio patinato da earnings call e inizia a parlare come un barista incazzato al terzo giro di bourbon, forse è il momento di ascoltare. Jensen Huang, patron di Nvidia, non è certo noto per le mezze misure, ma stavolta ha deciso di strappare direttamente il copione della diplomazia e dire le cose come stanno: i controlli sulle esportazioni di chip AI verso la Cina? Un boomerang perfetto. Un’idiozia geopolitica camuffata da strategia.

AMD, nel ruolo sempre più teatrale del protagonista che finge di non volere il potere mentre lo accarezza in silenzio, ha chiuso un’operazione che è tutto tranne che banale: ha venduto la divisione manifatturiera di ZT Systems a Sanmina (NASDAQ:SANM) per 3 miliardi di dollari. Di questi, 2,55 miliardi arrivano subito, tra contanti e azioni, mentre il restov450 milioni di earn-out dipende dai soliti “se tutto va bene” dei prossimi tre anni. Tradotto: AMD ha appena fatto il taglio chirurgico di un ramo secco, ma ha tenuto per sé il midollo.

Nel meraviglioso mondo delle “rivoluzioni da conferenza stampa”, Xiaomi ha appena sparato il suo missile più lucido: il system-on-a-chip XRing O1 da 3 nanometri. Un nome che pare uscito da una fanfiction tra Cyberpunk 2077 e un catalogo AliExpress. Annunciato con toni messianici da Lei Jun su Weibo, il nuovo SoC alimenterà gli imminenti 15S Pro e Pad 7 Ultra. Ma attenzione: dietro il linguaggio trionfalistico si nasconde una delle più sottili operazioni di comunicazione tecnologica degli ultimi anni, degna di un’analisi tra ingegneria e geopolitica.

Xiaomi, il brand che fino a ieri associavi a powerbank economici, telefoni che “sembrano un iPhone ma costano un terzo” e gadget da geek nostalgico, ora si sveglia e punta dritto al cuore del potere tecnologico globale: i semiconduttori. E non chip qualunque: stiamo parlando di un processore a 3 nanometri, progettato in casa, che dovrebbe diventare il più potente mai sviluppato in Cina per uno smartphone.

Non è solo un salto tecnico. È una dichiarazione di guerra commerciale, geopolitica, culturale. E come spesso accade in questi contesti, i numeri fanno da cornice, ma la vera partita si gioca tra linee di codice e litografia estrema.

Quando si dice “la terza è quella buona”, si dovrebbe aggiungere: solo se il petroldollaro ti benedice. E infatti, eccola lì, Qualcomm, che dopo anni passati a leccarsi le ferite nel mercato dei data center, si riaffaccia sulla scena. Ma stavolta non gioca da sola. No, stavolta c’è Humain, una start-up saudita creata per cavalcare la tigre dell’intelligenza artificiale. Una tigre addomesticata a suon di miliardi e alleanze strategiche.

La notizia è passata sottotraccia, come succede spesso con le cose davvero interessanti. Mentre l’intero circo mediatico si concentrava sui comunicati stampa rilasciati dalla Casa Bianca e dalle big tech al seguito del presidente Trump in Medio Oriente, Qualcomm ha lasciato cadere il suo annuncio con nonchalance: “Stiamo tornando nel mondo dei chip per data center AI. E partiremo da Riyadh.”

Jensen Huang, col suo look da rockstar della Silicon Valley e lo sguardo da profeta che vede l’infrastruttura del futuro, ha fatto una dichiarazione che, seppur elegantemente rivestita di “collaborazione”, puzza di resa strategica quanto basta: Nvidia apre le porte a chi prima stava fuori. NVLink Fusion, questa nuova trovata tecnologica annunciata con enfasi, è un cambio di paradigma. Ed è un cambio dettato dalla paura.

Il cuore dell’intelligenza artificiale batte in silicio. Non a Pechino, non a San Francisco, ma nei wafer da 7 nanometri che si agitano nei datacenter. E proprio lì, nei templi della computazione moderna, la Cina si ritrova ad arrancare. Non per mancanza di cervelli o ambizioni quelle abbondano ma per una cronica e crescente carenza di GPU avanzate, il carburante essenziale per l’addestramento di modelli generativi e large language model (LLM). Tradotto in linguaggio meno tecnico: puoi anche avere il miglior team di fisici, linguisti e data scientist del paese, ma se li metti a lavorare con processori di seconda mano, faranno miracoli solo nei comunicati stampa.

Wang Qi, vice di Tencent Cloud, lo dice senza troppi giri di parole: “Il problema più grave sono le schede grafiche e le risorse computazionali.” In altre parole, la Cina è seduta al tavolo del deep learning con le bacchette rotte. Non che manchino gli investimenti Tencent ha appena chiuso il miglior trimestre della sua storia con 180 miliardi di yuan ma i soldi, in questa partita, servono a poco se non puoi spenderli per acquistare il metallo giusto.

Se pensavi che la geopolitica del silicio si giocasse solo a colpi di fabbriche taiwanesi, è il momento di aggiornare il firmware. Otto parlamentari americani, bipartisan per finta ma bellicosi per davvero, hanno introdotto alla Camera USA il Chip Security Act, un gioiellino legislativo che impone ai produttori di chip AI – sì, Nvidia in primis – di integrare meccanismi di tracciamento geografico direttamente nei loro chip prima di spedirli all’estero.

La parola chiave è controllo. Quelle secondarie? esportazione e Nvidia. E intorno a queste orbita un intero universo di paranoia americana, di interessi industriali spacciati per valori democratici, e di lotta per la supremazia computazionale che oggi ha un solo nome: Intelligenza Artificiale.

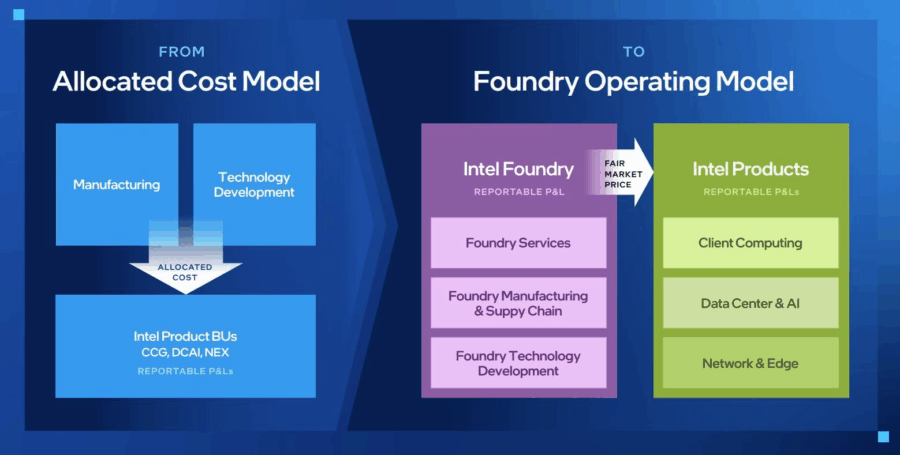

Intel Foundry. Suona bene, vero? Sembra qualcosa di epico, industriale, solido. Ma come direbbe il barista sotto casa mia: “bella l’insegna, peccato che dentro vendono fumo”. Perché il gigante di Santa Clara, quello che dominava i microprocessori come un dio greco ubriaco di silicio, oggi arranca come un pachiderma con le ginocchia rotte nel tentativo disperato di diventare il TSMC d’Occidente. E no, la keyword principale non è “successo”, ma committed volume, o meglio, la sua totale irrilevanza.

David Zinsner, il CFO con lo sguardo fisso e il lessico da medico legale, l’ha detto chiaro a Boston durante la J.P. Morgan Global Technology Conference: i volumi confermati da clienti esterni per la futura tecnologia produttiva di Intel sono “non significativi”. Tradotto dal gergo da conferenza: non ci sta credendo nessuno. E sì, a livello semantico siamo immersi fino al collo nelle parole chiave: foundry model, chip AI, 18A node… Tutte belle etichette per un contenuto reale che al momento fa acqua da tutte le parti.

Shenzhen, una delle metropoli tecnologiche più influenti della Cina, ha recentemente lanciato un fondo interamente dedicato al settore dei semiconduttori, con una dotazione iniziale di 5 miliardi di yuan (circa 692,5 milioni di dollari). Questo fondo, chiamato Saimi (pronunciato “semi”, come i semiconduttori stessi), è gestito dalla Shenzhen Capital Group, un’agenzia statale, ed è un chiaro segnale del tentativo della città di rafforzare l’autosufficienza tecnologica del paese, in un contesto geopolitico teso, soprattutto con gli Stati Uniti. Sembra che Shenzhen stia preparando una partita ad alto rischio, ma sicuramente non una battaglia impari.