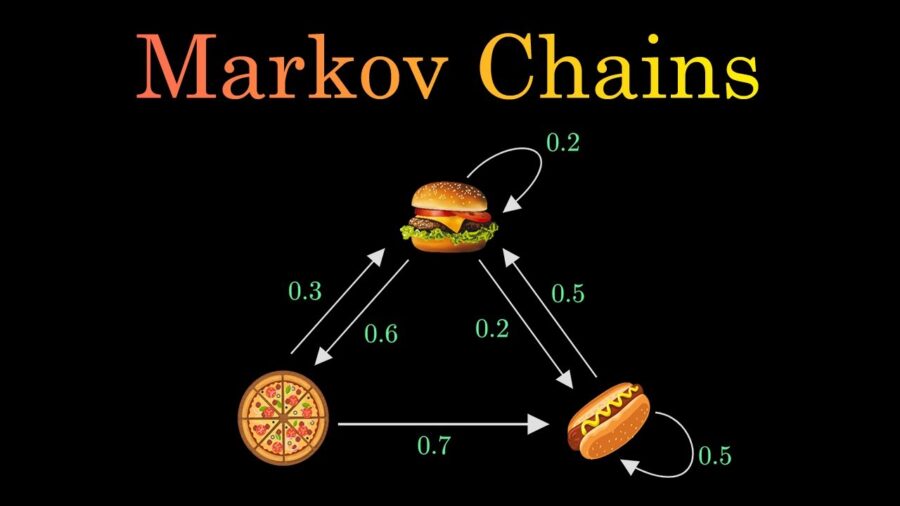

I Large Language Models non sono entità magiche. Non sono “intelligenza” nel senso romantico del termine, e chi continua a raccontare che “ragionano” dovrebbe forse frequentare un corso accelerato di teoria delle probabilità. Il nuovo lavoro di Zekri e colleghi, che mette in relazione i modelli linguistici con le catene di Markov, è una di quelle ricerche che divide il pubblico in due: chi finalmente sospira un “era ora” e chi, terrorizzato, si accorge che tutta la narrativa da Silicon Valley sulla “creatività artificiale” rischia di sgretolarsi come un castello di sabbia davanti alla marea della matematica.