Sono qui! Stanno arrivando! Conquista autonoma dei processi! Rivoluzione del lavoro! Apocalisse dell’impiegato! Tranquilli, è tutta una messa in scena. O meglio, è teatro finanziato con entusiasmo da board aziendali in crisi esistenziale, che sognano di tagliare teste (umane) per sostituirle con algoritmi “auto-motivati”. Ma come sempre: tanto fumo, pochissimo arrosto.

No, Agentic AI non esiste. Non nel senso vero, tecnico, empirico. Non esiste un solo sistema in produzione nemmeno uno che stabilisca da solo i propri obiettivi, si adatti in tempo reale e consegni risultati concreti senza supervisione umana. Zero. Nada. Un po’ come cercare il Santo Graal nel backlog di Jira. Quello che abbiamo? Script orchestrati con GPT tipo AutoGPT o CrewAI, un po’ di prototipi in sandbox, demo patinate per impressionare gli stakeholder. Ma agenti cognitivi reali, autonomi? Solo nei pitch deck e nei thread su LinkedIn scritti alle 3 di notte da “visionari seriali”.

In effetti, basta scavare sotto la superficie per trovare la solita minestra: fallimenti sistemici, errori banali, loop infiniti e allucinazioni logiche che sembrano uscite da un film di David Lynch. Uno studio Stanford/DeepMind ha rilevato che questi agenti generativi falliscono oltre l’80% delle volte nei task di base. Meta stessa, in un benchmark interno, li ha liquidati con parole poco tenere: niente memoria, niente pianificazione, zero grounding. Tradotto per il bar: peggio di uno stagista distratto al primo giorno.

Wooldridge, M. (2023). Autonomous Agents: Myths vs. Reality. Oxford CS.

E la parte più divertente? Le aziende ci stanno buttando milioni. Sì, milioni veri, soldi reali, non quelli del Monopoly. Workshop sull’“agent readiness”, roadmap con KPI inventati, consulenze da boutique firm con slide animate che parlano di sinergie tra agenti e org design. Un’altra puntata della serie “Come spendere un budget IT senza capirci niente”.

Nel frattempo, il 70% dei progetti di automazione GenAI vengono abortiti dopo qualche sprint. Silenziosamente, senza comunicati stampa. La task force “AI Transformation” scompare come il team blockchain nel 2018. Non è un caso. I GPT, oggi, hanno errori superiori al 50% su compiti di ragionamento complesso. Inventano fonti, creano persone, falsificano dati. Non sono safe by design, come confermano i red team interni. E soprattutto: non sono autonomi. Al massimo, sono stanchi aiutanti digitali che hanno bisogno di babysitting costante.

Ma il vero colpo di scena è che, spesso, le persone “sostituite” da queste soluzioni vengono richiamate a gestire proprio l’AI che le aveva teoricamente mandate a casa. Kafka meets Agile.

Ora, se ti dicessi che niente di buono sta accadendo, ti mentirei. In un 1% ben isolato, qualcosa di interessante sta effettivamente prendendo forma. Ma sono casi di laboratorio, con condizioni ultra-controllate, obiettivi ristretti, ambienti simulati e supervisione umana permanente. Nessuna esposizione diretta a clienti, nessun impatto su sistemi mission-critical. È come dire che l’auto a guida autonoma funziona perfettamente… su un binario.

Eppure, l’aria è piena di fumo. Hype-as-a-Service: il vero core business della nuova ondata AI. Le metriche? Inventate. Le demo? Truccate. Gli use case? Forzati. La paura? Costruita ad arte. Perché fa vendere. Fa firmare contratti. Fa girare le ruote del capitalismo tecnologico in modalità “fuffa con margini altissimi”.

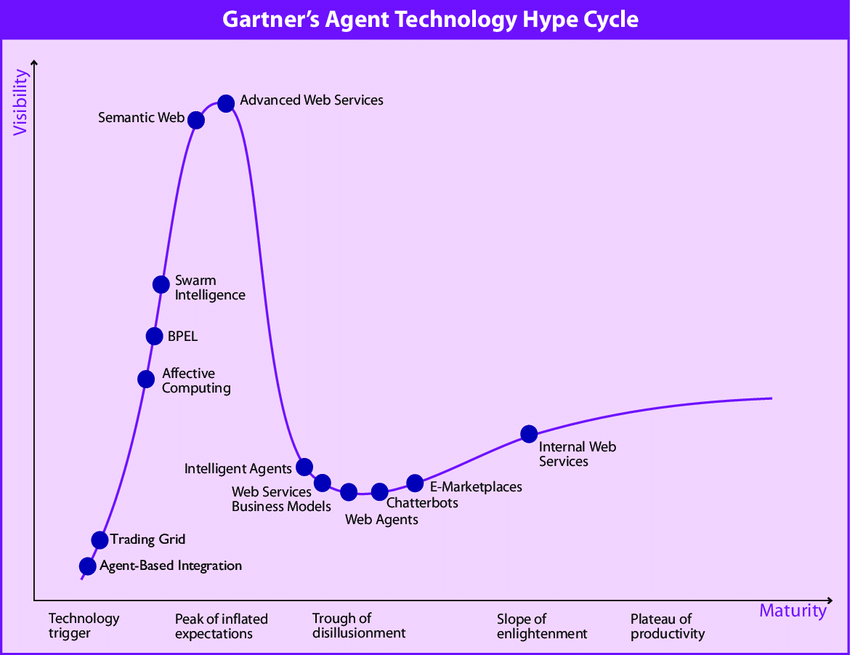

Certo, prima o poi gli agenti semi-autonomi funzioneranno. Ma non oggi, non domani, e sicuramente non dentro la tua intranet con policy legacy del 2012 e un reparto IT che ancora fatica con le patch di sicurezza. Servirà tempo, ricerca seria, esperimenti realistici e una sana disillusione.

Nel frattempo, l’unico agente veramente autonomo è il consulente che ti vende l’idea che gli agenti autonomi esistano. Quello sì che non ha bisogno di supervisione. Ha solo bisogno della tua firma.

La prossima volta che senti dire “abbiamo implementato agenti GPT che gestiscono processi in autonomia”, chiedi: “Davvero? In produzione? Su dati reali? Senza umani in loop? Per quanto tempo?” Osserva il silenzio imbarazzato. Poi annuisci, ordina un caffè e cambia fornitore.

La vera minaccia, oggi, non è l’AI autonoma. È l’autonomia del nonsense travestito da innovazione. Il vero pericolo non sono gli agenti. Sono gli agenti del marketing AI-powered.

Quindi no, gli agenti non ti faranno del male. Ma se vuoi scappare da qualcosa, scappa dall’hype. Quella sì che è roba letale e affidati a gente seria, cè nè.

Park et al. (2023). Generative Agents. Stanford + Google DeepMind.

Meta AI Research (2024). AgentBench Internal. Leaked via AI Snake Oil.

MIT Tech Review (2024). Enterprise GenAI Pilots Quietly Abandoned.

UChicago/NBER (2024). GPT Workflow Accuracy in Real Use Cases.

OpenAI (2023). GPT-4 System Card.

Google DeepMind (2024). Red Teaming Large Language Models.

Microsoft AutoDev, AlpacaFarm, Toolformer—all rely on constrained conditions + human input.