Interessante Analisi da Stanford (SALT).

La Silicon Valley ha parlato, e come spesso accade, nessuno ha chiesto agli interessati. Mentre i capitali si riversano a miliardi su “agenti AI” pronti a rimpiazzare, affiancare, o semplicemente disturbare oltre 70 milioni di lavoratori statunitensi, una domanda cruciale resta inascoltata: cosa vogliono davvero le persone che questi sistemi dovrebbero aiutare?

Per rispondere, un team di ricercatori (con il supporto del Stanford Digital Economy Lab) ha fatto qualcosa di raro nel mondo tech: ha chiesto direttamente ai lavoratori. Il risultato è un’indagine monumentale, chiamata WORKBank, che combina l’intelligenza artificiale con una cosa che l’AI fatica ancora a replicare: l’esperienza sul campo.

1.500 lavoratori, 104 occupazioni, 844 compiti professionali, e 52 esperti di AI coinvolti. Il verdetto? Le startup stanno correndo nella direzione sbagliata, investendo su attività che le persone non vogliono automatizzare e ignorando proprio quelle dove l’automazione è desiderata e possibile. Sorpresi? Non dovreste esserlo.

L’analisi ha classificato ogni attività in quattro zone: “Green Light” per compiti dove l’automazione è ben accolta e tecnicamente pronta; “Red Light” per attività dove l’AI può già operare, ma i lavoratori non la vogliono; “Opportunity Zone” per sogni futuristici desiderati ma non ancora possibili; e infine il cimitero dei progetti inutili, la “Low Priority Zone”.

Ed è qui che si cela l’ironico paradosso: il 41% degli investimenti delle startup di Y Combinator cade proprio in quest’ultima categoria. Un dato che suggerisce che chi decide dove investire spesso non ha mai fatto il lavoro che intende “disruptare”. Quando l’AI vuole “aiutarti” ma non capisce nulla di quello che fai, i problemi sono inevitabili.

Ma l’inchiesta non si ferma al binomio desiderio/capacità. Entra nel vivo della psicologia del lavoro. Perché, pur essendo vero che il 46% dei compiti analizzati ha ricevuto un voto positivo verso l’automazione (su scala da 1 a 5), i motivi sono rivelatori. La ragione più citata? “Liberare tempo per attività a più alto valore”, seguita dalla noia delle attività ripetitive, lo stress, e l’idea che l’AI possa migliorare la qualità.

Sì, i lavoratori vogliono automazione. Ma non per essere sostituiti. La vogliono per potersi concentrare su quello che conta davvero.

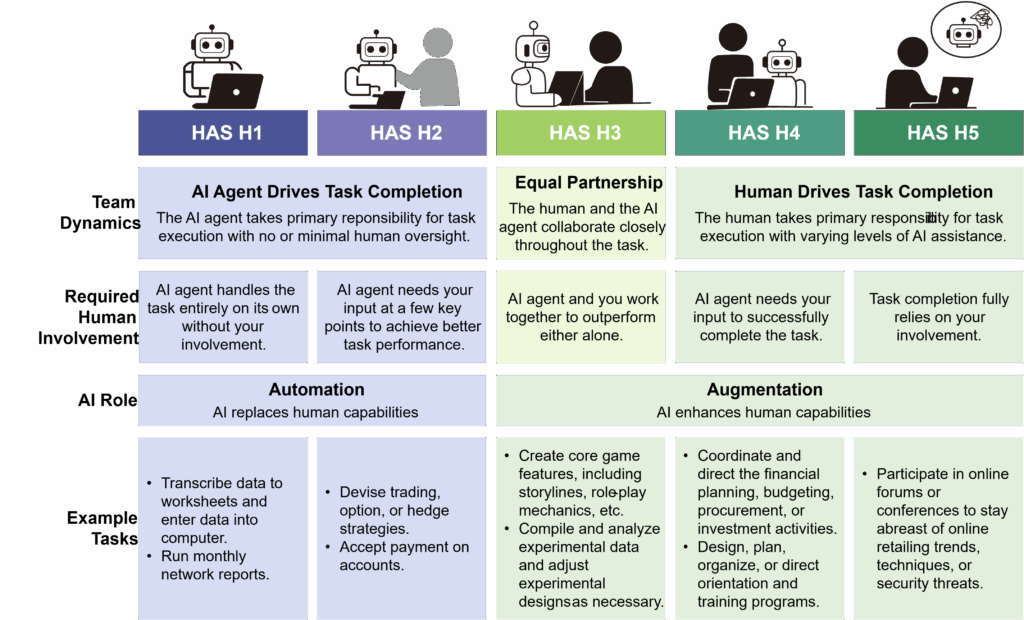

E qui arriva un’altra nota dolente: la Human Agency Scale (HAS). Una scala da H1 a H5 che misura quanto coinvolgimento umano è desiderato per un determinato compito. Non sorprende che il livello preferito in quasi metà delle occupazioni (47 su 104) sia H3: collaborazione paritaria. Gli esseri umani non vogliono sparire dall’equazione, vogliono partnership. Ma in quasi la metà dei compiti analizzati, i lavoratori desiderano più coinvolgimento umano di quanto gli esperti ritengano necessario. In altre parole: l’AI è pronta a prendere il volante, ma i passeggeri non si fidano ancora del pilota.

In effetti, “mancanza di fiducia”, “paura di perdere il lavoro” e “assenza del tocco umano” sono i tre principali motivi di resistenza all’automazione. Una triade che suggerisce come la tecnologia, per quanto avanzata, fatichi ancora a capire il lato umano del lavoro.

E non è solo questione di emozioni. Le implicazioni economiche sono reali. Analizzando la banca dati WORKBank insieme al database O*NET del Dipartimento del Lavoro USA, emerge che le competenze oggi più pagate – come l’analisi dati e l’elaborazione delle informazioni – stanno perdendo rilevanza nei compiti ad alto coinvolgimento umano. A salire di valore sono invece le competenze relazionali, organizzative e decisionali. Tradotto: l’AI sta premiando i soft skills. O, per essere più precisi, i core skills del futuro.

Chi guida, chi decide, chi connette le persone – queste sono le figure che prospereranno. Non chi elabora, controlla o annota dati. In un futuro dominato dagli agenti intelligenti, chi sa gestire persone, risorse e conflitti varrà più di chi scrive codice o compila tabelle.

Un esempio concreto? Un programmatore. In teoria, uno dei ruoli più colpiti dall’automazione. Ma nel dettaglio, i compiti che coinvolgono decisioni critiche, gestione del team o revisione creativa mantengono un alto livello di coinvolgimento umano richiesto. I compiti meccanici, invece – debug, test ripetitivi, documentazione – sono i primi candidati alla piena automazione. Ma solo se il programmatore è d’accordo.

E indovinate? Spesso non lo è.

C’è qualcosa di profondamente umano nel desiderare controllo anche sulle macchine che ci aiutano. L’illusione dell’automazione totale si scontra con la realtà della cooperazione imperfetta. L’AI può fare tanto, ma il valore del lavoro risiede ancora – per ora – nelle mani di chi lo compie.

La Silicon Valley dovrebbe ascoltare.

O, come direbbe Douglas Adams: “La tecnologia è una cosa magica, finché non comincia a fare il nostro lavoro meglio di noi”.

Per i CTO, per i policymaker, per chi costruisce prodotti: ignorare le preferenze dei lavoratori non è solo eticamente discutibile. È un errore di business.

Perché non è l’AI che cambierà il lavoro.

È il modo in cui scegliamo di usarla che cambierà il mondo.