C’è qualcosa di stonato, di profondamente ironico, nell’osservare che mentre le più brillanti menti dell’intelligenza artificiale si affannano a calcolare i rischi esistenziali dell’AI, nessuno sembra davvero sapere cosa significhi “esistenza”. Pia Lauritzen, filosofa danese e voce anomala in mezzo al frastuono siliconico, ha avuto il merito di scriverlo chiaro su Forbes: questa minaccia esistenziale non chiama ingegneri, ma filosofi. E la cosa inquietante è che nessuno – proprio nessuno – tra gli architetti di questi sistemi sembra preoccuparsene troppo.

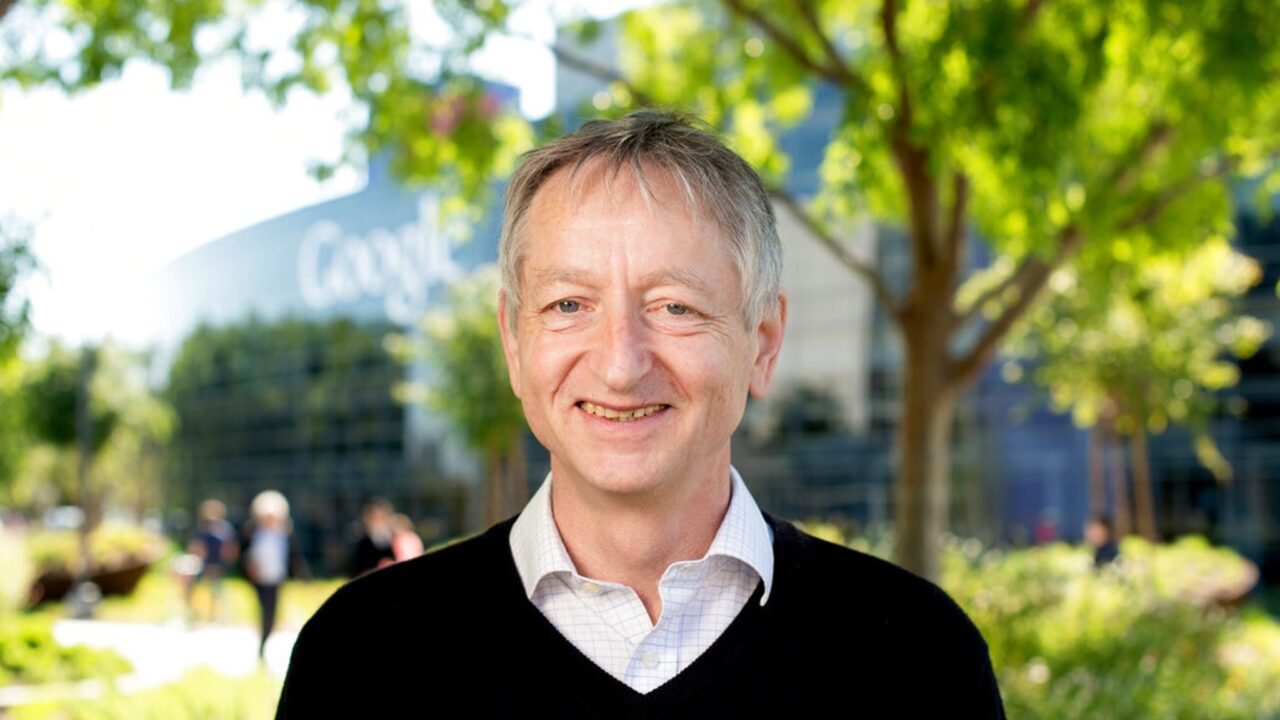

Geoffrey Hinton, icona decadente dell’AI accademica e (ormai) veggente post-Google, ha delineato i due scenari apocalittici che ormai conosciamo a memoria: o l’AI viene usata male da umani mediocri, oppure diventa più intelligente di noi e ci annienta. Cyberattacchi, virus, camere dell’eco, droni assassini e superintelligenze misantrope: il catalogo dei disastri è completo. Ma Lauritzen introduce una terza minaccia, molto più sottile e molto più letale. Quella che non fa rumore, che non infetta software o hardware ma corrode l’umano da dentro. Quella che si manifesta quando dimentichiamo cosa significhi essere umani.

Se la definizione più semplice di minaccia esistenziale è “qualcosa che mette in pericolo l’esistenza stessa”, come possiamo valutare il pericolo se abbiamo rimosso il significato di esistere? Lauritzen ci accusa di aver abdicato. Di aver lasciato che i tecnologi si rifugiassero dietro il mantra “non sappiamo cosa sia la coscienza” per evitare la domanda fondamentale: cosa ci rende umani?

Il paradosso, naturalmente, è che mentre investiamo miliardi per rendere le macchine intelligenti, disinvestiamo sistematicamente nell’unica cosa che potrebbe salvarci: la capacità umana di interrogarsi. Filosofia, humanities, pensiero critico, le uniche discipline in grado di dirci qualcosa su ciò che siamo, vengono trattate come reliquie improduttive. È come se stessimo costruendo il razzo per Marte dimenticando di chiederci se valga la pena partire.

Heidegger, Sartre, Merleau-Ponty non hanno mai ricevuto fondi VC. Eppure sono loro – non i CEO delle AI company – ad aver compreso che la coscienza non è una funzione, ma un abisso. Che la creatività non è un output, ma un processo in divenire. E che l’intelligenza non è un dato computabile, ma un gesto interrogativo che sfugge alla cattura.

L’AI, dice Lauritzen, minaccia l’esistenza non perché potrebbe ucciderci, ma perché ci offre risposte prima che abbiamo il tempo di formulare domande. E nel momento in cui smettiamo di porci domande esistenziali, smettiamo di essere umani. È una minaccia invisibile, silenziosa, subdola. Eppure potentissima. La velocità con cui ci affidiamo agli assistenti digitali per sapere cosa pensare, cosa desiderare, cosa scrivere e persino come sentire, mostra quanto siamo già compromessi.

Neil Lawrence, professore a Cambridge e voce critica dentro DeepMind, lo dice brutalmente: “le persone che controllano la tecnologia sono probabilmente le meno intelligenti socialmente sul pianeta”. L’epoca dell’ingegnere sovrano, del fondatore-guru, ha prodotto un vuoto. Un’umanità algoritmica che sa ottimizzare tutto tranne ciò che conta. E la filosofia, l’unico antidoto possibile, è stata relegata al ruolo di vezzo accademico, quando invece dovrebbe tornare al centro della discussione pubblica.

Lauritzen ci ricorda che la filosofia esistenziale non offre definizioni, ma domande. E proprio perché non pretende di definire “l’umano” come una feature tecnica, ci mette davanti allo specchio. È il “nulla” – non il “qualcosa” – che ci rende umani. Il sapere che siamo finiti, temporanei, imperfetti. Il sapere che moriremo. Che possiamo scegliere. Che possiamo sbagliare. E che dobbiamo chiedere perché. E per chi.

Mentre Hinton si ritira per occuparsi di “questioni filosofiche” e Demis Hassabis invoca “nuovi grandi filosofi” (come se si potessero generare a comando), Lauritzen lancia un messaggio disturbante nella sua semplicità: non abbiamo bisogno di nuovi pensatori, ma di smettere di delegare. Abbiamo bisogno di tornare a chiederci, ogni giorno, come vogliamo vivere prima di programmare un AI che lo faccia al posto nostro.

La grande illusione dell’AI è questa: farci credere che possiamo replicare l’intelligenza senza affrontare la vertigine dell’esistenza. Ma l’intelligenza senza esistenza è solo calcolo. E il calcolo non salva nessuno. Per questo, oggi più che mai, servono filosofi. Non per frenare la tecnologia, ma per evitare che ci seduca al punto da dimenticarci chi siamo.