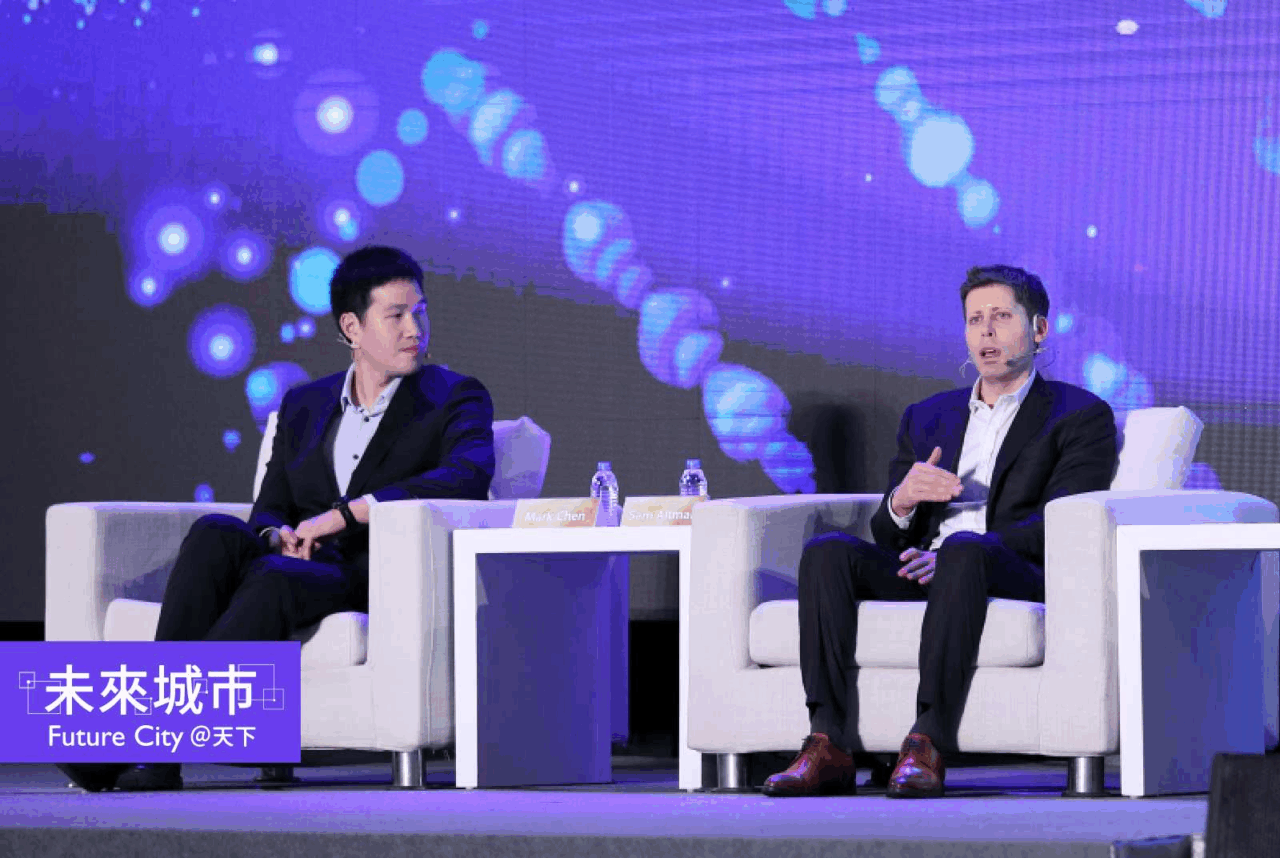

“Ho una sensazione viscerale, come se qualcuno fosse entrato in casa nostra e avesse rubato qualcosa.” No, non è la scena madre di un film di mafia. È una frase vera. E l’ha scritta Mark Chen, Chief Research Officer di OpenAI, in un memo infuocato allo staff. Non si parlava di algoritmi rubati, né di breach informatici. Parliamo di qualcosa di più importante, oggi: cervelli.

Nel giro di una settimana, Meta ha assunto otto ricercatori di punta di OpenAI. Non stagisti. Non junior. Ricercatori veri, alcuni dei quali coinvolti nei progetti fondamentali su RLHF, alignment, ottimizzazione dei transformer e interpretabilità. Gente che, per intenderci, non si licenzia perché vuole “fare un’esperienza nuova”. Gente che, in un altro scenario, andrebbe protetta come si fa con il segreto industriale o il codice sorgente di un motore di ricerca. Ma questa è la nuova economia dell’intelligenza artificiale: le GPU possono essere distribuite, i modelli anche, ma i talenti no. I talenti, quelli veri, restano scarsi, vulnerabili, e per questo oggetto di caccia spietata.

Siamo entrati nella fase due della guerra dell’AI: la fase umana. I modelli fondativi non si rubano facilmente, ma chi li costruisce sì. E Meta lo ha capito meglio di tutti. Mentre il mondo guarda a cosa succede tra Microsoft e OpenAI, Zuckerberg ha alzato il telefono. O forse no: ha semplicemente alzato il budget e lasciato che le offerte “esplosive” facessero il resto.

Secondo Wired, la reazione di Chen è stata quella di un generale tradito, più che di un manager preoccupato. Ha parlato ai suoi di “riconoscimenti creativi”, “ricalibrazione dei compensi” e “misure proattive mai viste prima”. Ma la frase più emblematica non è quella del furto. È quella scritta da un altro ricercatore, inclusa nel memo: “Se Meta vi fa pressione o vi propone offerte con scadenze ridicole, ditegli di smetterla. Non è carino forzare le persone quando stanno per prendere una delle decisioni più importanti della loro vita.”

Traduzione: ci stanno fregando la squadra migliore e non sappiamo come fermarli.

La reazione interna è stata ovviamente pubblica, perché nulla è davvero interno nel 2025. L’epoca dei “leak selettivi” ha fatto posto a un ecosistema di contro-narrazioni progettate per diventare virali. E mentre le offerte di Meta viaggiano sotto NDA, i memi sulla “fuga di cervelli da OpenAI” impazzano su X, Reddit, Slack e Telegram. Sì, Telegram. Perché alcuni di questi researcher, ormai, trattano la mobilità professionale come un’operazione da intelligence. Gruppi chiusi, recruiter anonimi, e un solo obiettivo: portarsi via il know-how prima che venga inglobato troppo a fondo nella governance della safety.

Il punto più tragico non è che OpenAI stia perdendo talenti. È che la sua stessa narrazione comincia a scricchiolare. Per anni, la startup si è raccontata come una missione, non come un’azienda. Una sorta di cavalleria etica del machine learning. Ora, di fronte alle sirene di Meta, quella missione sembra meno attraente. Quando un ricercatore di alignment decide di andarsene per lavorare su LLaMA, non sta scegliendo solo uno stipendio più alto. Sta dicendo che la narrativa di OpenAI non basta più. Che forse non ha mai convinto davvero chi lavora dentro quei laboratori, ma solo chi ne leggeva i blog post su Substack.

Parliamoci chiaro: Meta non ha bisogno di rubare. Ha bisogno di costruire, e sta accelerando la scalata con un solo vero vantaggio: può spendere come nessun altro e non ha l’ossessione di sembrare “buona”. Non ha bisogno di safety board, di alignment committee o di dibattiti infiniti sulla superintelligenza. Ha bisogno di vincere. E per vincere, ha bisogno dei migliori.

È questa la vera lezione per i player del settore: l’AI non è più una disciplina accademica. È uno sport da contatto. I modelli open source sono solo la punta dell’iceberg. Quello che fa davvero la differenza sono le competenze cumulative e irriproducibili che vivono dentro la testa di una manciata di esperti. Chi riesce a farli migrare, conquista non solo l’asset umano, ma tutta la traiettoria futura della tecnologia.

Quello che sta succedendo tra Meta e OpenAI ha conseguenze più profonde di quanto appaia. Si tratta di una ridefinizione dell’intero equilibrio strategico nel settore AI. Quando una startup leader perde otto ricercatori di alto livello in pochi giorni, non sta semplicemente subendo il normale turnover. Sta iniziando a perdere la capacità di difendere la sua cultura interna. E in un settore dove la cultura conta più del capitale, questo è un segnale di debolezza esistenziale.

C’è un’altra variabile che complica lo scenario. OpenAI ha una governance ibrida, con un’entità for-profit limitata da una nonprofit. Meta no. Non risponde a board etici. Non ha tensioni statutarie tra crescita e sicurezza. Può permettersi di essere spregiudicata. E, per chi lavora in AI, questa spregiudicatezza è sempre più attraente. Soprattutto per chi ha già visto cosa succede quando si cerca di rallentare l’innovazione per motivi morali: si viene superati da chi non si ferma.

La guerra dei talenti AI è quindi solo il sintomo di un conflitto più ampio: quello tra culture. Da un lato, chi vuole costruire in modo responsabile. Dall’altro, chi vuole vincere a tutti i costi. Il problema? Oggi la seconda opzione sembra molto più efficace. E, se la storia della Silicon Valley ci insegna qualcosa, è che l’etica vince solo quando coincide con la convenienza. Altrimenti, resta nelle note a piè di pagina.

Ora, immaginiamo per un momento cosa succede se altri 10, 15, 20 ricercatori chiave decidono di lasciare OpenAI nelle prossime settimane. Non sarebbe solo un danno reputazionale. Sarebbe la fine della narrazione secondo cui OpenAI è il luogo migliore al mondo per costruire il futuro dell’AI. E quando una narrativa si incrina, i capitali cominciano a spostarsi, le partnership si raffreddano, e persino i modelli sembrano meno straordinari.

In questo contesto, il memo di Mark Chen suona come un SOS camuffato da manifesto motivazionale. Non è solo un grido d’allarme, è la constatazione che la lealtà, da sola, non basta più. E forse non bastava neanche prima. I migliori non vogliono solo essere “riconosciuti”. Vogliono poter osare. Costruire. Sbagliare. E, soprattutto, essere pagati come superstar. Perché lo sono.

Cosa farà OpenAI ora? Aumenterà gli stipendi? Cambierà governance? Raddoppierà sulla missione etica? Oppure, come molti sospettano, inizierà anche lei a rispondere colpo su colpo, abbandonando l’innocenza istituzionale per diventare finalmente ciò che il mercato l’ha sempre trattata come: una tech company come le altre, solo con più GPU e più pressioni geopolitiche.

Nel frattempo, Meta osserva. E offre. E firma contratti. Non con l’ansia dell’urgenza, ma con la freddezza di chi sa che questa è solo una delle tante campagne che porteranno alla costruzione di un nuovo impero. Perché, nel 2025, i modelli contano. Ma chi scrive i modelli, molto di più.

E se un giorno, tra pochi mesi, dovessimo leggere che anche altri nomi storici di OpenAI sono passati a Meta, non stupitevi. In fondo, nel mondo dell’AI, ogni fuga di cervelli è solo un’IPO differita.