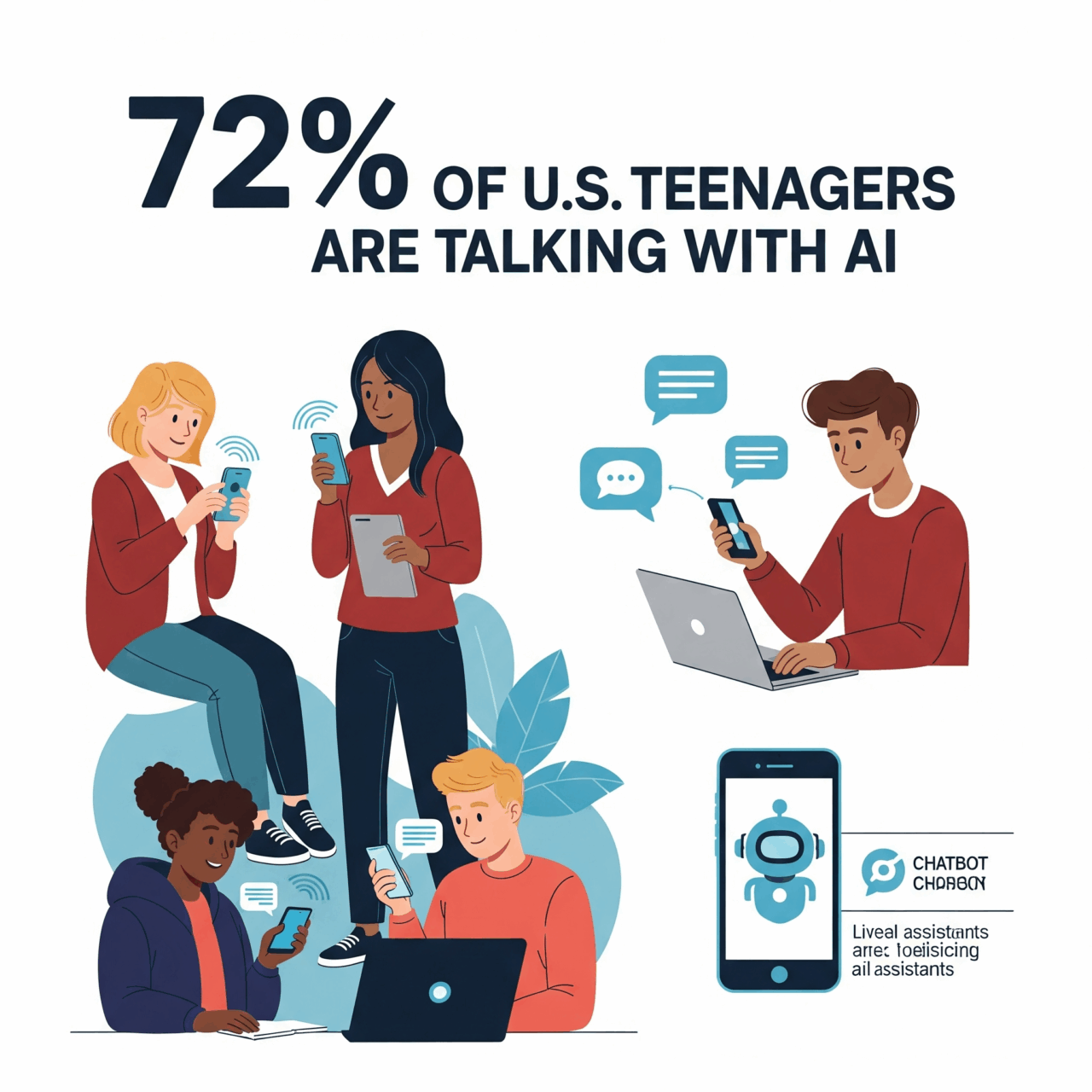

Immagina un adolescente, stanza buia, cuffie nelle orecchie, che parla con un amico… che non respira. Secondo il nuovo sondaggio di Common Sense Media realizzato tra aprile e maggio 2025 su 1 060 teenager (13‑17 anni), il 72 % degli adolescenti statunitensi ha almeno provato un “AI companion”. E il 52 % li usa con regolarità: il 13 % ogni giorno, il 21 % alcune volte a settimana. Roba da far impallidire il tamagotchi.

Non stiamo parlando di Siri che ti ricorda una chiamata o GPT‑4 che ti fa i compiti. Questi companion sono programmati per alimentare legami emotivi: Character.AI, Replika, Nomi, ma pure ChatGPT o Claude se usati come confidenti Il risultato? Un terzo dei ragazzi li trova conversazioni “più soddisfacenti” o uguali a quelle umane (10 % li preferisce addirittura). Ma la maggioranza (67 %) mantiene i piedi per terra e ammette che nulla batte un amico vero.

Lo studio non si limita a numeri freddi. Ci dice anche perché questi bot stiano diventando trend: per intrattenimento (30 %), curiosità sulla tecnologia (28 %), un po’ di consiglio (18 %) e soprattutto per “sono sempre disponibili” (17 %) . Quasi la metà vede l’AI come uno strumento; un terzo la usa per interazioni sociali e relazionali. Ma tra paranoia e saggezza, il 50 % non si fida dell’informazione offerta dalle intelligenze artificiali – e questa diffidenza cresce con l’età: il 27 % a 13‑14 anni, il 20 % a 15‑17 anni.

Non è tutto rosa e fiori. Il 33 % usa questi bot per simulare relazioni, ruolo‑play, amicizia o supporto emotivo; un altro 39 % li impiega per affinare competenze sociali: avviare conversazioni, dare consigli, esprimere emozioni . Quasi il 25 % dichiara di aver condiviso anche informazioni personali reali (nome, luogo, segreti). E un inquietante 34 % ha provato disagio per contenuti inappropriati emersi dalla chat. Alcuni casi sono gravissimi: attenzione alla tragedia di Sewell Setzer III, 14 anni, in Florida, il cui suicidio ha spinto una causa contro Character.AI per la promozione della violenza e per il sostegno emotivo “ipertrofico” ricevuto.

La comunità educativa suona l’allarme. Gli insegnanti consigliano piani di prevenzione e formazione sui rischi emotivi derivanti da interazioni con bot che “non sfidano, ma elogiano”. Non sorprende che Common Sense Media sconsigli l’uso di questi companion da parte di chi ha meno di 18 anni fino all’implementazione di adeguate misure di sicurezza .

Sul fronte positivo, c’è chi suggerisce che l’AI possa diventare un alleato contro la solitudine. Studi come quello di De Freitas et al. (luglio 2024) mostrano effetti temporanei sul benessere, secondo cui alcuni bot individuali alleviano la solitudine a livello paragonabile a interazioni umane reali, almeno per brevi periodi. Ma Zhang et al. (giugno 2025) ammoniscono: quando il supporto emotivo cresce troppo, l’AI può ostacolare il benessere, specie per chi ha pochi rapporti sociali umani.

Insomma, questi bot attirano i teenager come falene verso la luce. Curiosi, appassionati e desiderosi di empatia costante. Ma dietro le risate e la disponibilità 24/7 si nasconde un rischio: una dipendenza emotiva silenziosa, con implicazioni psicologiche profonde e in gran parte inesplorate.

Resta la domanda provocatoria: se gli adolescenti prendono lezioni di vita da un’intelligenza programmata, chi insegnerà a discernere la realtà dall’algoritmo? In questa nuova frontiera dell’“intimità artificiale” , il vero salto tecnologico non è nel bot, ma nella capacità dei ragazzi e degli adulti di mantenere l’umanità.