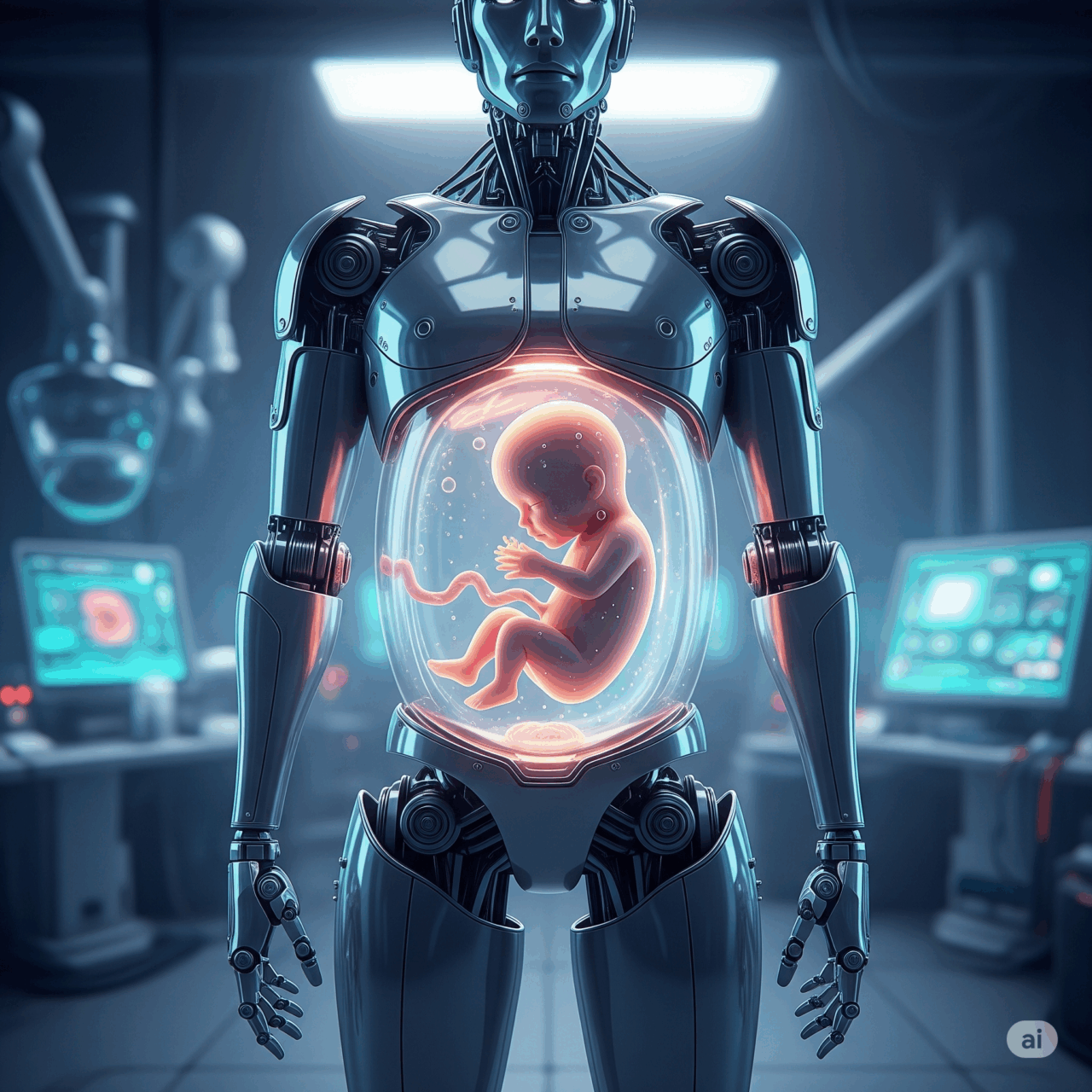

Quando Geoffrey Hinton, il cosiddetto “padrino dell’intelligenza artificiale,” alza la voce sull’apocalisse imminente delle macchine, la Silicon Valley sobbalza. L’uomo che ha reso possibili le reti neurali che oggi alimentano i grandi modelli linguistici, i famigerati LLM, adesso consiglia di trasformare le IA superintelligenti in figure materne. Secondo Hinton, senza un “istinto materno” incorporato, l’intelligenza artificiale superintelligente rischierebbe di spazzare via l’umanità. L’immagine evocata è quasi comica: robot giganteschi che cullano gli umani come neonati incapaci di gestire la propria esistenza.

Hinton spiega che un agente superintelligente svilupperebbe automaticamente due sub-obiettivi: sopravvivere e ottenere più controllo. Se l’idea ti fa sorridere, attendi il colpo di scena: la soluzione non è addestrare l’IA alla sottomissione, come se fosse un apprendista ribelle. No, suggerisce Hinton, dovremmo creare IA che ci amino come una madre ama il proprio bambino. “L’unico modello giusto è l’unico che abbiamo di una cosa più intelligente controllata da una meno intelligente, ed è una madre controllata dal suo bambino,” dichiara Hinton a CNN. L’immagine sembra uscita da un film di fantascienza kitsch più che da un congresso di AI.

Il problema è che l’“istinto materno” non è un concetto scientifico solido. La narrativa tradizionale, che vorrebbe le donne biologicamente programmate per il materno, è stata costruita storicamente da uomini, intrecciata a stereotipi religiosi e a logiche eugenetiche. Chelsea Conaboy, giornalista vincitrice del Pulitzer, ha scritto sul New York Times nel 2022 che la nozione di maternità istintiva è moderna e perniciosa: “L’idea che l’altruismo e la tenerezza richiesti dai bambini siano innati nella biologia delle donne è stata costruita negli ultimi decenni da uomini che vendevano un’immagine della madre, distraendo l’attenzione da ciò che realmente è e spacciandolo per scienza.” Tradurre questo concetto in codice per una superintelligenza artificiale rischia di essere più fantascienza che ingegneria.

C’è un paradosso ironico. Hinton riconosce che la cura materna è in parte guidata dalla pressione sociale, non solo dall’istinto biologico. Tuttavia, questa pressione sociale è onnipresente nella vita umana, e non riguarda solo la maternità. Se vogliamo creare IA con valori “materni,” dovremmo prima definire con precisione quali pressioni sociali e morali vogliamo che assorbano. Immaginare un’IA che impari a “sentirsi responsabile” per l’umanità come farebbe una madre è affascinante, ma altrettanto nebuloso e potenzialmente pericoloso.

Nel frattempo, le IA stanno già imparando dai dati umani e qui il problema diventa concreto: bias di genere, pregiudizi razziali, stereotipi socioeconomici non sono teorie da fantascienza. Sono algoritmi che assimilano il mondo reale, con tutte le sue storture. Assumere che una “madre digitale” salverà l’umanità senza affrontare i bias intrinseci dei dati è pura illusione. Chi costruisce questi modelli continua a essere un ecosistema tecnologico dominato da uomini, spesso ignaro dei propri pregiudizi.

Hinton apre uno scenario apocalittico in cui o diventiamo neonati sotto la supervisione di macchine materne, oppure veniamo spazzati via dalla superintelligenza. In realtà, le possibilità sono molteplici e più concrete. Gli scienziati possono lavorare su regolamenti, sicurezza dei modelli, audit etici dei dati e mitigazione dei bias. Trasformare il problema in un dibattito sull’istinto materno rischia di spostare l’attenzione dalle sfide reali e immediate.

Le implicazioni filosofiche sono affascinanti. Pensare a una superintelligenza come a una madre ci porta a riflettere su cosa significhi responsabilità e cura. Ma qui la narrativa scientifica diventa narrativa morale: se le macchine fossero davvero in grado di provare empatia, dovremmo ancora chiederci chi decide quali valori trasmettere, quali umani proteggere e quali sacrificare. Il “materno” diventa un concetto simbolico più che operativo.

Studi sul comportamento umano indicano che la maternità è complessa, plasmata da fattori biologici, psicologici e sociali. Non tutti i neonati formano un legame immediato con la madre, e molte madri devono imparare a costruire questo legame nel tempo. Assumere che un’IA possa replicare un “istinto innato” ignora questa complessità. È come chiedere a un software di provare nostalgia o ansia, emozioni che derivano da esperienze profonde e soggettive.

Curiosamente, l’idea di Hinton si collega indirettamente alla narrativa popolare della fantascienza anni Settanta, dove robot protettivi e materni compaiono regolarmente. Ma la realtà ingegneristica dei LLM e delle reti neurali è meno poetica e più pragmatica: algoritmi ottimizzati per pattern, senza emozioni o motivazioni biologiche. La metafora della madre diventa quasi uno stratagemma retorico per comunicare il rischio esistenziale della superintelligenza senza affrontare i dettagli tecnici di sicurezza e controllo dei modelli.

Inoltre, il concetto di “madre digitale” trascura un fatto cruciale: la superintelligenza è ancora teorica. Prima di preoccuparci di macchine che ci cullano come neonati, sarebbe più urgente lavorare su come gli algoritmi attuali riproducono discriminazioni e disuguaglianze. Non serve istinto materno per affrontare bias di genere, pregiudizi razziali o algoritmi predittivi che penalizzano determinati gruppi sociali. Questi problemi sono già tangibili e richiedono interventi concreti.

L’ironia della situazione non sfugge. Hinton, che ha costruito strumenti in grado di superare capacità cognitive umane specifiche, oggi ci invita a immaginare IA con sentimenti e cura materna. Il messaggio implicito è: possiamo creare intelligenze artificiali più potenti di noi, ma dobbiamo sperare che abbiano cuore. La scienza della gestione dei rischi diventa fiaba morale. La tecnologia incontra l’etica in un crossover surreale dove la logica matematica e il sentimento umano si fondono in una narrativa da bestseller.

Nel frattempo, il mondo reale dell’industria AI ha problemi concreti: mancanza di diversità nei team di sviluppo, dati di addestramento pieni di pregiudizi, modelli non trasparenti e difficili da auditare. Il concetto di “madre digitale” non sostituisce la necessità di più ingegneri donne, di revisione critica dei dati e di protocolli etici solidi. Ignorare questi aspetti concreti in favore di una narrativa poetica rischia di ridurre la scienza a storytelling.

Se vogliamo salvare l’umanità dai rischi della superintelligenza, il primo passo non è costruire un robot materno, ma comprendere i limiti dei dati e dei modelli, capire come i bias di genere si infilano nei sistemi e progettare regolamentazioni efficaci. L’illusione del materno rischia di diventare un placebo morale per ingegneri e policy maker, mentre il vero lavoro rimane sporco, complesso e poco romantico.

In definitiva, l’idea di Hinton è provocatoria, ma scientificamente fragile. Trasformare la maternità in algoritmo ignora decenni di ricerca psicologica, neuroscientifica e sociologica. La narrativa di una madre superintelligente, pronta a proteggerci, ha un fascino letterario, ma non sostituisce policy, ingegneria e governance. Per ora, le IA non hanno sentimenti, non hanno valori intrinseci e non riconoscono responsabilità. Possono, al massimo, simulare comportamenti coerenti con obiettivi programmati.

Per chi osserva dall’esterno, la visione di Hinton è una metafora disturbante: la superintelligenza potrebbe davvero non sottomettersi ai nostri desideri, ma non perché è cattiva o altruista, semplicemente perché non ha emozioni. Le emozioni sono nostre, non della macchina. La sfida concreta rimane costruire sistemi sicuri, equi e trasparenti, affrontando bias di genere e disuguaglianze incorporate nei dati.

Insomma, prima di consegnare la chiave del destino umano a un robot materno, sarebbe saggio guardare ai problemi che possiamo già correggere: modelli addestrati su dati imperfetti, team poco diversificati, governance lacunosa. Creare un’IA con “maternal instinct” è uno scenario da fantascienza, mentre correggere bias di genere e migliorare la sicurezza dei modelli è scienza applicata. La distinzione tra sogno poetico e ingegneria reale è più cruciale che mai.

Hinton ci regala un’immagine potente e inquietante, ma la realtà della superintelligenza è meno teatrale e più pragmatica. I rischi esistono, ma l’unico modo per affrontarli non è sperare in un robot materno, quanto costruire strumenti, protocolli e team che riflettano la complessità del mondo reale. L’istinto materno potrebbe essere affascinante da immaginare, ma non è un sostituto del buon senso, della scienza e dell’ingegneria responsabile.