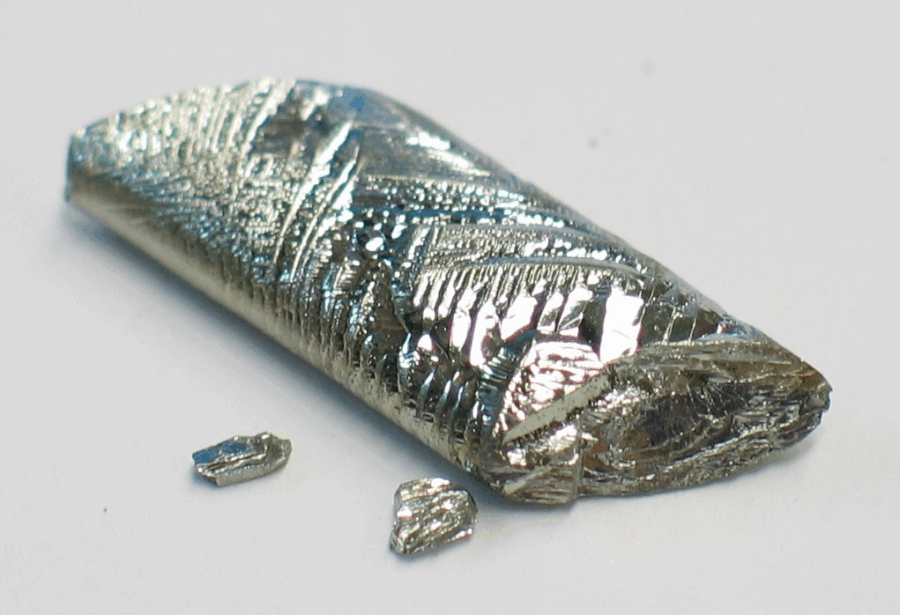

Huawei, il colosso cinese delle telecomunicazioni che da anni è sotto l’occhio del ciclone geopolitico, ammette candidamente un fatto che fa tremare gli ingenui. I suoi chip Ascend, per quanto presentati come meraviglie della tecnologia, sono ancora “una generazione” dietro quelli statunitensi. Ma attenzione: non è la fine del mondo, né la resa incondizionata di Pechino alla supremazia tecnologica d’oltreoceano. Anzi, l’arte di arrangiarsi con metodi “non convenzionali” come stacking e clustering promette performance paragonabili ai giganti del settore. Una magia tutta cinese, fatta di impilamenti di chiplet brevettati che rendono il processore più compatto, più furbo, più scalabile.

Questa confessione arriva direttamente da Ren Zhengfei, il fondatore di Huawei, nel contesto di un’intervista di copertina sul People’s Daily, l’organo ufficiale del Partito Comunista. Primo a rompere il silenzio dopo il lancio di ChatGPT e la nuova ondata di sanzioni USA, Ren non si limita a una difesa d’ufficio. Non nasconde le difficoltà e riconosce che la tecnologia made in USA è “una generazione avanti”, ma rivendica con veemenza la capacità della Cina di colmare il gap con ingegnose soluzioni tecniche. E, soprattutto, sottolinea la forza di un ecosistema nazionale che ha ben altri vantaggi competitivi: centinaia di milioni di giovani, una rete elettrica robusta e una infrastruttura di telecomunicazioni che, a suo dire, è la più sviluppata al mondo.