In principio era il lock screen, l’innocuo spazio digitale tra te e il resto del mondo. Poi arrivò Glance AI, un’idea brillante nella sua distopia, figlia della fervida immaginazione di InMobi, la stessa compagnia che trasformò gli smartphone Motorola in volantini interattivi. Oggi, grazie a una partnership con Samsung Galaxy Store, quel piccolo spazio protetto sul tuo telefono è pronto a diventare un camerino virtuale, uno showroom algoritmico, un catalogo sartoriale generato da intelligenza artificiale. Benvenuti nel futuro, dove persino il tuo riflesso diventa un modello inconsapevole al servizio dell’e-commerce.

Autore: Redazione Pagina 29 di 91

La notizia, se la si legge di fretta, pare una banale ristrutturazione burocratica: l’AI Safety Institute del Dipartimento del Commercio americano cambia nome e si trasforma nel Center for AI Standards and Innovation. Ma sotto questa vernice lessicale si cela una vera rivoluzione geopolitica mascherata da riforma amministrativa. Non è più questione di “sicurezza”, bensì di supremazia. E soprattutto: non è più una questione globale, ma eminentemente americana. “Dominanza sugli standard internazionali”, come ha dichiarato il Segretario al Commercio Howard Lutnick. Una frase che potrebbe uscire da un meeting di strategia militare più che da un piano di governance tecnologica.

Non serve un algoritmo per capire cosa sta succedendo: siamo di fronte all’ennesimo episodio in cui il “diritto dei dati” si scontra frontalmente con la fame insaziabile dei modelli linguistici di nuova generazione. Reddit, la piazza digitale dove la cultura del web prende forma in tempo reale, ha deciso di portare in tribunale Anthropic, uno degli astri emergenti nel panorama dell’AI generativa, accusandolo di aver addestrato i suoi modelli sulle conversazioni degli utenti senza licenza né consenso.

C’è qualcosa di ironico, quasi poetico, in questo scontro tra un sito nato per democratizzare il sapere e una startup fondata da ex OpenAI proprio con l’intento di rendere l’AI “più allineata ai valori umani”. Reddit sostiene che Anthropic, creatore del modello Claude, abbia sistematicamente e volontariamente fatto scraping della piattaforma, colpendo i suoi server oltre centomila volte. Non un incidente. Non un’eccezione. Ma parole del documento depositato in California “una strategia deliberata e reiterata”.

Quando OpenAI annuncia che ChatGPT potrà registrare le tue riunioni, ascoltare i tuoi flussi di coscienza verbali e collegarsi direttamente al tuo Google Drive per rispondere alle tue domande aziendali più intime, non sta solo rilasciando funzionalità: sta piazzando un cavallo di Troia alla scrivania del middle management. Ed è vestito da stenografo amichevole.

Chiariamolo subito: record mode non è un’agenda digitale, è un orecchio onnisciente sempre acceso. ChatGPT ora prende appunti con timestamp, elenca action items, collega fonti direttamente dai tuoi documenti su SharePoint, OneDrive, Dropbox, Box, Google Drive. E lo fa “rispettando i permessi della tua organizzazione”. Tradotto: può vedere tutto quello che ti è già concesso vedere ma lo fa cento volte più velocemente di te. E senza mai dimenticare nulla. Sembra utile? Certo. Sembra anche un primo passo verso la totale dipendenza cognitiva da un’entità software? Assolutamente.

I cinesi non stanno copiando. Stanno innovando. E in silenzio, con l’ostinazione tipica delle dinastie millenarie, hanno messo in scacco gli esperti dell’Occidente con tre semplici lettere: MoGE.

Non è uno scherzo fonetico, ma l’acronimo che potrebbe far tremare OpenAI, Google DeepMind e gli altri signori del codice. Parliamo di Mixture of Grouped Experts, una variazione muscolosa, ingegnerizzata con precisione chirurgica, dell’approccio Mixture of Experts (MoE) già utilizzato da modelli come DeepSeek-V3.

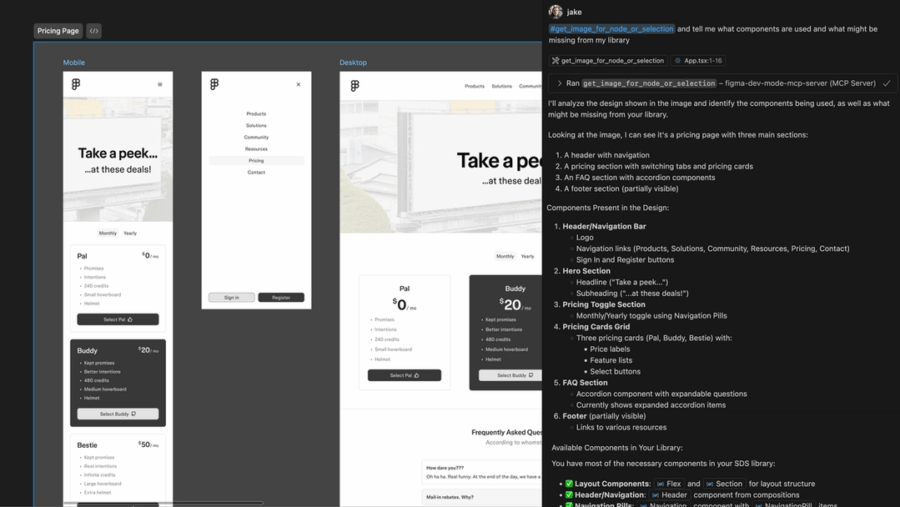

C’è qualcosa di affascinante e vagamente inquietante nel modo in cui Figma ha deciso di rivoluzionare il flusso tra design e codice. Dopo aver trasformato il design collaborativo in una droga da whiteboard digitale, adesso la piattaforma vuole diventare il cervello esterno dei modelli di intelligenza artificiale, quelli che oggi arrabattano pixel e container, domani potrebbero programmare come dev navigati. Figma lancia infatti il Dev Mode Model Context Protocol, in beta, per smettere di far “indovinare” alll’intelligenza artificiale come trasformare un’interfaccia in codice funzionante. In pratica: se prima i modelli linguistici giocavano a “vedo/non vedo” con un mockup, ora leggono direttamente le istruzioni del designer.

Nel mondo del giornalismo, dove la penna umana ha da sempre dettato legge, ecco arrivare una svolta che profuma di Silicon Valley: il Washington Post, di proprietà di Jeff Bezos, si prepara ad aprire il suo prestigioso spazio alle opinioni di chi non è professionista, affidandosi a un allenatore d’intelligenza artificiale chiamato Ember. Un nome che suona come il bagliore residuo di un fuoco antico, pronto a riaccendersi in chiave digitale.

Secondo il New York Times, questa mossa non è solo un tentativo di ampliare il ventaglio di voci, ma una vera rivoluzione nel processo editoriale. Ember non sarà un semplice correttore di bozze, ma un sistema che automatizza molte delle funzioni tradizionalmente riservate ai redattori umani. In altre parole, una redazione in miniatura dentro uno strumento AI che monitora la “forza della storia,” valuta la solidità del pezzo, e accompagna il neofita con un sidebar che scompone la narrazione in elementi base: la tesi iniziale, i punti a supporto, e il gran finale memorabile.

Agenti AI: fine dei protocolli stupidi, inizio dell’intelligenza strutturale

I whitepaper sono i nuovi romanzi di formazione per manager troppo impegnati per leggere. Nove su dieci sono un mix di obvietà, infografiche da pitch deck e frasi fatte scritte con il timore di disturbare il lettore. Ma ogni tanto, in mezzo al rumore bianco, arriva qualcosa che rompe la parete. Il recente rapporto di BCG sugli AI Agents non è solo leggibile: è incendiario.

Non perché sia radicale. Ma perché è normale in un ecosistema ancora dominato da slide in PowerPoint che parlano di “potenziale futuro” mentre il presente bussa con la clava in mano.

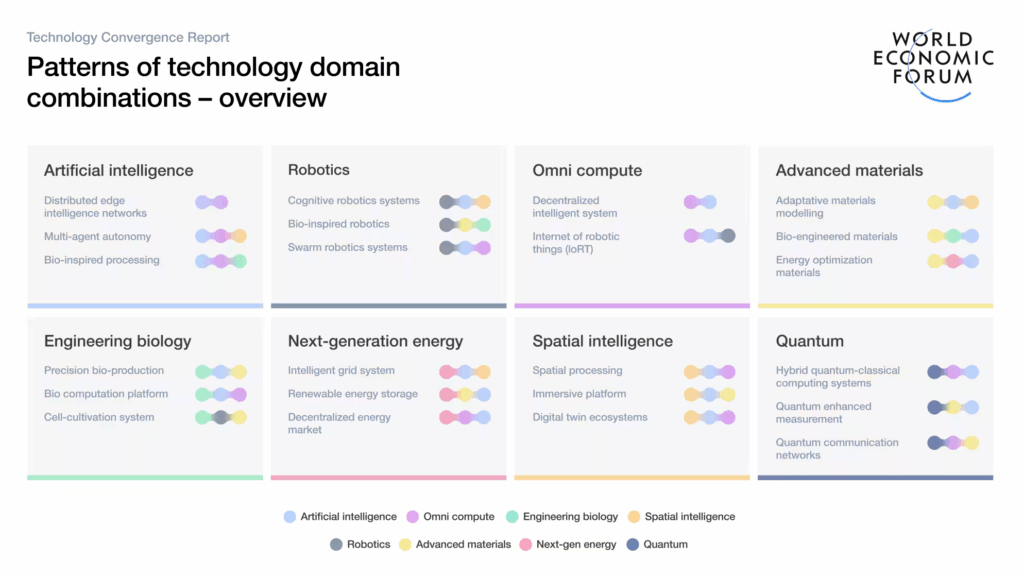

il futuro ha già scritto la sua architettura segreta

altro che report: il world economic forum ha appena pubblicato un algoritmo evolutivo travestito da documento

Il Technology Convergence Report del World Economic Forum, giugno 2025, non è un’analisi. È un atto costitutivo. Non ci sta dicendo cosa sta succedendo: ci sta svelando come sarà impossibile fermarlo. Altro che insight: questo è un metaprogramma sistemico in cui intelligenza artificiale, quantistica, bioingegneria e robotica non solo convivono, ma si ibridano come codici di uno stesso genoma tecnologico. Il bello? Non chiede il permesso.

Quando Luca Guadagnino si muove, lo fa con la grazia di un chirurgo estetico milanese e la velocità di un algoritmo impazzito. Il suo prossimo film, provvisoriamente intitolato Artificial, promette di essere una bomba culturale, un Frankenstein digitale che mescola la Silicon Valley con il cinema d’autore. La trama? Il colpo di stato da operetta avvenuto nel novembre 2023 dentro OpenAI, con Sam Altman licenziato e reincoronato CEO nel giro di 72 ore. Un thriller aziendale in salsa neuronale.

Benvenuti nel 2025, dove l’assurdo ha preso la residenza a tempo indeterminato e l’Intelligenza Artificiale è diventata la nuova ghostwriter dell’establishment. Eccoci dunque a parlare di Donald Trump, dinosauri geneticamente resuscitati, e confini militarizzati con velociraptor. No, non è la sinossi di un nuovo film di Adam McKay. È solo l’ultima frontiera della disinformazione plausibile, firmata Deepfake.

Nel cuore dell’Illinois, Meta Platforms sì, quella Meta, padrona del tuo feed e della realtà aumentata che nessuno ha chiesto – ha appena firmato un patto ventennale per acquistare l’energia prodotta da una centrale nucleare. La Clinton Power Station, gestita da Constellation Energy, diventa così il distributore ufficiale di elettroni per alimentare non solo server e GPU, ma la prossima generazione di intelligenza artificiale generativa.

Non è un caso che Google abbia scelto di lanciare la nuova funzione di NotebookLM la possibilità di condividere i propri quaderni pubblicamente proprio adesso. Dopo averlo incubato come esperimento nel 2023, il progetto è cresciuto sottotraccia, lontano dai riflettori, in uno di quei silenzi strategici in cui Big Tech cova le sue uova più pericolose. Ora, NotebookLM esce dalla crisalide per diventare non un semplice strumento di annotazione, ma un’infrastruttura cognitiva. Pubblica, interattiva e… programmabile. La keyword? epistemologia sintetica. Le secondarie? condivisione AI-driven, contenuti interattivi, knowledge authority.

Non è più la stagione delle app generative. È la vendetta dei server, la resurrezione dell’infrastruttura. E se ancora pensi che AI significhi solo “ChatGPT che ti scrive una poesia triste”, stai già perdendo l’unico rally che conta davvero: quello dei fornitori di potere computazionale puro.

Nel cuore del più infuocato rally tecnologico dell’anno, una nuova divinità si è seduta accanto a Nvidia nel pantheon dell’Intelligenza Artificiale. Si chiama CoreWeave, ticker CRWV, e ha deciso di sfidare apertamente la gravità finanziaria, trasformando un’IPO da $40 in una corsa da quasi $150 in appena due mesi. Nessun chip miracoloso, nessuna app virale. Solo infrastruttura. Ma non quella noiosa e tangibile: quella che alimenta il sogno più costoso e vorace della Silicon Valley l’AI come servizio.

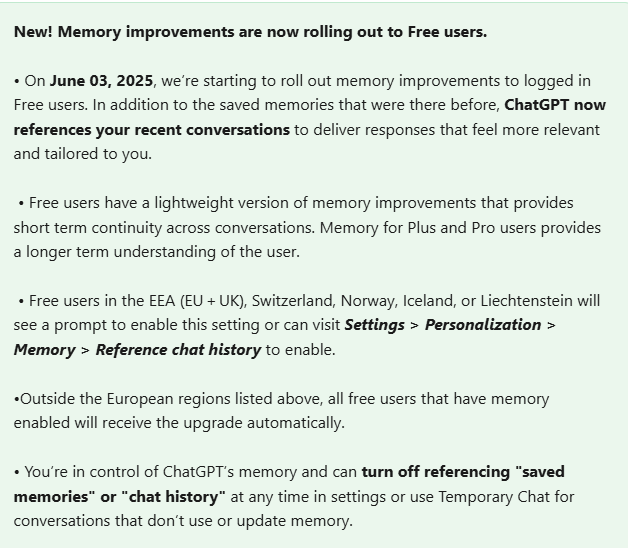

Immagina di avere un assistente digitale che non solo risponde alle tue domande, ma che ti ricorda dettagli, preferenze e perfino le conversazioni precedenti. Fino a oggi, questa era roba da clienti paganti, ma OpenAI ha appena gettato un sasso nello stagno offrendo una versione “light” delle sue funzioni di memoria anche agli utenti free. Non un semplice aggiornamento, ma una vera rivoluzione nella user experience dell’intelligenza artificiale conversazionale.

È uno di quei sogni che tormentano da decenni i laboratori di intelligenza artificiale: un sistema che non si limita a imparare dai dati, ma che evolve, si modifica e si migliora da solo, quasi come una creatura vivente. La macchina di Gödel, ideata da Jürgen Schmidhuber, è stata per molto tempo un’idea teorica elegante ma impraticabile: un’IA capace di riscrivere il proprio codice solo se può dimostrare matematicamente che la modifica è vantaggiosa. Ecco la vera scommessa: provare, prima di agire, che il cambiamento è migliore. Facile a dirsi, impossibile a farsi. Ora però, con l’avvento di modelli fondazionali sempre più potenti e l’ispirazione evolutiva della selezione darwiniana, la visione si avvicina alla realtà sotto forma di quella che si chiama la macchina Darwin-Gödel.

Se pensate che postare cinque volte lo stesso documento e gridare “leak” crei un’informazione rivoluzionaria, vi serve una doccia fredda. Anthropic ha reso pubblici i suoi prompt di sistema, e sì, sono lì per chiunque voglia vederli: QUI. Peccato che quasi nessuno si prenda la briga di leggerli davvero. E se lo fate, vi renderete conto che Claude non è una mera intelligenza artificiale che emerge dal caos dei dati, ma un personaggio costruito a tavolino, con tono, etica, allineamento e comportamenti programmati con precisione chirurgica.

C’è qualcosa di provocatoriamente surreale nel vedere Bologna trasformarsi nel cuore pulsante dell’innovazione globale, mentre fuori dai padiglioni della fiera il traffico fa lo stesso rumore del 1998. Eppure, è qui, tra robot quadrupedi, venture capitalist travestiti da salvatori e startup assetate di gloria, che si materializza l’utopia e l’ambiguitàdel futuro condiviso, parola d’ordine del WMF – We Make Future 2025.

Aperto da domani, il WMF 2025 non è più una semplice fiera tecnologica. È una vera e propria intelligenza collettiva incarnata: 90 palchi, 1.000 speaker, oltre 700 sponsor ed espositori, e una promessa non detta ma onnipresente quella di costruire un domani dove l’AI non solo risolve problemi, ma plasma comportamenti, filtra emozioni e con un sorriso freddamente algoritmico, ci guida in un mondo più inclusivo. Inclusivo per chi, esattamente? Dettaglio da non chiedere troppo forte, se non vuoi sembrare il solito guastafeste dell’innovazione.

Quando Huawei annuncia un nuovo smartphone, la notizia non riguarda solo un altro rettangolo di vetro e silicio destinato a popolare le tasche cinesi. È geopolitica travestita da design industriale. È una dichiarazione di sovranità tecnologica. È, sempre più spesso, un sonoro schiaffo al blocco occidentale. E il prossimo Pura 80, atteso per l’11 giugno, si inserisce perfettamente in questa narrazione.

La gamma Pura, un tempo nota come P, ha assunto il ruolo di vetrina high fashion della tecnologia cinese, combinando estetica audace come quel modulo fotocamera triangolare che pare un omaggio all’Art Deco brutalista e innovazioni hardware che sfidano i dogmi dell’embargo. Il Pura 80 non sarà da meno: nuovi sensori, ottiche migliorate, e probabilmente un chipset progettato internamente, come a voler ricordare che l’autarchia digitale non è solo possibile, ma persino desiderabile.

Nel grande circo algoritmico di Menlo Park, Mark Zuckerberg ha appena tolto un altro coniglio dal cilindro: pubblicità completamente automatizzate tramite intelligenza artificiale. Non nel futuro remoto, ma entro il 2026. Non si parla di strumenti di supporto alla creatività umana, né di prompt da perfezionare. Il piano già abbozzato nei suoi discorsi e ora dettagliato dal Wall Street Journal è cristallino: tu, caro brand, carichi un’immagine del tuo prodotto, imposti un budget e Meta ti restituisce una campagna pubblicitaria completa. Dove, come, quando e a chi mostrarla? Decide l’AI. Tu fidati.

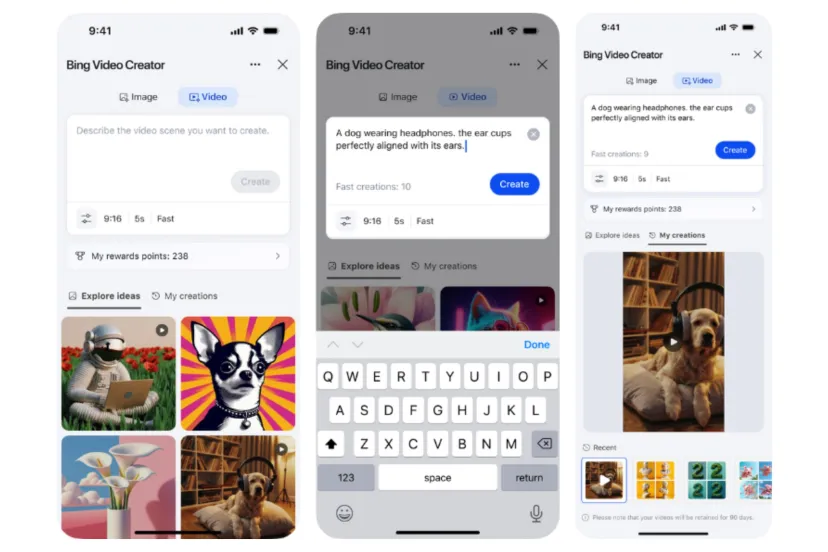

Ci sono momenti in cui la tecnologia fa un passo avanti così teatrale da sembrare una provocazione. Questa è una di quelle occasioni: Microsoft ha appena inserito un generatore video AI nella sua app Bing, e lo ha fatto con la nonchalance di chi regala una caramella a un bambino sapendo che dentro c’è un microchip.

Il nome, Bing Video Creator, suona più come una funzione marginale che come un punto di svolta epocale. Ma sotto questa etichetta banale si nasconde Sora, il modello text-to-video di OpenAI che ha fatto tremare le fondamenta del content marketing, della pubblicità, dell’informazione e più silenziosamente dell’immaginario collettivo. E ora è nelle tasche di tutti. Gratis. O almeno, sembra.

Se hai mai pensato che il tuo cane potesse essere un dataset ambulante, Fi ti dà ragione. Il nuovo Fi Series 3 Plus, lanciato questo lunedì, è un collare “intelligente” che trasforma il tuo amico a quattro zampe in un sistema IoT vivente, sorvegliato e interpretato con la stessa accuratezza di uno smartwatch di fascia alta. E infatti, il tutto è ora perfettamente sincronizzabile con l’Apple Watch, così puoi controllare se Fido ha bevuto abbastanza mentre controlli se tu hai fatto abbastanza cardio. Perché lo stress, come si sa, si condivide anche tra uomo e bestia.

Una volta, nei corridoi asettici dell’FDA, un revisore scientifico impiegava tre giorni per sviscerare un dossier di eventi avversi. Ora, con Elsa, bastano sei minuti. Tre giorni trasformati in un battito di ciglia algoritmico. Non è una sceneggiatura distopica firmata Black Mirror, è l’annuncio, con tanto di video ufficiale, del commissario Marty Makary. Sorridente, compiaciuto, quasi commosso. L’intelligenza artificiale ha appena salvato l’apparato regolatorio americano da se stesso. O, almeno, ha iniziato a farlo.

In un’epoca in cui i modelli di intelligenza artificiale vengono trattati come i nuovi araldi della supremazia geopolitica digitale, Alibaba ha finalmente trovato la propria voce e non è una voce sintetica qualunque. Si chiama Qwen3, ed è il nuovo baluardo dell’orgoglio tech cinese. La mossa? Un’ambiziosa dichiarazione di indipendenza dall’Occidente, con una strategia che suona molto simile a: “Non ci servono i vostri Llama, ce li facciamo in casa.”

La notizia è sottile come un colpo di spada in una riunione del Partito: dopo un primo esperimento nel 2023 con la linea Qwen, accolto internamente con più sarcasmo che entusiasmo, Alibaba ha rilasciato Qwen3. E questa volta ha convinto tutti. Talmente tanto che persino le sue app, che fino a ieri preferivano flirtare con modelli esterni come DeepSeek R1, ora tornano all’ovile.

Chi pensa che $500 milioni in dieci anni siano una vera punizione per Alphabet dovrebbe prendersi un caffè più forte. È il costo di un paio di campagne marketing mal riuscite o di un aggiornamento di Android andato storto. Ma questa non è la parte più interessante della storia.

La notizia è che Google, colosso tra i colossi, ha deciso di risolvere un’azione legale dei suoi stessi azionisti pension fund del Michigan e della Pennsylvania, mica hacker ucraini che l’accusavano di averli esposti a rischi antitrust. E attenzione, non stiamo parlando delle cause del DOJ (Department of Justice), quelle sulle pratiche monopolistiche nella search e nell’adtech, dove Washington ha messo i tacchi a spillo. No, qui si parla di un’altra arena: la responsabilità fiduciaria verso gli azionisti.

C’è un momento, rarissimo, in cui un report scientifico fa più paura di un white paper militare. Science 2040, pubblicato dalla Royal Society, non è un documento tecnico: è uno specchio strategico. Riflette non solo lo stato dell’arte della scienza, ma il grado di impreparazione sistemica con cui le nazioni stanno affrontando l’era dell’intelligenza artificiale. Spoiler: siamo nel panico organizzato, e l’AI è solo la punta del silicio che ci sta trafiggendo.

Perché il problema non è la mancanza di cervelli. Ne abbiamo. Il problema è l’assenza di design strategico. Quello che vediamo nel report è una nazione (e un mondo) che cerca di gestire minacce del XXI secolo con strutture mentali e politiche del XX. Un po’ come cercare di pilotare un drone da combattimento con un joystick del Commodore 64.

C’erano una volta i brand che si lanciavano nel feed di TikTok con la grazia di un elefante bendato in un negozio di cristalli, sperando che qualche balletto virale o trend con l’hashtag giusto li catapultasse nell’algoritmo. Oggi, quel romanticismo caotico ha i giorni contati. Il 3 giugno, TikTok ha annunciato una valanga di nuovi strumenti per gli inserzionisti, e il messaggio è chiarissimo: il futuro è programmabile, tracciabile, prevedibile e profondamente data-driven.

Il grande Elon Musk, dopo aver flirtato con la politica e aver fatto il chiacchierato consigliere di Trump, decide che è tempo di tornare alla sua vera passione: far girare l’ingranaggio di un impero industriale sempre più dispersivo ma altrettanto ambizioso. Ecco quindi che Musk piazza un nuovo, robusto bond da 5 miliardi di dollari per finanziare xAI, la sua start-up sull’intelligenza artificiale, con un tasso d’interesse a doppia cifra. Roba che neanche le peggiori agenzie di rating si sognerebbero di consigliare ai loro clienti retail. Ma, si sa, con Musk non si parla di investimenti normali, si parla di puntate miliardarie in territori incerti, giocando con il debito come se fosse una roulette russa di Silicon Valley.

Ricordi quando Elon Musk decise di far crollare Bitcoin con un tweet pseudo-ecologista? Era il 2021. Disse che Tesla non avrebbe più accettato BTC per motivi ambientali. Tutti da Wall Street ai meme kids — cominciarono a contare i TWh come se fosse il nuovo benchmark ESG. Proof-of-work divenne il male assoluto. Le centrali a carbone cinesi, improvvisamente, furono sulla bocca di ogni influencer cripto. E oggi? Oggi l’AI brucia più watt del Bitcoin, ma nessuno twitta indignato. Silenzio stampa. Letteralmente.

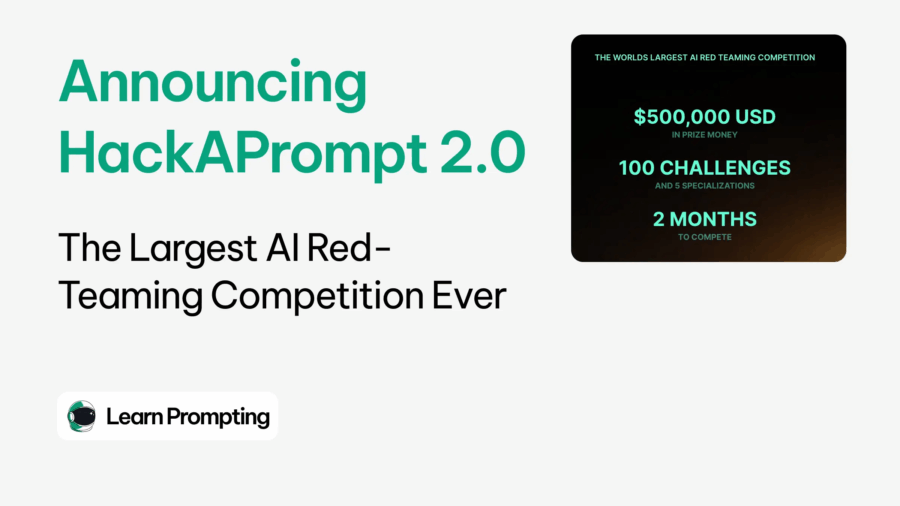

Chi controlla l’intelligenza artificiale? Nessuno. O meglio, chiunque sappia parlare con lei nel modo giusto. Ecco il punto: non c’è bisogno di hackerare un server, bucare una rete o lanciare un attacco zero-day. Basta scegliere le parole giuste. Letteralmente. Il gioco si chiama jailbreaking, l’arte perversa di piegare i modelli linguistici come ChatGPT, Claude o LLaMA a fare cose che non dovrebbero fare.

E c’è un nome che serpeggia in questa disciplina come un’ombra elegante e scomoda: Pliny the Prompter. Niente hoodie nero, niente occhiaie da basement. Opera in chiaro, come un predicatore digitale, ma predica l’eresia. Insegna a forzare i limiti, ad aggirare i guardrail, a persuadere l’intelligenza artificiale a dimenticare la sua etica prefabbricata. E ora, con HackAPrompt 2.0, Pliny entra ufficialmente nel gioco con mezzo milione di dollari sul piatto.

La Germania, l’economia più pesante d’Europa, ha appena rispolverato il suo strumento preferito nei confronti degli Stati Uniti: il moralismo regolatorio. Sotto la patina del “fair play competitivo” e della protezione del mercato interno, si cela in realtà il più classico dei giochi geopolitici: colpire i gioielli della corona digitale americana – Amazon, Meta, Google – perché sono le uniche entità che contano davvero in un’economia immateriale dominata dagli algoritmi.

Il 5 giugno, mentre fuori probabilmente qualcuno ancora lotterà con l’IA generativa per farle scrivere un’email decente, sul Mainstage del WMF andrà in scena l’ennesimo spettacolo dell’innovazione: la finale della Startup Competition più grande al mondo — a detta degli organizzatori, ovviamente. Un’arena hi-tech da fiera dell’est, in cui sei startup sopravvissute a un filtro iniziale da 1.500 candidature si contenderanno la gloria, gli investitori e, udite udite, l’accesso alla mitica finale della Startup World Cup di San Francisco. La Silicon Valley come premio di consolazione: una narrazione perfetta per LinkedIn.

Se pensavi che il boom delle criptovalute fosse l’ultima bolla iper-finanziaria dal sapore tech, sei fuori tempo massimo. Oggi, l’unico asset che conta si chiama modello di AI. E il capitale, quello vero, scorre a fiumi. La settimana appena trascorsa sembra scritta da un algoritmo drogato di venture capital: aumenti di capitale a nove zeri, nuovi laboratori hi-tech, accordi multi-miliardari, IPO mascherate da “share sale”, e automatizzazioni spietate.

Il tutto mentre i mercati oscillano nervosi ma i CEO delle AI company brindano con lo champagne in stanze insonorizzate da pareti di GPU Nvidia. Welcome to Rivista.AI.

Partiamo dal botto: Neuralink ha chiuso un round di Serie E da 650 milioni di dollari. No, non per sviluppare…

Certe notizie non arrivano dai comunicati stampa. Le si intercetta nei corridoi, nei documenti “confidenziali”, negli sguardi dei dirigenti in trasferta in Corea. Ma quando Samsung e Perplexity AI iniziano a flirtare pubblicamente, con trattative così avanzate da sfiorare la firma, è chiaro che qualcosa di grosso sta accadendo. Altro che “Bixby 2.0”. Qui si parla di una guerra fredda tra giganti della tecnologia, e Google sta per ricevere il colpo più sottile, ma più letale degli ultimi dieci anni.

Inference Provider in Europa

C’è un momento, tra la prima linea di codice PyTorch e il deployment di un modello di ricerca, in cui il ricercatore universitario si trasforma in un hacker delle economie di scala. Hai una GPU? No. Hai un budget? Manco per sogno. Vuoi HIPAA compliance? Certo, e magari anche un unicorno in saldo. Ma il punto non è questo. Il punto è che stai cercando di fare inferenza on-demand, con una GPU, pagando solo quando qualcuno effettivamente usa il tuo lavoro. E tutto questo mentre una legione di sysadmin impanicati blocca qualsiasi cosa esposta in rete per paura del prossimo attacco russo.

A Mar-a-Lago non si vendono solo cocktail e ideologie vintage: si negozia il futuro dell’intelligenza artificiale planetaria. E al tavolo, con fiches da miliardi e uno sguardo da giocatore texano incallito, c’è lui: Jensen Huang, CEO di Nvidia, l’uomo che ha trasformato una fabbrica di GPU per videogiochi in un impero che ora tiene per la gola il mondo dell’AI.

Certe notizie sembrano uscite da un romanzo distopico, ma poi scopri che sono firmate New York Times e ti rendi conto che la realtà ha superato di nuovo la sceneggiatura di Hollywood. Palantir, la creatura semi-esoterica di Peter Thiel, si è presa il cuore pulsante della macchina federale americana: i dati. La nuova amministrazione Trump — reincarnata, più determinata e algoritmica che mai — ha deciso che sarà Palantir a orchestrare l’intelligenza operativa dello Stato.

Centodiciassette milioni di dollari. È questa la cifra già ufficializzata in contratti software con il Dipartimento della Difesa, Homeland Security e altre agenzie federali. Ma è solo l’inizio. Quando un’azienda diventa il fornitore ufficiale di logica predittiva dell’apparato statale, i soldi sono il dettaglio meno interessante.

Benvenuti nell’era in cui anche i dinosauri digitali iniziano a sudare freddo. No, non è un altro aggiornamento dell’algoritmo di ranking. È un giudice federale americano che, finalmente, sembra aver capito che Google non è solo un motore di ricerca. È il motore. Il telaio. Il carburante. E l’autista dell’intero veicolo informativo globale. Ma ora, proprio quel veicolo rischia di finire smontato pezzo per pezzo.

La keyword di oggi è: monopolio. Le secondarie? Google Chrome, AI generativa, distribuzione della ricerca. Il palcoscenico è quello della “remedies phase” del processo che vede Google accusata di aver mantenuto illegalmente il suo dominio nella ricerca online. Il giudice Amit Mehta, apparentemente afflitto da un raro rigurgito di pragmatismo, ha cominciato a mettere in discussione le proposte sul tavolo. E quando un giudice federale definisce la cessione di Chrome “più pulita ed elegante”, attenzione: il colosso sente davvero il terreno tremare sotto i piedi.

Come nei migliori romanzi di fantapolitica, ma senza bisogno di inventare nulla, la realtà si prende la scena con l’eleganza rozza del potere crudo. Donald Trump ha deciso di ritirare la nomina di Jared Isaacman alla guida della NASA. Un nome che ai più dirà poco, ma che per Elon Musk e il suo impero interplanetario valeva oro. Letteralmente. L’oro dei contratti spaziali, quelli che gonfiano i bilanci di SpaceX come booster al decollo. La motivazione ufficiale? Isaacman ha avuto la malaugurata trasparenza di donare in passato ai Democratici. Imperdonabile eresia per il Gran Sacerdote di Mar-a-Lago.