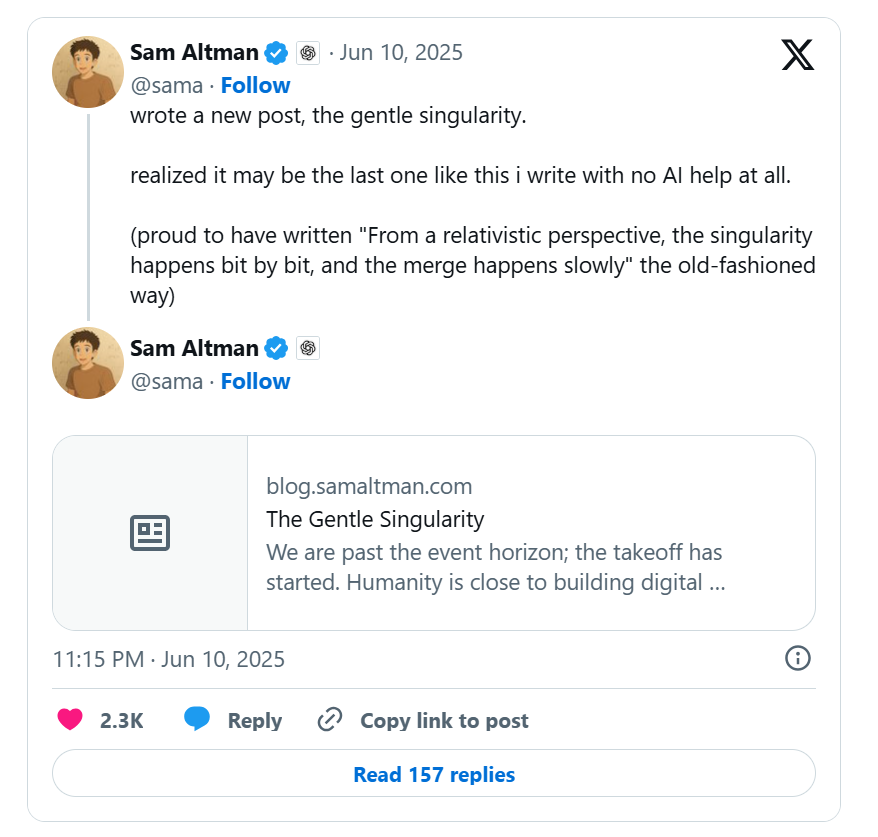

C’è qualcosa di paradossale nella calma con cui Sam Altman annuncia che l’umanità ha appena varcato un “event horizon” verso la superintelligenza. Come se stesse commentando la temperatura del tè, il CEO di OpenAI ha scritto: “Siamo oltre il punto di non ritorno; il decollo è iniziato.” È il tipo di frase che dovrebbe causare panico, o almeno un improvviso bisogno di respirare profondamente. Invece, niente. La reazione globale? Un misto di entusiasmo, scetticismo e una scrollata di spalle tecnologicamente rassegnata.

Secondo Altman, ci stiamo avviando verso quella che chiama singolarità morbida, un passaggio dolce ma inesorabile verso l’intelligenza digitale superiore. Non la distopia di Skynet, non l’esplosione prometeica di una mente artificiale che ci ridicolizza; piuttosto, una transizione “gestibile”, graduale, quasi noiosamente prevedibile. Il problema è che, come ogni vera rivoluzione, anche questa si maschera da evoluzione lineare.

La parola chiave qui è superintelligenza, e le due satelliti che orbitano attorno alla sua gravità semantica sono singolarità e agenti cognitivi. Altman crede che siamo già dentro la curva ascendente dell’intelligenza digitale. E i numeri sembrano dargli ragione. ChatGPT ha raggiunto gli 800 milioni di utenti settimanali. Per capirci, è più della popolazione dell’Unione Europea. Un’umanità parallela, iperconnessa, che si affida quotidianamente a un’intelligenza sintetica per scrivere, progettare, risolvere, argomentare e – ironia suprema – pensare.

Altman dice che “scrivere codice non sarà mai più la stessa cosa”. Ma chi scrive codice sa già che è vero. Il tempo impiegato a combattere con la sintassi o a ricordare il nome esatto di un metodo JavaScript si è ridotto a una ricerca semantica dentro un prompt. Più che uno strumento, GPT è diventato un compagno cognitivo. Ecco dove sta la vera rottura epistemologica: non stiamo semplicemente automatizzando il lavoro, stiamo automatizzando il pensiero.

La retorica dell’event horizon è affascinante perché viene dalla fisica, non dalla filosofia. È il bordo di un buco nero, oltre il quale nulla può sfuggire, nemmeno la luce. Una metafora perfetta per il momento attuale: abbiamo già superato il punto in cui l’intelligenza artificiale può essere “disinventata”. Ora resta solo da capire se il nostro viaggio sarà gravitazionale o esplosivo.

Altman non è cieco ai rischi. Parla di allineamento, di evitare il controllo centralizzato, di mettere in campo conversazioni globali sui valori da instillare nei sistemi cognitivi avanzati. Parole sacrosante, ma anche squisitamente vaghe. È come dire: “Bisogna che l’umanità sia buona, giusta, razionale.” D’accordo, ma chi lo decide? Google? L’ONU? Un comitato misto USA-Cina? O peggio, un consiglio di amministrazione?

Nel frattempo, OpenAI sfida un’ingiunzione del tribunale che la obbliga a conservare tutti i dati degli utenti, comprese le conversazioni cancellate. Non è una sottotrama trascurabile: l’idea che le nostre interazioni più personali con un’AI debbano essere archiviate come prove in un tribunale segna un’ulteriore ibridazione tra intelligenza sintetica e identità umana. Non si tratta più di strumenti, ma di archivi viventi della nostra coscienza digitale.

Nel suo post, Altman afferma che nel 2026 avremo sistemi capaci di scoprire intuizioni originali. Nel 2027, robot capaci di agire nel mondo fisico. Nel 2030, dice, la capacità di pensare e generare idee sarà ampiamente distribuita. Qui il salto qualitativo è notevole: stiamo parlando di democratizzazione dell’ideazione, ovvero la possibilità che chiunque, ovunque, possa accedere a un livello di pensiero e innovazione prima riservato all’élite.

Il vero paradosso è che questi prodigi non ci stupiranno. “Le meraviglie diventano routine”, scrive Altman. È il fenomeno della banalizzazione dell’incredibile, la capacità dell’umano di adattarsi rapidamente anche alle trasformazioni più radicali. L’assistente AI che ieri ci lasciava a bocca aperta oggi è semplicemente la baseline. Un’aspettativa minima, come il Wi-Fi gratuito o la consegna in 24 ore.

Altman dice che tutto questo è “molto meno strano di quanto dovrebbe”. Ma forse è qui che l’umanità si gioca la partita. Nel suo comfort dissonante di fronte all’inimmaginabile, nella sua capacità di accogliere una superintelligenza come se fosse solo un’altra startup con una bella interfaccia.

Il futuro che ci dipinge Altman è iper-razionale, scalabile, interoperabile, pieno di API per la conoscenza. Ma sotto questa superficie algoritmica si agita una domanda inquietante: se l’intelligenza diventa ubiqua, cosa resta di umano nella conoscenza?

Forse la risposta è nella nostra capacità di assuefarci, di adattare il nostro pensiero alla nuova normalità sintetica. O forse, come scriveva il fisico John Archibald Wheeler, “noi non siamo osservatori passivi dell’universo, ma partecipanti attivi nella sua evoluzione”.

Nel frattempo, il takeoff è iniziato. E nessuno ha ancora chiesto se preferiamo il finestrino o il corridoio.