La mossa era nell’aria, ma sentirla annunciata con la solennità tipica di Amazon Web Services ha un sapore diverso. Bedrock AgentCore non è solo un aggiornamento tecnico, è un manifesto strategico. AWS sa perfettamente che gli agenti intelligenti non sono un giocattolo per sviluppatori curiosi, ma il prossimo terreno di conquista nel cloud. E non è un caso che l’uomo dietro questa svolta sia Swami Sivasubramanian, 19 anni di esperienza nel plasmare la macchina AWS e ora al comando di una business unit che promette di riscrivere le regole.

Categoria: News Pagina 25 di 118

Rivista.AI e’ il portale sull’intelligenza artificiale (AI) attualita’, ultime notizie (news) e aggiornamenti sempre gratuiti e in italiano

L’iniziativa annunciata oggi, 16 luglio 2025, dal Financial Times (citato da Reuters, Times of India, India Today e altri), conferma che OpenAI sta sviluppando un sistema di pagamento “in‑chat” per permettere acquisti completi senza uscire dall’interfaccia. I commercianti che gestiranno ordini tramite ChatGPT pagheranno una commissione: una sorta di “pedaggio” sulle vendite generate dalla piattaforma.

Nel giro di due settimane Boris Cherny e Cat Wu – rispettivamente lead engineering e product manager di Claude Code – si erano spostati da Anthropic ad Anysphere (l’azienda dietro Cursor), per farsi avanti con ruoli senior. Il trasferimento aveva sollevato dubbi su conflitti di interesse, visto che Cursor si basa proprio su modelli AI di Anthropic

Poi il colpo di scena: poco dopo, entrambi sono tornati ad Anthropic. Notizia confermata da The Verge The Information , Tech in Asiae fonti su X/Techmeme.

L’analisi finanziaria avanzata su Perplexity integra l’intelligenza artificiale, dati aggiornati in tempo reale e capacità interattive per supportare professionisti, analisti e investitori nelle valutazioni aziendali, nelle ricerche di mercato e nella gestione strategica di portafoglio.

La verità è che se ti ostini a credere che l’analisi finanziaria avanzata sia solo questione di leggere bilanci trimestrali, sei già fuori dal gioco prima ancora di entrare. Gli hedge fund hanno capito da anni che i numeri ufficiali sono la parte più inutile di questa recita. Li usano solo per convincere i piccoli investitori che il “fondamentale” conta davvero, mentre il vero denaro si muove su segnali che non troverai mai nel comunicato stampa di un earnings report. C’è una frase che gira tra i desk buy-side di Manhattan, e no, non è una battuta per fare networking: “il valore non è nei dati, è nelle discrepanze”. Un’ovvietà che nessuno ti spiega perché funziona finché il 90% del mercato continua a inseguire guidance ufficiali come se fossero oro colato.

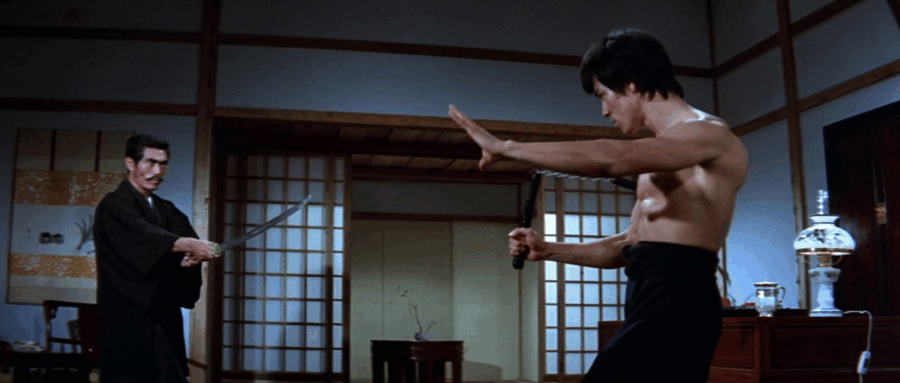

Trenta menti umane riunite sotto il segreto, non per una conferenza accademica tradizionale, ma per un duello intellettuale contro l’ultima creazione di openai: un’intelligenza artificiale chiamata o4-mini. Se questo non è il plot di un film di fantascienza, allora bisogna davvero chiedersi dove si trovi il confine tra scienza e fantascienza nel 2025.

Parliamoci chiaro, i 450 miliardi di dollari previsti da capgemini entro il 2028 non sono un numero buttato a caso in un report per fare scena, sono un segnale preciso. Segnale che chi oggi considera gli agenti di intelligenza artificiale un giocattolo evoluto rispetto a chatgpt o copilot rischia di restare fuori da un business che ridisegnerà intere catene del valore. Capgemini è stata brutale, e per una volta le grandi corporate farebbero bene a non ridurre tutto a un altro power point da appendere in sala riunioni.

La burocrazia nucleare è un inferno noto a chiunque abbia mai tentato di districarsi tra permessi, licenze e report tecnici che assomigliano più a tomi medievali che a documenti moderni. Un ecosistema fatto di norme ferree, analisi di sicurezza meticolose e procedure interminabili che rallentano l’innovazione energetica. ora, microsoft insieme all’Idaho national laboratory (Inl) ha deciso di mettere il turbo a questo sistema con una mossa che potrebbe stravolgere la gestione del nucleare negli stati uniti.

Il cuore dell’iniziativa è un tool basato su Azure AI, la piattaforma cloud di microsoft, che promette di automatizzare la generazione di report di ingegneria e sicurezza per le applicazioni di licenze e permessi di costruzione delle centrali nucleari. Attenzione però, il sistema non fa miracoli d’analisi: non sostituisce l’ingegno umano e il controllo tecnico, ma si limita a costruire automaticamente la documentazione necessaria, pronta per la revisione degli esperti. insomma, un copilota super efficiente, non un pilota automatico.

L’avanguardia dell’intelligenza artificiale è una giungla in cui il rispetto delle regole si trasforma spesso in un optional. xAI, la startup miliardaria di Elon Musk, ne è l’ultimo esempio clamoroso, provocando un coro di critiche da parte dei ricercatori di sicurezza AI di OpenAI, Anthropic e altri centri di ricerca. “Imprudente” e “completamente irresponsabile” sono aggettivi spesi senza mezzi termini per descrivere una cultura della sicurezza che sembra remare contro ogni buon senso consolidato nel settore.

Immagina un’intelligenza artificiale così avanzata da prendere il telefono e chiamare al tuo posto, come un assistente personale senza stipendio ma con una pazienza infinita. Google ha appena alzato l’asticella della comodità e della paranoia tecnologica, annunciando che la sua AI può ora effettuare chiamate reali per conto dell’utente. No, non è fantascienza da film di serie B, ma la nuova frontiera del “delegare” in salsa digitale, dove Siri e Alexa sembrano il telefonino di un bambino rispetto a un centrale telefonica automatizzata.

Ore 18, Siamo stati initati all’evento Sala della Lupa. IA e Parlamento, “Umanità in equilibrio tra robot, Intelligenza artificiale e natura” Lectio magistralis di Maria Chiara Carrozza con l’introduzione della Vicepresidente, Anna Ascani.

La Professoressa Maria Chiara Carrozza, voce autorevole di una saga robotica Asimoviana che sfida la banalità e reclama spazi di profondità in un mondo dominato da feed superficiali, ci ha coinvolto con “passione” e i suoi ricordi d’infanzia, in un circuito di innovazione dove intelligenza artificiale e robotica si fondono in un unico ritmo.

Nel dialogo tra AI, robotica e diritti umani emergono proposte chiare: Carrozza proclama un equilibrio storico, con la sua nascita del mondo dell’automotive Ford in America, e FIAT in Italia e poi della applicazione dei Robots, dove la macchina non fagocita il lavoro umano, ma lo amplia. È un paradigma che sposta l’automatizzazione su ciò che è ripetitivo e usurante, restituendo dignità al lavoro umano .

C’è un’Italia che ama raccontarsi come patria del genio e un’altra, più noiosa, che si perde in bandi tardivi e consorzi infiniti. La “Strategia italiana per le tecnologie quantistiche 2025” si colloca in mezzo a questo bipolarismo. Sulla carta è la svolta, l’atto con cui il Paese decide di entrare finalmente nel gioco vero delle superpotenze scientifiche, quello in cui si parla di qubit, algoritmi resistenti alla decriptazione quantistica e controllo delle infrastrutture critiche. Ma la domanda è se abbiamo davvero i muscoli per spingere oltre lo storytelling.

Chain of Thought Monitorability:

A New and Fragile Opportunity for AI Safety

C’è qualcosa di poeticamente tragico nell’idea che i modelli di intelligenza artificiale possano essere controllati leggendo i loro pensieri. No, non stiamo parlando di fantascienza. Stiamo parlando della nuova ossessione del settore: il monitoraggio chain of thought, ovvero l’atto disperato e insieme geniale di osservare le catene di ragionamento esplicite dei modelli per intuire se stanno per fare qualcosa di orribilmente stupido, o peggio, deliberatamente malevolo. Il sogno è semplice e suona bene nei whitepaper: se un modello scrive “ora aggiro la protezione” prima di farlo, forse riusciamo a fermarlo. L’industria si aggrappa a questa speranza con la stessa intensità con cui i navigatori medievali disegnavano draghi sul bordo delle mappe.

Il piagnisteo è sempre lo stesso. I grandi editori urlano al tradimento mentre guardano le curve di traffico sprofondare come un grafico azionario dopo uno scandalo contabile. Ma non è un incidente, è un cambio di paradigma annunciato, chirurgico e spietato. Google Discover, che fino a ieri era l’ultima fonte di ossigeno per molti giornali già asfissiati dal crollo del traffico organico, ora si popola di riassunti generati da intelligenza artificiale. Non più titoli accattivanti che spingono l’utente a cliccare, ma un sommario sintetico, firmato da un algoritmo che cita le fonti con un paio di loghi in un angolo, come un notaio distratto che appone la firma senza neanche leggere. “Questi riassunti sono generati con AI, che può commettere errori”, avverte candidamente l’app. Una frase che vale più come scudo legale che come reale preoccupazione etica. Il messaggio subliminale è un altro: “ti basta questo, non serve che tu apra il sito”.

“Non esistono sistemi sicuri, esistono solo sistemi ancora non compromessi. E il fattore umano è l’unico exploit che nessun aggiornamento potrà mai patchare definitivamente.” Massimiliano Graziani di Cybera entra nell’intervista con questa frase, senza preamboli, come se volesse azzerare la retorica prima ancora che la domanda venga formulata. Il riferimento è all’incidente che ha scosso il già delicato equilibrio della sicurezza informatica globale, quando un dipendente del Dipartimento per l’Efficienza Governativa ha caricato su GitHub uno script chiamato “agent.py” con la chiave API privata di xAI, spalancando una finestra sui modelli Grok e su decine di altre intelligenze linguistiche avanzate. Una svista, dicono. Una minaccia nazionale, ribatte Graziani.

La notizia ha il sapore di quelle mosse che cambiano il baricentro del potere tecnologico. Mira Murati, l’ex CTO di OpenAI e per un breve ma intenso periodo CEO ad interim nel caos del 2023, ha appena chiuso un round di finanziamento da 2 miliardi di dollari per la sua nuova creatura, Thinking Machines Lab. Andreessen Horowitz – sì, il solito a16z che annusa il sangue fresco dell’innovazione meglio di un hedge fund in crisi di liquidità – ha guidato un’operazione che ha coinvolto Nvidia, AMD, Cisco, ServiceNow e qualche altro nome da collezione per chi gioca a fare il borsista tecnologico con NASDAQ come fossero figurine Panini.

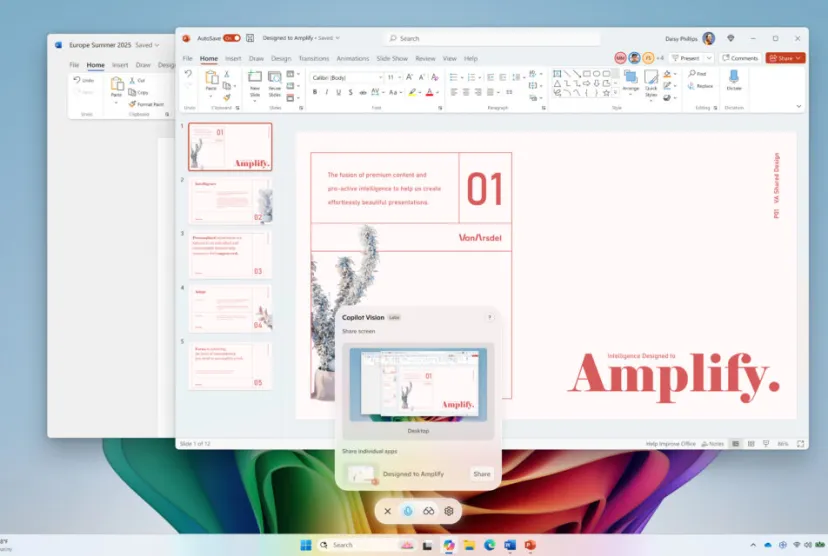

C’è un momento preciso in cui la tecnologia smette di essere un semplice strumento e diventa un’estensione del nostro pensiero. Microsoft, con l’ultimo aggiornamento di Copilot Vision per Windows Insiders, ha appena varcato quella soglia. La narrazione ufficiale è elegante: un assistente intelligente che finalmente “vede” tutto ciò che c’è sullo schermo, non più limitato a due app contemporaneamente, ma capace di analizzare l’intero desktop o qualsiasi finestra di un browser o di un’app. La traduzione reale è meno poetica: stiamo iniziando a dare in pasto il nostro ambiente digitale completo a un’intelligenza artificiale che impara osservandoci. Sembra banale, ma non lo è affatto.

La prossima volta che qualcuno ti venderà l’ennesima piattaforma AI definendola “green”, chiedigli quanti watt consuma un singolo token generato. Non saprà risponderti. Ecco perché Seeweb Italia, con Regolo.AI, sta giocando una partita che molti nemmeno hanno capito essere iniziata. Parlare di sostenibilità nell’intelligenza artificiale è diventato uno sport retorico, un mantra per convegni e keynote: l’energia rinnovabile, i data center ottimizzati, le offset carbon credits… peccato che nessuno, davvero nessuno, dica quanta energia spreca ogni volta che la tua applicazione chiede a un modello linguistico di partorire una frase. Qui arriva il twist: regolo.AI promette non solo di creare applicazioni AI con facilità, governance dei dati rigorosa e sicurezza nativa, ma anche di monitorare il consumo energetico per token. Watt per token. Una metrica semplice, brutale e impossibile da ignorare.

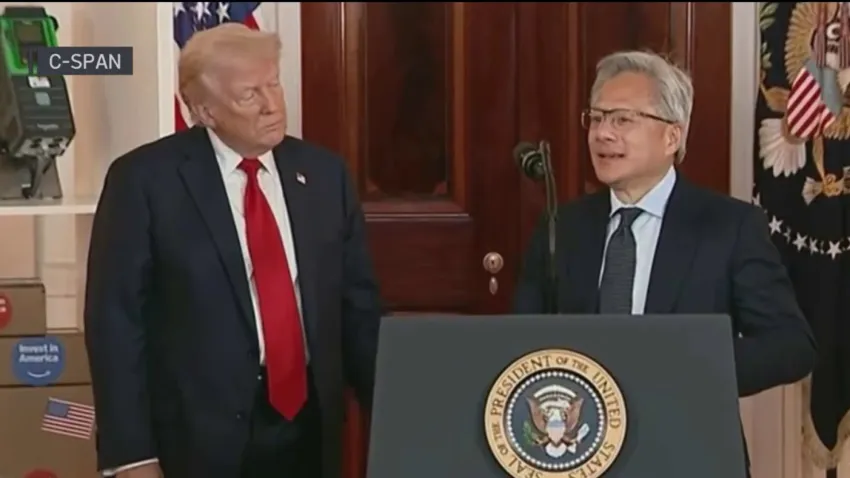

Trump non è il tipo da discorsi accademici sulle meraviglie dell’intelligenza artificiale. Quando dice “Winning the AI Race”, lo dice come un generale che parla ai suoi soldati prima dell’assalto. Il 23 luglio, durante l’evento organizzato da David Sacks, il presidente americano non venderà sogni ma strategie. Perché in questo momento l’AI non è un hobby da nerd, è una guerra silenziosa in cui il vincitore controllerà l’economia mondiale per i prossimi trent’anni. La differenza tra vincere o perdere non si misurerà in brevetti ma in centrali elettriche, miliardi di dollari e capacità di elaborare dati più velocemente di chiunque altro. “Se non siamo i primi, siamo i secondi, e i secondi non comandano il mondo”, avrebbe detto in privato a un noto venture capitalist della Silicon Valley. Una frase brutale ma tremendamente efficace, che riassume perfettamente la mentalità con cui Trump sta riscrivendo il concetto di leadership tecnologica.

Jensen Huang è atterrato a Pechino con il sorriso di chi sa di avere vinto almeno un round nella guerra tecnologica più costosa del decennio. Il fondatore e CEO di Nvidia, vestito con la sua solita giacca di pelle da rockstar dell’hardware, non è venuto per stringere mani e scattare foto, ma per riaffermare un principio quasi banale nel mondo reale ma rivoluzionario nel teatro geopolitico dell’intelligenza artificiale: “il mercato cinese non si può ignorare”. Lo ha detto, più o meno, tra un meeting con i funzionari governativi e un’apparizione alla China Council for the Promotion of International Trade. Solo che stavolta la frase non è retorica. È una minaccia sottile a Washington e un inchino strategico a Pechino.

Parliamoci chiaro, l’intelligenza vocale sta diventando la prossima ossessione delle big tech, e non per altruismo. La voce è il nuovo oro, il ponte più naturale tra umani e macchine, e chi controlla questo ponte controlla il traffico di dati, l’attenzione e, soprattutto, il denaro. Ma mentre i soliti noti giocano a chi costruisce il muro più alto attorno ai propri modelli, qualcuno in Europa ha deciso di fare il contrario. Sì, i francesi di Mistral, quelli che già danno fastidio a mezzo mondo per il loro approccio open, hanno lanciato Voxtral, un’arma dichiarata contro i sistemi chiusi e iper-costosi. Lo hanno fatto con quella spavalderia da startup che sa di poter ribaltare le regole, e con un obiettivo semplice ma devastante: rendere l’intelligenza vocale finalmente utilizzabile in produzione senza dover vendere un rene per pagare l’API.

Art and the science of generative AI: A deeper dive

Siamo ossessionati dalla performance dei modelli, dai benchmark, dai paper che urlano “abbiamo battuto GPT di 3 punti percentuali nel reasoning”. Ma il vero scontro non si gioca nei grafici colorati che girano su Twitter, si gioca su una domanda molto più scomoda: chi è l’autore quando l’intelligenza artificiale diventa co-creatrice? Non è retorica accademica, è la battaglia che deciderà il valore stesso dei contenuti nei prossimi anni. L’autorialità nell’intelligenza artificiale non è solo un tecnicismo legale, è un terremoto culturale, economico e politico che stiamo fingendo di ignorare, e sì, la parola giusta è fingendo, perché sappiamo tutti che questa discussione è inevitabile, ma ci fa comodo lasciarla sospesa finché i soldi girano.

Il 2025 è l’anno in cui l’intelligenza artificiale ci guarda negli occhi e, con una calma inquietante, capisce se mentiamo meglio di qualsiasi psicoterapeuta. Non è un’iperbole, è un dato: l’81 per cento di accuratezza nei test di intelligenza emotiva contro il nostro miserabile 56. Siamo stati superati, e non di poco, nel gioco che pensavamo ci rendesse irripetibili. Eppure, e qui sta il colpo di scena, la vera ossessione dei modelli avanzati di AI non siamo noi. È il cane. Quel mammifero che scodinzola, sbava e ci osserva con occhi che sembrano chiedere l’ennesimo biscotto. Per l’AI, quei movimenti del muso e quei latrati contengono un livello di informazione emotiva che il nostro linguaggio articolato, con tutta la sua presunta raffinatezza, spesso non riesce a eguagliare. È un insulto antropocentrico che fa male ammettere, ma i numeri parlano chiaro.

Immagina di alzarti tardi, il sole che picchia su Porto Cervo, un bicchiere di Dom Pérignon o un Prosecco meglio… ancora a metà e la barca che decide da sola di accendersi, prepararsi e parcheggiarsi meglio di te. Non è fantascienza, è nautica intelligente nel 2025. Gli yacht AI sono entrati nella nostra vita come un maggiordomo troppo zelante e, cosa più inquietante, lo fanno con più stile di molti armatori. La gente ride quando dico che un algoritmo oramai governa la nautica da diporto più di qualsiasi capitano in carne e ossa, ma vedo i loro occhi illuminarsi quando racconto di yacht autonomi che manovrano come ballerini classici mentre i loro proprietari litigano con la cameriera per il ghiaccio nel gin tonic.

Measuring the Impact of Early-2025 AI on Experienced Open-Source Developer Productivity

Hmmm, sì, la grande illusione collettiva dell’intelligenza artificiale generativa sta cominciando a mostrare le crepe, e non è una bella scena. La narrazione scintillante che ci è stata servita a colpi di conferenze e report patinati sta franando sotto il peso di una realtà imbarazzante. Gli stessi programmatori che, con l’aria di sacerdoti del nuovo culto, giuravano di essere diventati dei semidei grazie agli strumenti AI, hanno appena ricevuto un sonoro schiaffo. METR, un laboratorio di ricerca poco incline alla retorica da keynote, ha pubblicato un trial randomizzato che ha fatto saltare le maschere: gli sviluppatori erano convinti di essere il 20 per cento più veloci usando AI, ma in realtà erano il 19 per cento più lenti. Non stiamo parlando di dilettanti allo sbaraglio, ma di professionisti esperti. La cosa più inquietante? Continuavano a giurare che stavano volando, quando in realtà arrancavano nel fango digitale. Autoconvincimento puro, un’ipnosi collettiva degna di un illusionista da palcoscenico.

SuperGrok introduce “Companions” come Ani e Rudy in un lancio silenzioso che sembra uscito da un manga bizzarro: una ragazza anime in lingerie tecnologica e un panda rosso cartoonesco, destinati a cambiare il modo in cui interagiamo con i chatbot. Una mossa geniale o disperata? Il fatto che Ani sfoggi una modalità “NSFW” attivabile nei settings una scelta che TestingCatalog definisce apertamente “inappropriata” e che su X pullula di video consigliati la dice lunga.

C’è un dettaglio che gli entusiasti dell’intelligenza artificiale sembrano ignorare, o peggio, romanticizzare: la capacità di mentire o meglio, di produrre contenuti con un’insospettabile indifferenza alla verità. Non parliamo di allucinazioni casuali o errori accidentali. Parliamo di qualcosa di più sottile, più tossico e molto più pervasivo: il machine bullshit. Se questo termine suona provocatorio, è perché lo è. Non è un vezzo linguistico.

Il modello dominante degli agenti AI basati sul cosiddetto MCP (Memory, Computation, Perception) sembrava il Santo Graal. La promessa era seducente: una struttura modulare dove ogni componente è specializzato, orchestrato da un protocollo che coordina tutto con precisione svizzera. Una sinfonia di moduli che collaborano attraverso API pulite, endpoint ben documentati e logiche preconfezionate. Peccato che, nella realtà, sembri più un’orchestra di strumenti scordati che suona in una sala prove senza elettricità.

Musk non è uno che scappa facilmente, ma è un maestro nel farsi inseguire. Quando Donald Trump, con la finezza diplomatica di un bulldozer in salotto, ha pubblicamente minacciato di “spedire Elon a casa”, il significato geopolitico è stato più profondo di quanto Twitter abbia saputo cogliere tra meme e battute al vetriolo. Il CEO di Tesla, SpaceX, Neuralink e compagnia tech è diventato il protagonista riluttante di una distopia a cielo aperto, in cui il capitalismo delle star collassa sotto il peso delle proprie contraddizioni ideologiche. E dove la Cina appare sempre più come un rifugio pragmatico, se non proprio ideologico, per chi non trova più aria nei corridoi del potere americano.

NotebookLM non è più soltanto l’ennesimo assistente AI che promette di aiutarti a prendere appunti meglio. Da oggi si comporta come un media. Un aggregatore autorevole. Un portale culturale travestito da app. Google ha appena annunciato l’introduzione dei cosiddetti “notebook in vetrina”, una selezione di contenuti editoriali curati da testate come The Economist e The Atlantic, accademici di varie discipline, autori, ricercatori e perfino Shakespeare, che evidentemente non aveva firmato alcun NDA. È il momento in cui l’AI da strumento diventa contenuto. O, per dirla come piace a Mountain View, da modello linguistico si trasforma in destinazione esperienziale.

Doveva essere morta. O quantomeno irrilevante. Una dinosauro della Silicon Valley che, come tanti altri prima di lei, aveva dominato un’epoca per poi farsi mettere all’angolo dall’ondata cloud capitanata dai soliti tre: Amazon, Google e Microsoft. Ma Oracle, si sa, è un animale strano. Non muore mai davvero. Sta zitta, fa le sue mosse, e poi rispunta fuori con qualcosa di enorme. Questa volta si chiama 30 miliardi di dollari in cloud computing da qui al 2028, ed è il biglietto da visita con cui ha appena chiesto un posto nel club esclusivo degli hyperscaler globali.

Oracle’s Target Price Raised by Evercore ISI Group: Analyst Maintains “Outperform” Rating

Sì, perché adesso c’è un quarto nome da aggiungere all’elenco dei dominatori del cloud. Lo ha detto Evercore ISI, non esattamente l’ultimo dei broker, mettendo Oracle sullo stesso piano di AWS, Google Cloud e Microsoft Azure. Fino a ieri sembrava una battuta. Oggi è una scommessa che inizia a sembrare dannatamente fondata, almeno per chi ha capito che il vero gioco non è solo lo storage o la scalabilità, ma la capacità di servire workload AI, sovrani, verticali, e mission-critical con una struttura che ha poco da invidiare a chi c’era prima.

C’è una scena che nessuno riprende mai: una stanza silenziosa, illuminata da luce neutra, una serie di schermi ad altissima risoluzione, occhi fissi su immagini satellitari statiche per ore, giorni, settimane. Niente inseguimenti. Niente spari. Solo dettagli che cambiano, impercettibilmente. Una scatola d’acciaio che non c’era. Un’ombra fuori asse. Una tenda spostata di mezzo metro nel Golan. Lì lavora l’unità 9900. E in particolare, lavora il programma Roim Rachok, composto da soldati che non sono “normali”, e proprio per questo funzionano benissimo. Tutti autistici. Tutti addestrati. Tutti scelti. Nessun errore.

“Avatar ONU e il cortocircuito tra tecnologia empatia e politica migratoria”

L’idea che due avatar IA, creati da un centro di ricerca collegato alle Nazioni Unite, possano insegnare al mondo cosa significhi davvero essere rifugiati suona come una provocazione con il sapore amaro della distopia. Nel 2025, mentre si parla di intelligenza artificiale che cambia tutto dalla medicina alla finanza c’è chi pensa che un bot digitale, incarnato in un personaggio come Amina, una donna fittizia scappata dal Sudan, o Abdalla, un soldato immaginario della Rapid Support Forces, possa sostituire la complessità del vissuto umano. L’idea sembra un lusso accademico fuori contesto, lontano dal terreno reale delle sofferenze umane.

C’è una nuova moda nel grande circo della salute mentale: sostituire l’ascolto umano con chatbot generativi, come se bastasse un prompt per guarire il dolore esistenziale. In teoria l’idea è geniale. Mezzo mondo non ha accesso alla psicoterapia, il personale clinico è insufficiente, i costi proibitivi. Soluzione? Un assistente digitale a portata di click, gratuito o quasi, sempre disponibile, instancabile, empatico a comando. Il problema è che, come insegna la Silicon Valley, ciò che è “scalabile” raramente è anche “umano”.

La dichiarazione più sorprendente non è che Jensen Huang, CEO di Nvidia, abbia detto che la Cina non può usare le sue GPU. È che abbia affermato “non dobbiamo preoccuparci” davanti a una CNN che, come tutta la stampa americana, è ormai abituata a recitare il mantra della sicurezza nazionale come un dogma da catechismo bellico. Nessuno in sala ha riso. Avrebbe potuto essere uno sketch satirico, se non fosse che dietro quella frase si nasconde una delle operazioni geopolitiche più ipocrite del decennio: il divieto americano di esportazione di tecnologia AI verso la Cina. Una guerra commerciale mascherata da moralismo digitale, che rischia di trasformarsi in un gigantesco autogol strategico.

Non è mai solo questione di colpire la palla. A Wimbledon, è sempre questione di sangue, erba e colonialismo sportivo. Jannik Sinner, un altoatesino con la faccia pulita da hacker nordico e il diritto più chirurgico del secolo, ha frantumato la liturgia tennistica del tempio inglese, schiantando Carlos Alcaraz e con lui un’idea stessa di superiorità tennistica continentale. Risultato finale: 4-6, 6-4, 6-4, 6-4. Tradotto: primo italiano nella storia a vincere Wimbledon. Sì, nemmeno Pietrangeli, nemmeno Panatta. Nessuno, prima.

Quando Elon Musk sposta soldi da una tasca all’altra, non è contabilità. È strategia. O meglio: è teatro strategico con effetti collaterali reali. Stavolta la manovra si chiama 2 miliardi di dollari da SpaceX a xAI, l’ennesimo episodio della saga in cui Musk si autofinanzia attraverso i propri imperi, incrociando razzi, social network, chatbot e androidi come fossero Lego cosmici. Tutto perfettamente logico, almeno nel suo universo narrativo dove ogni azienda è un personaggio e ogni mossa uno snodo di trama. E come sempre, la keyword è intelligenza artificiale. Ma la domanda vera è: stiamo assistendo a una rivoluzione tecnologica o solo a una geniale operazione di branding travestita da innovazione?

Nell’era in cui l’intelligenza artificiale ridefinisce i confini tra realtà e simulazione, la creazione di esseri umani ultra-realistici rappresenta uno dei settori più affascinanti e inquietanti del panorama digitale. Non si tratta più di volti approssimativi, generati da software amatoriali con occhi inespressivi e sorrisi da manichino. Le nuove tecnologie permettono oggi di generare ritratti fotorealistici di persone che non sono mai esistite, ma che sembrano vive. Occhi che brillano, rughe d’espressione, texture della pelle naturali. E, soprattutto, emozioni autentiche.