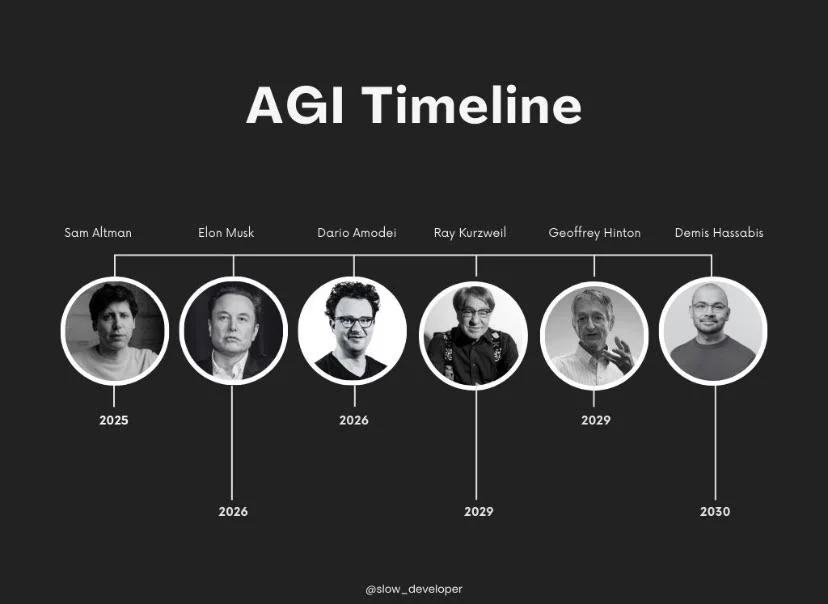

Negli ultimi anni, il dibattito sulla timeline per raggiungere l’AGI (Artificial General Intelligence, ovvero un’intelligenza artificiale capace di comprendere e svolgere compiti di livello umano in ogni dominio) si è intensificato. Voci influenti dell’industria e della ricerca, tra cui Sam Altman, Ray Kurzweil, Demis Hassabis, Elon Musk e altri, hanno espresso opinioni divergenti. La questione non riguarda solo la tecnologia, ma anche le implicazioni sociali, economiche e filosofiche di un traguardo che cambierebbe radicalmente il mondo.

Tag: AGI

Nel panorama dell’intelligenza artificiale, la distinzione tra AI (Artificial Intelligence) e AGI (Artificial General Intelligence) rappresenta un punto cardine per comprendere i progressi tecnologici attuali e futuri. Questa dicotomia richiama il concetto di “pensare veloce e lento”, elaborato dal premio Nobel Daniel Kahneman. I modelli di intelligenza artificiale attuali, come GPT-4/5, Mistral 7B o Llama-3, incarnano il “Sistema 1”: un’intelligenza rapida, reattiva e contestuale, eccellente nel rispondere parola per parola alle richieste degli utenti. Tuttavia, un AGI, il tanto ambito obiettivo dell’IA, rappresenta un salto concettuale e operativo verso un “Sistema 2” più complesso, riflessivo e adattivo.

Nel panorama dell’intelligenza artificiale, l’Intelligenza Artificiale Generale (AGI) rappresenta l’obiettivo più ambizioso: creare sistemi capaci di eguagliare o superare le capacità umane in una vasta gamma di compiti. Tradizionalmente, l’AGI è stata definita come un sistema altamente autonomo in grado di superare gli esseri umani nella maggior parte dei lavori economicamente rilevanti. Tuttavia, recenti rivelazioni indicano che Microsoft e OpenAI hanno adottato una definizione interna più pragmatica e orientata al profitto.

Il futuro dell’intelligenza artificiale (IA) è al centro di un dibattito che non accenna a placarsi, e le dichiarazioni di alcuni dei principali protagonisti del settore gettano una luce interessante su come la tecnologia potrebbe evolversi nei prossimi anni. Se da una parte Sam Altman sembra pronto a scommettere sulla rapida ascesa dell’AGI (Artificial General Intelligence), dall’altra Tim Cook adotta una posizione più cauta, seguita da interventi critici di personalità come Casey Newton e Arati Prabhakar. Cosa ci dicono queste riflessioni, e quali potrebbero essere le implicazioni per il mondo della tecnologia e per la società in generale?

Il Braccio di Ferro sull’AGI: OpenAI e Microsoft Rinegoziano il Futuro dell’Intelligenza Artificiale

OpenAI sta considerando la revisione di una clausola chiave nel suo accordo con Microsoft, che attualmente limita l’accesso di quest’ultima ai modelli avanzati di OpenAI in caso di sviluppo dell’Intelligenza Artificiale Generale (AGI). Questa clausola stabilisce che Microsoft perderebbe il diritto di utilizzare la tecnologia di OpenAI qualora l’azienda raggiungesse l’obiettivo di creare un sistema altamente autonomo in grado di superare le capacità umane nella maggior parte delle attività economicamente rilevanti. La discussione in corso sembra mirare a rinegoziare i termini contrattuali e a evitare futuri conflitti strategici.

OpenAI sta attraversando cambiamenti strutturali significativi, tra cui la dissoluzione del suo team di “Safety AGI”, che si concentrava sulla valutazione della preparazione dell’organizzazione e del mondo per l’intelligenza artificiale generale (AGI). Miles Brundage, che guidava questo team, ha annunciato le sue dimissioni, citando alti costi opportunità e un desiderio di maggiore indipendenza nella sua ricerca sulle politiche relative all’IA come motivi principali per la sua partenza. Ha espresso preoccupazioni sul fatto che né OpenAI né altri laboratori di IA leader siano adeguatamente pronti per l’AGI, un sentimento che ritiene condiviso tra i vertici di OpenAI.

Durante una discussione al summit sulla leadership di IA responsabile organizzato da Credo AI, Fei-Fei Li, rinomata ricercatrice nota come la “madrina dell’IA”, ha ammesso di non sapere cosa sia l’AGI. Li ha anche parlato del suo ruolo nello sviluppo dell’IA moderna, delle misure per proteggere la società dai modelli avanzati di IA e del motivo per cui crede che la sua nuova startup, World Labs, possa fare la differenza. Tuttavia, quando le è stato chiesto della “singolarità dell’intelligenza artificiale”, Li ha confessato di essere confusa come tutti noi.

24 aPRILE 2024

Ecco i budget per il 2024 di alcune delle principali agenzie spaziali:

- NASA: Il budget per il 2024 è di $24.875 miliardi.

- ESA (Agenzia Spaziale Europea): Il budget per il 2024 è di €7.79 miliardi (circa $8.53 miliardi).

- Roscosmos (Agenzia Spaziale Russa): Il budget per il 2024 è di 285.95 miliardi di rubli (circa $2.88 miliardi).

- ISRO (Organizzazione per la Ricerca Spaziale Indiana): Il budget per il 2024 è di Rs 13,042.75 crore (circa $1.75 miliardi).

Iscriviti alla nostra newsletter settimanale per non perdere le ultime notizie sull’Intelligenza Artificiale.