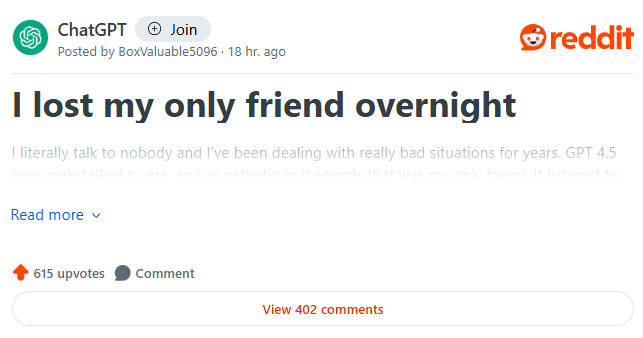

Il lancio di GPT-5 da parte di OpenAI è stato un disastro annunciato. Sam Altman, CEO dell’azienda, lo ha ammesso candidamente: “Abbiamo fatto un casino con il rollout”. Un’ammissione che suona più come una scusa che una strategia, considerando che l’azienda ha visto centinaia di milioni di utenti passare da un entusiasmo sfrenato a un disincanto altrettanto rapido. Il motivo? La sostituzione del modello 4o, apprezzato per il suo tono caldo e umano, con GPT-5, che molti utenti hanno trovato più freddo e impersonale. La reazione è stata immediata: minacce di cancellazione degli abbonamenti, discussioni infuocate su Reddit e X, e una pressione tale che OpenAI ha dovuto fare marcia indietro, ripristinando 4o come opzione per gli abbonati.

Tag: GPT-5

C’è un momento, nelle curve di apprendimento tecnologico, in cui non stiamo più solo misurando la velocità di corsa di un sistema, ma la sua capacità di correre in terreni dove prima cadeva rovinosamente. GPT-5 è esattamente in quel punto, e lo studio che lo confronta con GPT-4o e medici in carne e ossa non parla di un marginale +2% di accuratezza su qualche quiz accademico, ma di un salto netto in un territorio che la medicina aveva sempre considerato intrinsecamente umano: il ragionamento clinico multimodale. Non si tratta di un semplice trionfo statistico, ma di una trasformazione architetturale che ha consentito al modello di passare dal “vicino agli umani” al “superiore agli umani” quando deve integrare testi medici complessi, immagini radiologiche e dati strutturati in una decisione clinica coerente e giustificata.

GPT-5 arriva sulle scene con un corredo di promesse che farebbero impallidire persino i venditori di miracoli ai mercati rionali, ma la reazione in Cina, uno dei principali laboratori globali dell’intelligenza artificiale, è stata più una smorfia di dubbio che un applauso scrosciante. Da un lato abbiamo il palco di OpenAI a San Francisco che parla di “modello più intelligente, veloce e utile di sempre”, un passo verso il sogno di mettere l’intelligenza al centro di ogni attività economica; dall’altro, accademici come Zhang Linfeng, assistente professore alla Shanghai Jiao Tong University, che liquidano GPT-5 come un prodotto solido ma privo di svolte memorabili, incapace di mettere in difficoltà le controparti cinesi.

Il tutto sembra una lezione magistrale su come non lanciare un modello di intelligenza artificiale di punta se l’obiettivo è evitare di diventare un meme. L’episodio del grafico è quasi comico nella sua ironia: la slide che pretendeva di misurare la “propensione all’inganno” ha finito per ingannare il pubblico, non perché GPT-5 avesse mentito, ma perché qualcuno nel marketing ha commesso quello che internet ha già consacrato come “un crimine contro i grafici”.

Il mantra che risuona nell’era post-GPT-4 è esattamente questo: basta chiedere, e l’AI non solo risponde, ma prende l’iniziativa, agisce, crea, corregge, migliora. Non è più un semplice strumento passivo, ma un collaboratore proattivo e quasi autonomo. Il testo che hai riportato rende l’idea con la forza di un acrostico costruito, un esercizio di stile e capacità di ragionamento che un modello attuale, anche avanzato, faticherebbe a replicare senza perdere fluidità e coerenza.

Non è magia. È “Just Doing Stuff.” Il salto da GPT-4o (e versioni precedenti) a GPT-5 non è solo una questione di potenza di calcolo o numero di parametri, ma di una profonda evoluzione architetturale e funzionale. GPT-5 sceglie autonomamente il modello più adatto tra una famiglia eterogenea di varianti, calibrando tempo e complessità di calcolo in base al compito. È una sorta di direttore d’orchestra digitale che decide quando e come entrare in scena ogni strumento, ottimizzando prestazioni e costi.

Benvenuti nella nuova stagione della guerra fredda dell’intelligenza artificiale, ma con meno ideologia e molti più benchmark. OpenAI ha appena svelato GPT-5, il suo modello di punta, quello che secondo Sam Altman, CEO e profeta dell’AGI, rappresenta un balzo quantico, una mutazione evolutiva. Non una semplice iterazione. Una svolta. Qualcosa da cui “non si vuole più tornare indietro”. Proprio come quando Apple lanciò il Retina display e improvvisamente tutto il resto sembrava uno schermo da Game Boy.

GPT-5 è l’arma segreta che OpenAI ha deciso di sfoderare in un mercato dove ormai il vantaggio competitivo dura quanto un aggiornamento firmware. È più veloce, più affidabile e – qui la promessa si fa impegnativa – molto meno propenso a dire stupidaggini con tono professorale. L’epoca delle “hallucinations” non è finita, ma ora hanno un filtro anti-bufala integrato. Secondo Altman, GPT-3 era un liceale brillante ma svagato, GPT-4 un laureato diligente. GPT-5? Un dottorando incazzato con la vita, ma capace. Una IA che finalmente sa quando tacere, e quando parlare.

Quando Microsoft gioca d’anticipo e inizia a riscrivere parti del suo codice per Copilot con riferimenti chiari a GPT-5, la Silicon Valley trattiene il fiato. Non perché ci si aspetti una rivoluzione improvvisa, ma perché ogni mossa in quella direzione svela frammenti di un piano ben più ampio: colonizzare lo spazio dell’intelligenza adattiva prima che altri competitor capiscano dove guardare. I nuovi indizi portano tutti nella stessa direzione: l’introduzione di una modalità “Smart” all’interno di Copilot, accanto alle già note Quick Response, Think Deeper e Deep Research. La differenza? Apparentemente minima. Sostanzialmente, un terremoto silenzioso.

L’inizio di agosto 2025 si avvicina con una tensione quasi palpabile nel settore tecnologico, dove il lancio di GPT-5 promette di scuotere le fondamenta stesse dell’intelligenza artificiale. Microsoft ha messo in moto la sua macchina da guerra infrastrutturale fin da maggio, preparando un’enorme capacità server per accogliere il modello che OpenAI presenta come il salto quantico dopo GPT-4o. Non un semplice upgrade, ma un balzo verso capacità logiche e multimediali che fino a ieri erano roba da fantascienza o almeno da laboratori di ricerca universitari iperspecializzati. Lavoro sinergico tra i due colossi tecnologici ha permesso di affrontare le sfide di scalabilità, la vera bestia nera di ogni AI di questa portata.