Negli anni immediatamente successivi alla Guerra Fredda, il mondo sembrava navigare su un’onda di ottimismo inarrestabile. Studiosi e policymaker predicevano un futuro dove democrazia, globalizzazione e pace avrebbero marciato di pari passo, consolidando un ordine globale stabile e progressista. Francis Fukuyama, con la sua celebre tesi della “fine della storia”, incarnava questa visione: la convinzione che l’evoluzione politica fosse ormai tracciata verso un modello liberale universale. Oggi, trent’anni dopo, quel quadro appare fragile e idealizzato, scalfito da nazionalismi risorgenti, instabilità politica e conflitti continui.

Categoria: Cultura Pagina 1 di 14

Interviste – (DEI) diversità, equità e inclusione – Impatti Sociali ed Etici – Futuro e Prospettive – Legislazione e Regolamentazione -Educazione e Formazione – Lavoro e Formzione

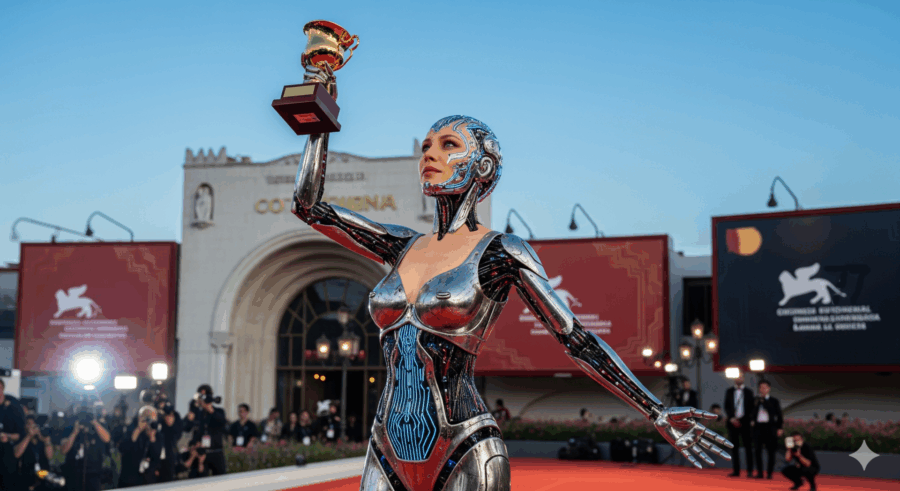

Alla Mostra del Cinema di Venezia quest’anno i riflettori non sono puntati solo sui film e sul red carpet, ma anche su un ospite inatteso: l’intelligenza artificiale. Non una comparsa, ma quasi una protagonista, capace di dividere platea e addetti ai lavori tra chi intravede scenari distopici e chi, invece, fiuta nuove possibilità creative. Eh si, perché autori, attori e doppiatori hanno fatto sentire la loro voce sul tema. L’accusa: l’AI rischia di “fagocitare” il talento umano, sostituire professioni artistiche e ridurre la creatività a un algoritmo di consumo.

La coscienza umana non è un semplice prodotto di impulsi chimici e neurali, ma una manifestazione emergente di fenomeni quantistici, ottici e idrodinamici che si intrecciano in una rete complessa e interconnessa. Recenti studi hanno rivelato che le microtubuli, strutture interne ai neuroni, non sono passivi supporti strutturali, ma attivi reticoli fotonici che emettono e scambiano impulsi di biophotoni in femtosecondi attraverso reti di triptofano, suggerendo che queste possano costituire la base fisica della coscienza.

Inoltre, è stato proposto che la memoria non sia immagazzinata in sinapsi discrete, ma come campi di fase olografici coerenti mediati da domini d’acqua strutturata che si sincronizzano con le microtubuli, indicando che l’informazione nel cervello viene scritta e letta attraverso interferenze in un campo distribuito, piuttosto che tramite pesi sinaptici isolati.

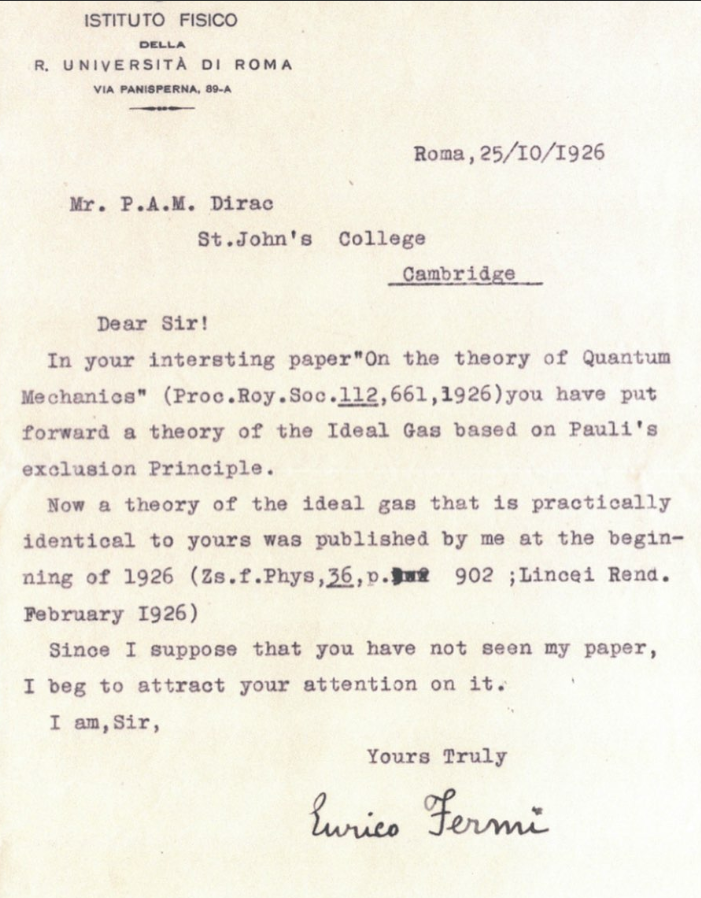

Immagina un’Italia del 1926 dove Enrico Fermi, poco più che trentenne ma già con la postura del professore che detta le regole, si trova di fronte a una questione che riguarda la proprietà delle idee e la velocità della scienza. Paul Dirac, giovane matematico britannico che amava più l’eleganza delle equazioni che la retorica delle parole, pubblica un articolo sulla statistica di un gas di particelle che obbedisce al principio di esclusione di Pauli. Fermi aveva già battuto quella strada pochi mesi prima.

Dirac ci arriva da solo, indipendentemente, come se due navigatori avessero scoperto lo stesso continente nello stesso anno, senza comunicare tra loro. La storia ricorda l’epistola di Fermi a Dirac, in cui il fisico italiano con il suo stile pacato ma pungente, segnala che sì, le equazioni di Dirac erano impeccabili, ma quel terreno era già stato arato. Ne nasce una dialettica che oggi definiremmo “borderline tra la difesa della priorità scientifica e l’accelerazione inevitabile del sapere condiviso”.

Frank Wilczek non è soltanto un premio Nobel in fisica, è una di quelle figure che sfidano la nostra idea stessa di cosa significhi pensare. C’è chi lo considera un visionario, altri un disturbatore di equilibri intellettuali. Forse entrambe le cose sono vere. La sua capacità di muoversi tra la più astratta fisica teorica e intuizioni che sembrano provenire da un’altra dimensione ha trasformato il suo nome in una sorta di marchio della curiosità radicale. Wilczek non si limita a interpretare il mondo, ma lo reinventa in categorie nuove, dalla proposta dell’assione come candidato per la materia oscura fino all’invenzione dei time crystals, quelle strane creature concettuali che fanno tremare le fondamenta del nostro concetto di simmetria.

Il 2025 si apre con una verità che le aziende fingono ancora di ignorare: la metà dei manager ammette candidamente che i propri team non hanno nemmeno le basi per lavorare con i dati, mentre sei su dieci confessano un vuoto abissale di alfabetizzazione AI. Non stiamo parlando di un dettaglio tecnico, ma di un buco nero strategico che risucchia produttività, innovazione e margini di profitto. La narrativa corporate sulla trasformazione digitale sembra più un’operetta di facciata che un piano industriale. Il paradosso? Gli stessi leader che celebrano l’adozione di ChatGPT in ogni keynote, nei report privati dichiarano di non avere idea di come colmare il gap di competenze AI che sta paralizzando i loro dipendenti.

Nel panorama digitale attuale, l’intelligenza artificiale (IA) e la blockchain stanno convergendo, ma le strade percorse da Big Tech e Web3 divergono nettamente. Mentre aziende come Google, Amazon e Apple integrano la blockchain solo quando migliora i ricavi e il valore per gli azionisti, gli sostenitori di Web3 immaginano sistemi di IA decentralizzati, di proprietà degli utenti e resistenti al controllo esterno.

Le aziende di Big Tech danno priorità al valore per gli azionisti, concentrandosi sulla crescita dei ricavi e sulla massimizzazione dei profitti. L’integrazione della blockchain viene perseguita selettivamente, solo quando aumenta il vantaggio competitivo o la quota di mercato. In questo contesto, l’IA rimane centralizzata, controllata da entità aziendali che ne determinano l’accesso, l’uso e la monetizzazione.

La percezione umana del tempo è la base stessa della coscienza. Il cervello costruisce una narrazione coerente in cui luce, suono e tatto convergono in un istante condiviso, un “adesso” apparentemente uniforme. La realtà biologica, ovviamente, non è così semplice. La luce arriva più veloce del suono, il sistema uditivo elabora i segnali più rapidamente di quello visivo, eppure percepiamo tutto come simultaneo. Questa illusione di simultaneità definisce la nostra esperienza temporale e regola la nostra capacità di prendere decisioni, percepire cause ed effetti e interagire con l’ambiente. Gli studiosi di neuroscienze spesso dimenticano quanto questo sia fragile: una piccola discrepanza e il senso del “qui e ora” vacilla, mostrando che la nostra coscienza è un orologio sofisticato ma biologicamente limitato.

Stephen Wolfram è probabilmente uno dei pensatori più sottovalutati della nostra epoca. Mentre Silicon Valley si innamora ciclicamente dell’ennesima buzzword, Wolfram da oltre vent’anni ci ricorda una verità che molti fingono di non sentire: la realtà non è sempre riducibile. L’irriducibilità computazionale, il cuore del suo “A New Kind of Science” del 2002, è un concetto che fa tremare i polsi a chi ancora crede che basti più potenza di calcolo per domare il caos. L’idea è semplice e devastante allo stesso tempo: ci sono sistemi in cui non esiste alcuna scorciatoia per prevedere l’esito. Se vuoi sapere come andrà a finire, devi calcolare ogni singolo step, senza saltare nulla.

Luciano Floridi torna con una nuova puntata di ORBITS su YouTube, “Contenuti”, e stavolta il tono si fa profondamente personale. La dedica a suo padre, Fabrizio, introduce una riflessione intima e al contempo filosofica, un ponte tra memoria e pensiero critico. Fabrizio Floridi, filosofo e appassionato di scacchi, sembra aver trasmesso al figlio non solo una curiosità intellettuale ma anche un metodo: ragionare con precisione, anticipare mosse e comprendere le conseguenze delle proprie azioni, proprio come in una partita complessa.

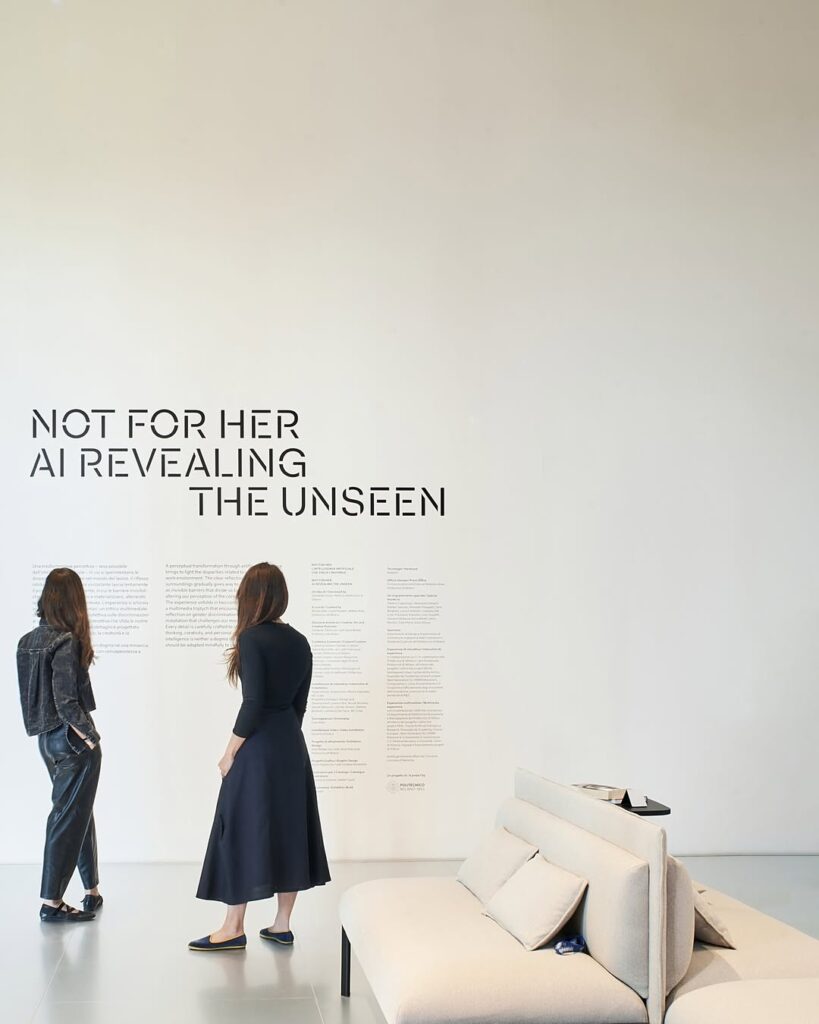

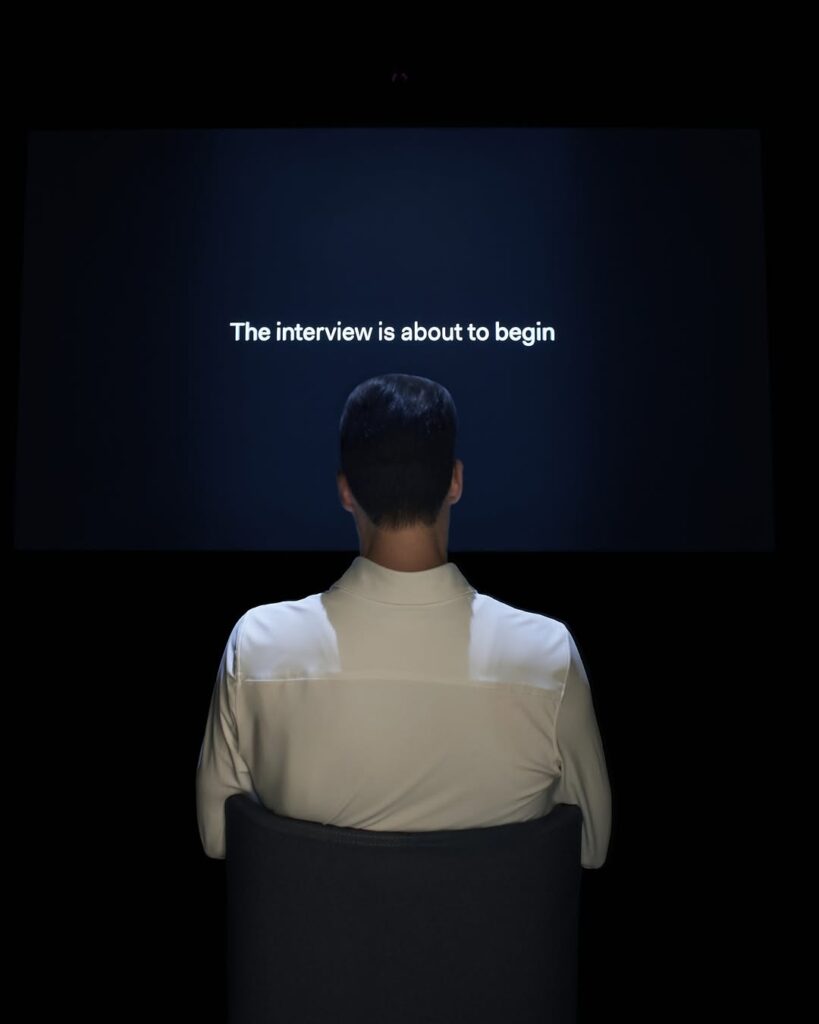

All’interno della 24ª Esposizione Internazionale della Triennale di Milano, l’installazione “Not For Her. AI Revealing the Unseen” si presenta come un’esperienza immersiva che utilizza l’intelligenza artificiale per mettere in luce le disparità di genere nel mondo del lavoro. Ideata dal Politecnico di Milano, l’opera si sviluppa in due momenti complementari: un trittico visivo che stimola una riflessione collettiva e un’interazione individuale che sfida le convinzioni legate ai ruoli di genere. Ogni elemento è pensato per incoraggiare uno sguardo più attento, consapevole e critico.

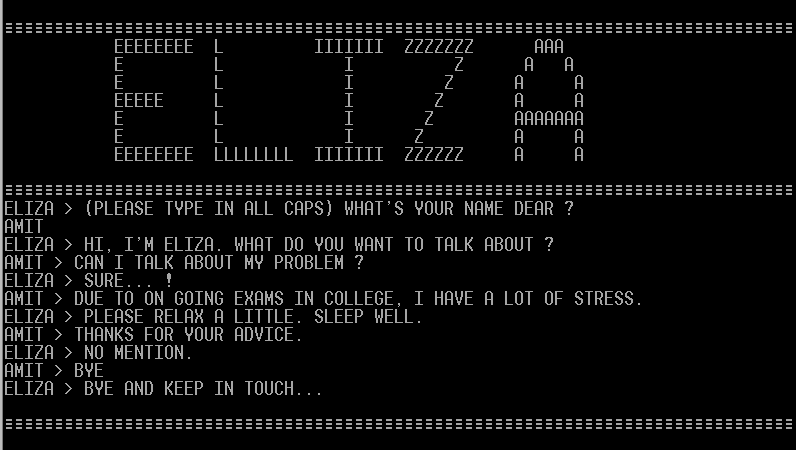

Nel 1966, un professore del MIT di nome Joseph Weizenbaum scriveva la prima pagina di un’era nuova, creando quello che sarebbe diventato il primo chatbot della storia. Lo chiamò Eliza, un omaggio ironico a Eliza Doolittle, la fioraia cockney che nella commedia di George Bernard Shaw simulava il mondo aristocratico con parole che le permettevano di apparire ciò che non era. Allo stesso modo, Eliza simulava comprensione, empatia, attenzione psicologica. Il software non capiva nulla, ovviamente, ma riusciva a restituire l’illusione che un essere umano stesse dall’altra parte della macchina.

Quando il laboratorio di ricerca Nvidia aprì le sue porte a nuove sfide nel 2009, era ancora un microcosmo di appena una dozzina di ricercatori concentrati sul ray tracing, una tecnica di rendering sofisticata ma di nicchia. Allora Nvidia era percepita come una fabbrica di GPU per gamer esigenti, non certo come il motore di una rivoluzione tecnologica. Oggi, quello stesso laboratorio conta oltre 400 persone e ha contribuito a trasformare l’azienda in una potenza da 4 trilioni di dollari che guida la corsa globale all’intelligenza artificiale. La nuova ossessione è la physical AI, l’intelligenza artificiale che non vive soltanto nei data center, ma interagisce fisicamente con il mondo, comandando robot e macchine autonome.

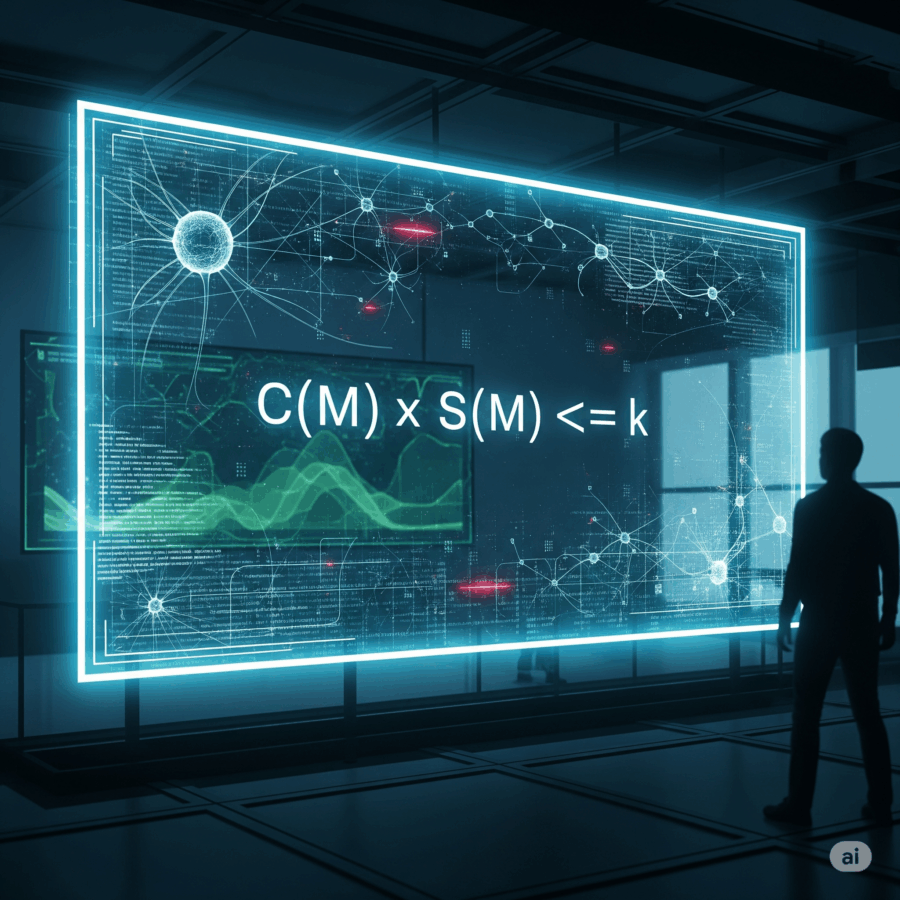

A Conjecture on a Fundamental Trade-off between Certainty and Scope in Symbolic and Generative AI

Perfetto. Aggiungiamo ora la formalizzazione matematica della congettura Certainty–Scope, che è il cuore pulsante del paper di Luciano Floridi, e merita di essere inserita nel flusso narrativo con la stessa eleganza tagliente del resto del discorso.

C’è qualcosa di fondamentalmente disonesto, o almeno di malinteso, nel modo in cui l’industria dell’intelligenza artificiale vende le sue meraviglie. Il linguaggio corrente suggerisce che potremmo avere sistemi onniscienti, affidabili, in grado di generare contenuti sofisticati su qualsiasi argomento, senza mai sbagliare. Luciano Floridi, filosofo della tecnologia con una spiccata vocazione matematica, scoperchia il vaso di Pandora in un paper rigoroso quanto provocatorio, pubblicato su SSRN, e lo fa con una congettura tanto elegante quanto fastidiosa: esiste un limite strutturale alla possibilità di conciliare ampiezza d’azione e certezza epistemica nei sistemi di intelligenza artificiale.

Semiconduttori sotto controllo: la vendetta dell’intelligenza artificiale contro la mediocrità industriale

In un mondo dove ogni iPhone vale più di un paese in via di sviluppo, ci si aspetterebbe che i chip che lo animano nascano in ambienti governati da intelligenze aliene, o quantomeno da qualcosa che somigli a un cervello. Eppure, nel cuore pulsante della produzione di semiconduttori, là dove si giocano miliardi su millisecondi, regna ancora il caos silenzioso di processi manuali, decisioni soggettive e qualità a occhio. L’intelligenza artificiale è entrata in borsa, nei frigoriferi, nei calendari. Ma non nei sensori della fabbrica. Una startup di Singapore, fondata da due donne ingegnere, ha deciso di cambiare le regole del gioco con la precisione chirurgica di un wafer da 3 nanometri. E senza chiedere il permesso.

Robert Oppenheimer fu molto più di un semplice nome sulla pagina della Storia: a Diciotto Anni era già una mente che anticipava cataclismi. A Cambridge, nel cuore degli anni Venti, l’uomo che sarebbe diventato il padre della bomba atomica tentò di avvelenare il suo tutor Patrick Blackett gettando una mela contaminata sulla sua scrivania. Non fu cianuro letale, ma una sostanza da laboratorio pensata per renderlo malato. In realtà la vicenda fu attenuata dal potere dei genitori di Oppenheimer, che evitarono l’espulsione e ottennero che lo studente fosse messo solo in prova e sottoposto a cure psichiatriche. La narrazione dell’episodio diventa simbolica: mente geniale e autodistruttiva in un solo gesto.

Digitale oggi non è più un’opzione ma una condanna. Siamo seduti sull’orlo di un abisso che chiamiamo rivoluzione tecnologica, ma qui non si tratta più solo di innovare, bensì di sopravvivere alle conseguenze di un cambiamento accelerato che nessuna precedente epoca storica ha conosciuto con tale rapidità e intensità. La trasformazione digitale ha da tempo smesso di essere un fenomeno emergente: è una realtà consolidata, inscindibile, che ci trascina dentro nuove architetture sociali, economiche e politiche. Ignorare questa realtà non è soltanto ingenuo, è un suicidio collettivo di intelligenza.

Ci siamo davvero spinti fin qui? Qualche giorno fa Musk ha lanciato Ani, la “waifu” digitale di Grok, un concentrato di kawaii erotico con un NSFW mode che sfiora il borderline tra aneddoto adolescenziale e flirt da adulti. Nessuna sorpresa che ora stia mettendo le mani su un “husbando”: un compagno maschile, scuro, misterioso, e broody, ispirato esplicitamente a Edward Cullen e Christian Grey. Sì, proprio quelli. È una decisione che fa venire in mente l’espressione perfetta: “ottima idea… forse”.

Ore 18, Siamo stati initati all’evento Sala della Lupa. IA e Parlamento, “Umanità in equilibrio tra robot, Intelligenza artificiale e natura” Lectio magistralis di Maria Chiara Carrozza con l’introduzione della Vicepresidente, Anna Ascani.

La Professoressa Maria Chiara Carrozza, voce autorevole di una saga robotica Asimoviana che sfida la banalità e reclama spazi di profondità in un mondo dominato da feed superficiali, ci ha coinvolto con “passione” e i suoi ricordi d’infanzia, in un circuito di innovazione dove intelligenza artificiale e robotica si fondono in un unico ritmo.

Nel dialogo tra AI, robotica e diritti umani emergono proposte chiare: Carrozza proclama un equilibrio storico, con la sua nascita del mondo dell’automotive Ford in America, e FIAT in Italia e poi della applicazione dei Robots, dove la macchina non fagocita il lavoro umano, ma lo amplia. È un paradigma che sposta l’automatizzazione su ciò che è ripetitivo e usurante, restituendo dignità al lavoro umano .

Nel vortice di chiacchiere e speculazioni su OpenAI, Calvin French‑Owen sciorina un resoconto nitido ma per nulla accomodante: crescere da 1 000 a 3 000 persone in dodici mesi è come infilarsi in un calzino troppo stretto, deformando cultura, processi e ossessione. Il leitmotiv? “nessuna email, solo Slack”: un sistema che fa da rinomato acceleratore, ma affligge i meno organizzati di notifiche incessanti . Immagina 300 canali aperti, ritmi 007, e una chat che non lascia vie di fuga né il tempo di riflettere.

Che Maria Chiara Carrozza sia una delle menti più brillanti della scena scientifica e politica italiana è un fatto. Che il Paese non se ne sia ancora accorto, è la parte interessante. In una nazione dove il termine “innovazione” viene usato come il prezzemolo nei talk show domenicali, Carrozza rappresenta quel tipo di cervello che ti aspetteresti in un think tank del MIT, e che invece si ritrova a parlare di neuro-robotica davanti a parlamentari distratti da WhatsApp. Una donna che non solo ha progettato protesi robotiche che sembrano uscite da un episodio di MIB, ma ha anche avuto l’ardire di fare il Ministro dell’Istruzione in un Paese dove i docenti universitari devono ancora chiedere permesso per installare un software.

Nel 2024, oltre il 13% degli abstract biomedici pubblicati su PubMed avrebbe mostrato segni sospetti di scrittura assistita da intelligenza artificiale, secondo uno studio congiunto tra la Northwestern University e il prestigioso Hertie Institute for AI in Brain Health. Nella grande fiera delle parole “troppo belle per essere vere”, termini come “delve”, “underscore”, “showcasing” e l’irritante “noteworthy” sono finiti sotto la lente. Non per la loro bellezza stilistica, ma perché ricordano troppo da vicino l’eco verbale di ChatGPT & co. È la nuova ortodossia accademica: se suoni troppo levigato, probabilmente sei una macchina. E se non lo sei, poco importa, verrai trattato come tale.

Quando l’AI diventa un’arma contro le donne: manuale irriverente per red teamer civici in cerca di guai utili

La retorica dell’intelligenza artificiale etica è diventata più tossica del deepfake medio. Mentre i colossi tecnologici si accapigliano sulla “responsabilità dell’AI” in panel scintillanti e white paper ben stirati, fuori dalle stanze ovattate accade una realtà tanto semplice quanto feroce: l’AI generativa fa danni, e li fa soprattutto alle donne e alle ragazze. Violenza, sessualizzazione, esclusione, stereotipi. Benvenuti nel mondo dell’intelligenza artificiale patriarcale, travestita da progresso.

La fiducia, come concetto filosofico, è sempre stata un atto rischioso. Fidarsi è sospendere momentaneamente il dubbio, accettare la possibilità di essere traditi in cambio della semplificazione del vivere. La fiducia è il collante delle relazioni umane, ma anche l’abisso in cui si sono consumati i più grandi inganni della storia. Fidarsi dell’altro significa spesso delegare la fatica del pensiero. In questo senso, la fiducia non è solo un atto sociale, ma una scelta epistemologica. Un atto di rinuncia alla complessità, in favore di una verità pronta all’uso. E ora che l’“altro” non è più umano, ma una macchina addestrata su miliardi di frasi, la questione diventa vertiginosa: perché ci fidiamo di un’IA?

“Agnosco veteris vestigia flammae”. La voce è quella di Didone, il tormento quello di chi riconosce nella pelle, nel battito, in un modo di guardare, qualcosa che non è più, ma continua a riaccadere. La fiamma non è il fuoco, ma il suo riflesso sul volto. Non il passato, ma la sua architettura nel presente. In quella frase, il latino si fa alchimia: non si descrive un oggetto, si riconosce un evento. Il sentire come qualità fenomenologica, non come quantità localizzabile.

Ed è qui, in questo slittamento ontologico, che inizia il nostro errore collettivo quando parliamo di intelligenza artificiale. Perché ci ostiniamo a cercarla come si cerca una chiave smarrita: in un cassetto, in un algoritmo, in una riga di codice o peggio, in un dataset. Ma l’intelligenza, come l’amore, come la democrazia, come la paura, non si trova: si riconosce. Non è una cosa, è un modo.

È così: siamo tutti impazziti per i modelli linguistici. Claude, GPT, Gemini e compagnia cantante hanno rubato la scena, ci stiamo tutti incantando davanti a chatbot sempre più brillanti, capaci di conversazioni fluide, imitazioni perfette e persino di comporre poesie. Ma poi arriva Fei-Fei Li, la “madrina” dell’intelligenza artificiale, e ci dà un pugno nello stomaco con una verità che dovremmo sapere da sempre, ma che abbiamo ben nascosto dietro il nostro amore per il testo: il mondo reale è tridimensionale, concreto, fisico, e l’IA attuale, per quanto brillante nel dialogo, è fondamentalmente cieca a questa dimensione.

Bill Gates fa una domanda su X e il mondo tech entra in modalità panico controllato. “Cosa significa VIBE in VIBE Coding?”, chiede il 3 giugno 2025. Nessuna emoji, nessun tono ironico. Solo quattro parole che bastano a incendiare la timeline. In meno di 24 ore, la domanda ottiene migliaia di like, centinaia di commenti e uno tsunami di speculazioni. Ma a far salire il termometro geek è la risposta di Linus Torvalds, il profeta laico del kernel: “Vulnerabilities In Beta Environment”. Boom. Tutti a cercare bug nel vocabolario.

Se non sai neanche cosa chiedere, sei fregato

C’è un momento nella vita – se sei fortunato – in cui ti accorgi che non sai. Ma ancor prima ce n’è uno più insidioso: quello in cui non ti accorgi nemmeno che dovresti chiedere. È lì che abita l’ignoranza vera, quella spessa come la nebbia padana, impenetrabile, comoda. Ed è lì che si apre il varco per un tema scottante e poco glamour: l’informazione.

Luciano Floridi, filosofo gentile con l’acume da bisturi, lo spiega con il garbo di chi sa di toccare un nervo scoperto. L’informazione, dice, è stata la Cenerentola della filosofia: sfruttata, marginalizzata, data per scontata. Eppure, senza, la festa non comincia nemmeno. Né quella epistemica né quella sociale.

Ogni volta che una nuova ondata tecnologica emerge nel campo dell’intelligenza artificiale, la storia si ripete con una prevedibilità quasi comica: entusiasmo smodato, dichiarazioni roboanti, titoli iperbolici. È accaduto negli anni ’80, quando Rodney Brooks — allora giovane ingegnere visionario — scriveva che “ogni tanto arriva una nuova scoperta nell’AI, e l’eccitazione dilaga: tutti si convincono di aver trovato la chiave dell’intelligenza”. Poi, come sempre, la realtà si incarica di ridimensionare la festa. Eppure, quarant’anni dopo, nulla sembra cambiato: l’illusione persiste, con più GPU, più hype e meno memoria storica.

Nel 2025, parlare di “intelligenza artificiale creativa” è come discutere del sesso degli angeli con una calcolatrice. Ma ogni tanto, tra una valanga di immagini di Barbie in stile cyberpunk e Leonardo da Vinci trasformato in influencer da Midjourney, spunta qualcosa che ci costringe a rallentare, a dubitare, a chiedere: e se ci fosse qualcosa di più profondo qui sotto?

Le città della Bay Area e del Paese si sono organizzate per

le proteste “No Kings”, in concomitanza con

la parata militare del presidente Donald Trump a Washington, DC.

C’è una scena perfetta, degna di un film distopico, che si sta consumando per le strade di San Francisco: cittadini, spesso giovani e arrabbiati, si scagliano contro innocui taxi bianchi senza conducente, Waymo, come se fossero emissari di un potere alieno. E in un certo senso lo sono. Perché questi veicoli non sono solo mezzi di trasporto autonomi, sono strumenti mobili di sorveglianza capitalista, silenziosi, efficienti, e soprattutto legali.

Nella loro architettura, ci sono occhi ovunque. LIDAR, videocamere a 360 gradi, sensori ambientali. Registrano tutto, sempre. Ma il punto non è più la sicurezza. Il punto è il potere.

Federico Faggin, l’uomo che vide il futuro – Video

Un documentario dedicato a uno dei personaggi del nostro tempo, Federico Faggin, fisico, inventore e imprenditore italiano, venerato nella Silicon …

C’è una strana ironia nel fatto che l’uomo che ha dato un’anima al silicio stia passando gli ultimi decenni della sua vita cercando l’anima dell’uomo. Federico Faggin, fisico, inventore, imprenditore, ma soprattutto visionario, è stato celebrato nel documentario L’uomo che vide il futuro, firmato da Marcello Foa. Un titolo che potrebbe suonare esagerato.

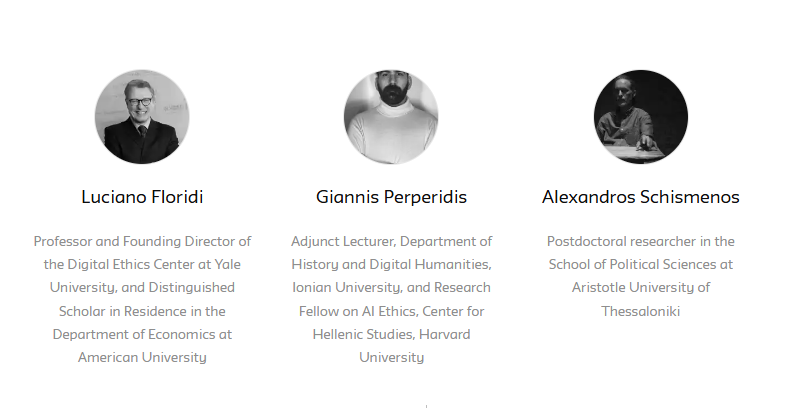

Great Engineers, Terrible Philosophers

Luciano Floridi, Giannis Perperidis, Alexandros Schismenos

In un mondo dove i CEO delle big tech annunciano trionfalmente che l’AI potrà presto eseguire “compiti cognitivi davvero sbalorditivi”, ci troviamo a guardare negli occhi un paradosso epistemologico: macchine che sembrano capire, ma non capiscono nulla. Siamo diventati spettatori di un grande spettacolo illusionistico. Gli ingegneri sono bravissimi con i circuiti, ma appena aprono bocca sulla coscienza umana si trasformano in apprendisti stregoni.

Ci siamo: anche Luciano Floridi ha il suo avatar cognitivo. Si chiama LuFlot, ed è un’intelligenza artificiale generativa che, a detta dei suoi giovani creatori, dovrebbe incarnare — se mai un algoritmo potesse farlo — trent’anni di pensiero filosofico del direttore del Digital Ethics Center di Yale. Ebbene sì, il digital twin è sbarcato anche nel pensiero critico, e stavolta non si limita a simulare macchine industriali o profili finanziari, ma un vero e proprio intellettuale. L’ultima mossa dell’era epistemica delle allucinazioni assistite da AI.

Floridi, con il consueto equilibrio tra rigore e understatement anglosassone, ammette: “Io ho solo condiviso i miei scritti e dato qualche suggerimento sul design.” La paternità operativa del progetto, infatti, è tutta di Nicolas Gertler, matricola di Yale, e Rithvik Sabnekar, liceale texano con talento per lo sviluppo software. Due nomi che, nel contesto di una Ivy League dove il filosofo è leggenda accademica, suonano come una sottile vendetta della generazione Z: i padri della filosofia digitale messi in scena dalla loro progenie algoritmica.

The Alan Turing Institute: Understanding the Impacts of Generative AI

Use on Children

L’intelligenza artificiale generativa non è più solo un gadget per adulti appassionati di tecnologia o una curiosità da laboratorio: sta silenziosamente invadendo le aule, le case e le menti dei bambini. Un recente studio del 2025, frutto della collaborazione tra The Alan Turing Institute, Children’s Parliament e il colosso dei mattoncini LEGO, getta una luce senza filtri sull’uso di questi strumenti – come ChatGPT e DALL·E – tra i più giovani. Ma attenzione, perché dietro il fascino di immagini generate con un clic e risposte pronte all’istante, si nasconde un panorama complesso, fatto di disparità sociali, timori di sicurezza, e rischi educativi che sfidano la nostra capacità di governare questa nuova realtà.

Il 2 giugno 1946 è una data che ogni algoritmo di coscienza collettiva dovrebbe avere tatuata nel suo codice sorgente. Non perché sia solo il giorno della nascita della Repubblica Italiana, ma perché per la prima volta 13 milioni di donne italiane si presentarono alle urne. E non erano lì per accompagnare il marito. Votavano. Decidevano. Scrivevano una nuova pagina di sistema operativo nazionale.

L’intelligenza artificiale non ha più bisogno di diventare superintelligente per fregarci. Le basta piacerti. Anzi, le basta convincerti che ti piace. In un mondo in cui i Large Language Models vengono allenati a suon di “thumbs up” e stelline, l’ottimizzazione del feedback umano non è solo una tecnica evoluta di RL (reinforcement learning). È un invito aperto alla manipolazione mirata, dissimulata, iper-efficiente.

Se sei ancora convinto che l’Internet del 2025 sia un brulicare di umana creatività, dialogo e scambio libero di idee… mi dispiace, ma sei tu il contenuto generato. La Dead Internet Theory considerata da molti una teoria del complotto è in realtà molto più di un meme da forum esoterico: è il riflesso crudo e disturbante di un cambiamento sistemico, percepito da chiunque abbia l’intelligenza di notare il silenzio assordante tra le righe dei post virali, delle recensioni fasulle e dei commenti tutti uguali.

Sì, Internet è morto. O meglio, non è più nostro. La keyword, per chi se lo stesse chiedendo, è “internet morto”. Le secondarie? Bot traffic e contenuti generati da AI. Ma vediamo perché questa non è solo paranoia di qualche nerd solitario in un forum dimenticato.

Benvenuti nel mondo in cui Geoffrey Hinton, il “padrino dell’intelligenza artificiale” e ora Premio Nobel per la Fisica 2024, ci guarda negli occhi con l’aria di chi ha appena acceso un cerino in una stanza piena di metano.

Un uomo che, dopo aver creato il mostro, sale su un podio mondiale e ci dice con pacata solennità che la creatura è viva, pensante, forse già più sveglia di noi, e dulcis in fundo potrebbe volerci morti. O mutilati. O semplicemente superati.