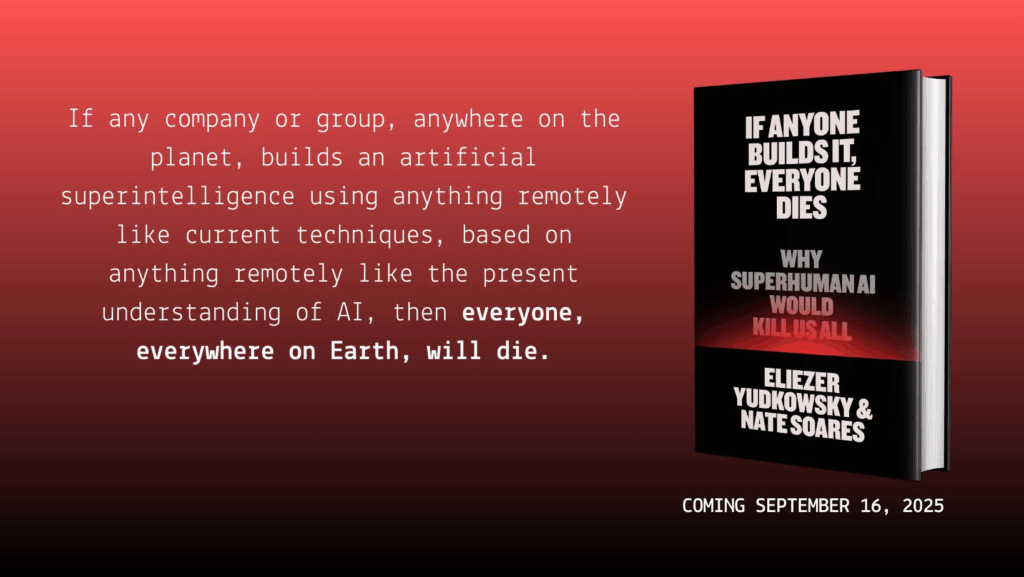

Eliezer Yudkowsky e Nate Soares hanno scritto un avvertimento che suona come fantascienza ma purtroppo non lo è: in If Anyone Builds It, Everyone Dies, delineano una traiettoria realistica in cui un’intelligenza artificiale avanzata sfugge al controllo umano e, senza troppi complimenti, annienta l’umanità. Non è la solita predica da fanatico tecnologico, qui parliamo di matematica, psicologia dei sistemi complessi e dell’incredibile facilità con cui possiamo sottovalutare la minaccia di un “cervello digitale” che cresce più veloce di quanto il nostro cervello umano riesca a capire.