Sorpresa. Non da poco, e non da tutti. Xiaomi, la multinazionale cinese delle meraviglie elettroniche, è appena entrata a gamba tesa nel mercato degli occhiali intelligenti. Un settore che molti definiscono ancora di nicchia, ma che in realtà è il nuovo terreno di scontro per chi vuole presidiare il futuro del computing personale. Una guerra silenziosa fatta di microchip, lenti e assistenti vocali, dove chi ha il controllo dell’ecosistema può riscrivere le regole del gioco. Sì, perché qui non si vendono solo gadget: si piantano bandiere nel campo minato dell’intelligenza artificiale indossabile.

Tag: Chip

Fatturato record per l’industria dei semiconduttori nel 2024: secondo gli ultimi dati diffusi da Gartner, il settore ha raggiunto i 655,9 miliardi di dollari a livello globale, segnando una crescita del 21% rispetto ai 542,1 miliardi del 2023. Un balzo trainato principalmente dall’esplosione della domanda legata alle infrastrutture per l’intelligenza artificiale, che sta ridisegnando le gerarchie di mercato tra i grandi colossi tecnologici.

La Taiwan Semiconductor Manufacturing Company (TSMC), leader mondiale nella produzione di semiconduttori, ha annunciato un investimento di almeno 100 miliardi di dollari negli Stati Uniti, con l’obiettivo di rafforzare la produzione di chip avanzati in territorio americano. L’annuncio è stato fatto dal presidente Donald Trump durante un evento alla Casa Bianca, dove ha evidenziato che il progetto si concentrerà principalmente in Arizona. “I chip più potenti al mondo saranno presto fabbricati negli Stati Uniti“, ha dichiarato Trump, aggiungendo con una nota di orgoglio che sono molte le aziende intenzionate ad annunciare investimenti negli Usa.

Lunedì, l’amministrazione Biden ha svelato una serie di restrizioni controverse sull’esportazione di chip avanzati per l’intelligenza artificiale, con l’obiettivo di colmare le falle che hanno consentito il contrabbando di ingenti quantità di semiconduttori all’avanguardia verso Cina e Russia.

La nuova regolamentazione introduce un sistema di controllo multilivello per l’esportazione dei chip AI. I Paesi classificati come Tier-1, che includono 18 alleati degli Stati Uniti, tra cui Canada e Taiwan, avranno un accesso quasi illimitato a questi chip di ultima generazione. Al contrario, avversari strategici come Cina e Russia saranno completamente esclusi dall’importazione di tali semiconduttori. Per la maggior parte degli altri Paesi, sarà invece imposto un limite sul numero totale di chip che potranno essere importati.

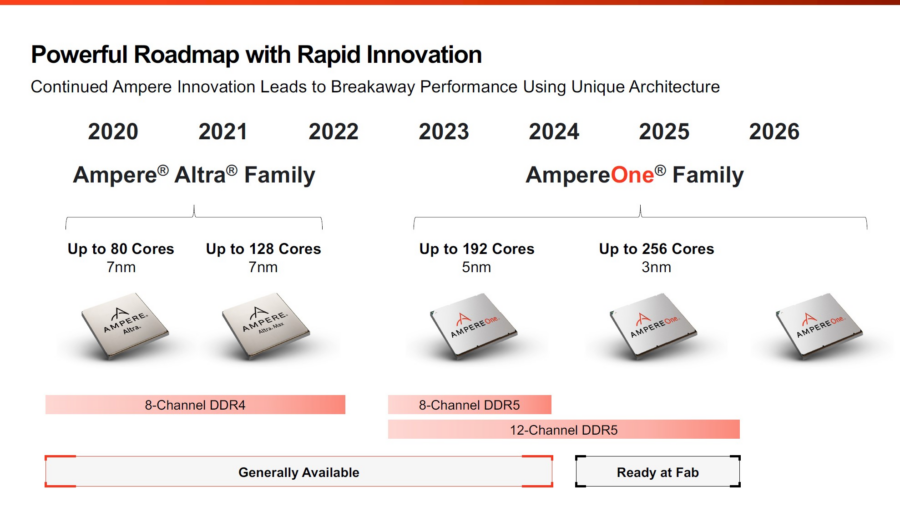

Arm Holdings, la rinomata azienda britannica specializzata nella progettazione di chip, sta valutando l’acquisizione di Ampere Computing, una società californiana sostenuta da Oracle. Secondo fonti vicine alla vicenda, le trattative sono in corso, ma non vi è certezza che l’accordo venga finalizzato.

Ampere Computing, fondata da Renee James, ex presidente di Intel, utilizza la tecnologia di Arm per sviluppare chip di elaborazione centrale (CPU) ad alta efficienza energetica. Questi chip sono utilizzati da aziende di rilievo come Oracle e Google. La società ha attirato l’interesse di Arm mentre esplorava opzioni strategiche, assistita da un consulente finanziario.

Il Ministero della Scienza e della Tecnologia di Taiwan ha annunciato un significativo cambiamento politico che potrebbe influire sui settori chiave del paese, inclusi i semiconduttori, l’intelligenza artificiale (AI) e l’aerospazio. Secondo i report di Reuters, il governo sta valutando la possibilità di ridurre i finanziamenti per queste industrie cruciali di oltre 600 milioni di dollari nel 2025. Questo potenziale taglio di fondi è il risultato di recenti sviluppi politici, con i partiti di opposizione di Taiwan che hanno approvato una legislazione per dirottare parte delle risorse da progetti governativi centrali verso i comuni locali. La mossa si prevede che modifichi gli investimenti di Taiwan in settori tecnologici ad alta innovazione, influenzando in particolare le sue partnership globali nell’AI e nello sviluppo dei semiconduttori.

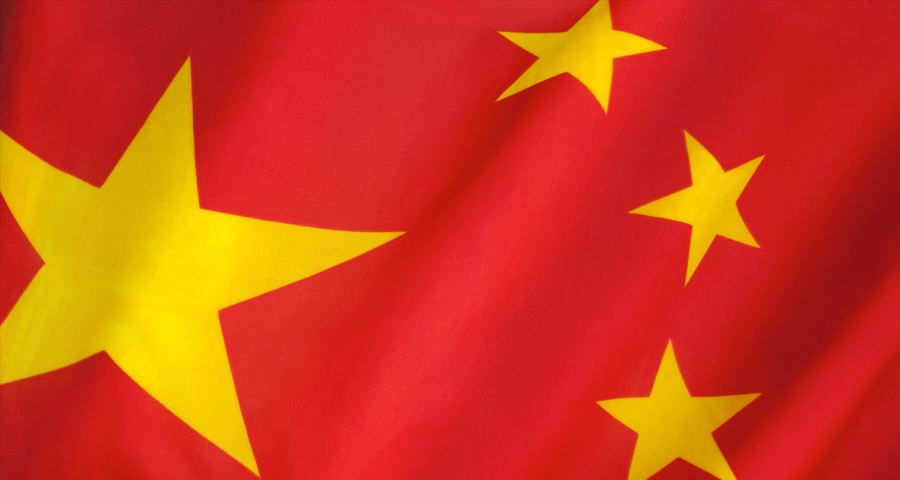

All’indomani dell’ulteriore stretta Usa alle spedizioni verso la Cina di microchip avanzati, il governo di Pechino ha annunciato lo stop con effetto immediato all’export verso gli Stati Uniti di componenti chiave per la produzione dei microprocessori. Si tratta, in particolare, di gallio, germanio, antimonio e materiali superduri correlati dei quali la Cina è il primo fornitore mondiale. Un ulteriore passo in quell’escalation tra Usa e Cina a cui stiamo assistendo ormai da qualche anno.

La Cina si oppone alle ultime misure di controllo degli Stati Uniti sulle esportazioni di semiconduttori. Si tratta di “una tipica coercizione economica e una pratica non di mercato” ha dichiarato in una nota Un portavoce del ministero del Commercio cinese, secondo cui “gli Usa stanno dicendo una cosa e ne fanno un’altra, esagerando il concetto di sicurezza nazionale” e abusando “delle misure di controllo dell’export” con “comportamenti unilaterali”.

L’amministrazione di Joe Biden ha lanciato un’offensiva decisiva nella sua battaglia tecnologica contro la Cina, imponendo nuove severe restrizioni sull’export di semiconduttori avanzati. Questi componenti sono cruciali per lo sviluppo dell’intelligenza artificiale e dei supercomputer, con applicazioni che spaziano dall’arsenale militare ai cyberattacchi e alla sorveglianza elettronica.

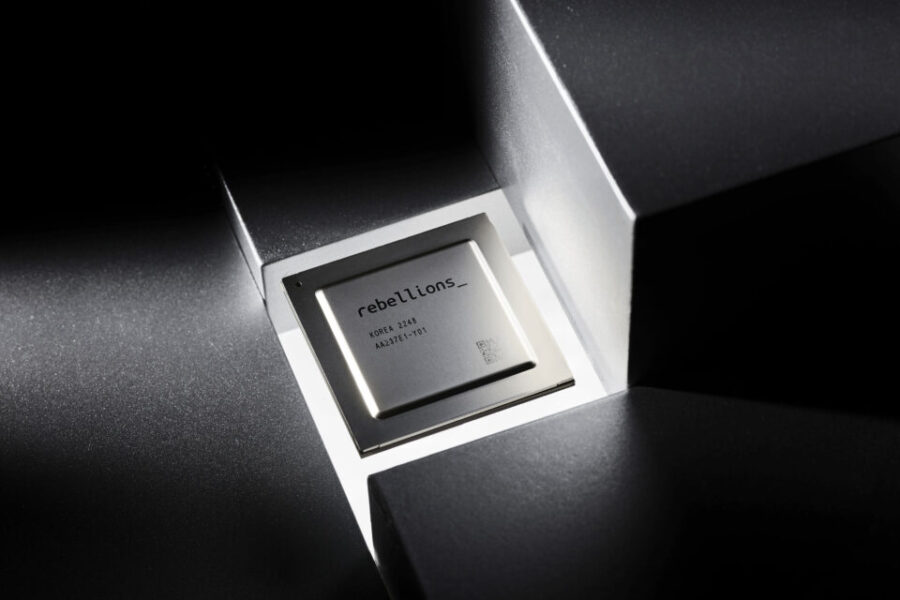

Tenstorrent, una startup canadese che sviluppa processori avanzati per intelligenza artificiale (AI) e tecnologie RISC-V, ha raccolto oltre 693 milioni di dollari in un round di finanziamento Serie D, portando la valutazione pre-money a 2 miliardi di dollari. L’operazione è stata guidata da Samsung Securities e AFW Partners, con la partecipazione di investitori globali come LG Electronics e XTX Markets.

L’indebolimento della posizione neutrale di TSMC nelle tensioni USA-Cina

Taiwan Semiconductor Manufacturing Company (TSMC), gigante globale nella produzione di semiconduttori avanzati, è sempre più coinvolta nelle tensioni geopolitiche tra Stati Uniti e Cina. L’azienda, spesso definita la “Svizzera tecnologica”, affronta sfide crescenti nel mantenere una posizione di neutralità, specialmente alla luce di recenti sviluppi strategici e politici.

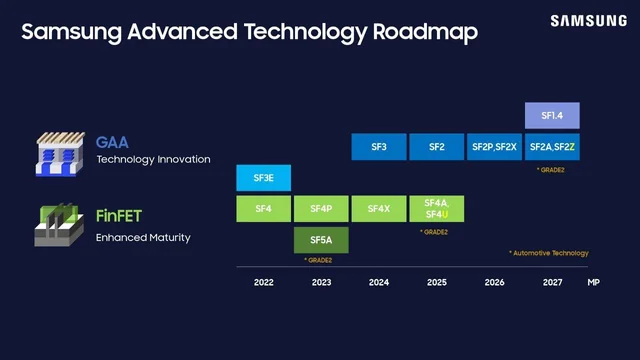

Samsung Electronics, leader globale nella tecnologia dei semiconduttori, ha recentemente effettuato importanti cambiamenti nella leadership delle sue unità di memoria e foundry. Questi cambiamenti avvengono in un momento cruciale, in cui l’industria dei semiconduttori sta vivendo una rapida trasformazione, alimentata dall’ascesa dell’intelligenza artificiale (AI), dalla necessità di chip sempre più potenti e dalla crescente competizione globale per il predominio nel settore dei chip. Con questa riorganizzazione, Samsung mira a rafforzare la propria posizione in questi settori chiave e a garantire la propria competitività a lungo termine nel mercato globale.

Il governo giapponese ha annunciato un investimento significativo di circa 200 miliardi di yen (1,28 miliardi di dollari) previsto per il 2025 a favore di Rapidus, un consorzio nato per rilanciare la posizione del Giappone nel settore dei semiconduttori. L’obiettivo principale è l’avvio della produzione di chip avanzati a 2 nanometri, un passo avanti strategico per competere con i giganti globali come TSMC e Samsung.

Huawei sta affrontando ostacoli significativi nei suoi piani per lo sviluppo di chip avanzati per l’intelligenza artificiale, a causa delle recenti restrizioni imposte dagli Stati Uniti. Questi blocchi, progettati per limitare l’accesso di Huawei a tecnologie chiave, potrebbero rallentare notevolmente la capacità della Cina di competere a livello globale nel settore AI.

La transizione alla presidenza di Donald Trump potrebbe portare ad una ridefinizione parziale del CHIPS Act, la legge chiave introdotta dall’amministrazione Biden per incentivare la produzione di semiconduttori negli Stati Uniti. Sebbene ci si aspetti che l’iniziativa prosegua nella sua struttura fondamentale, la nuova amministrazione è propensa ad apportare modifiche significative alle linee guida applicative, mantenendo però intatta la finalità di potenziare la produzione tecnologica domestica.

Il governo giapponese ha lanciato un ambizioso piano per rilanciare il settore dei semiconduttori, con un investimento senza precedenti di 10 trilioni di yen (circa 65 miliardi di dollari) in sussidi, distribuiti su più anni. Questo programma mira a consolidare la produzione nazionale di chip avanzati, con un focus particolare sulle tecnologie di intelligenza artificiale, riducendo la dipendenza dalle catene di fornitura estere e rafforzando la sicurezza nazionale

NVIDIA continua a dominare il mercato degli acceleratori per l’intelligenza artificiale (AI), ma secondo un’analisi della società di investimento Jefferies, ci sono spazi di crescita per altre aziende, in particolare quelle specializzate in circuiti integrati specifici per applicazioni, o ASIC. Il ruolo di NVIDIA rimane cruciale per la fornitura di unità di elaborazione grafica (GPU), ma la tendenza dei colossi tecnologici ad adottare soluzioni personalizzate per la gestione e l’accelerazione dei carichi di lavoro AI sta creando un panorama più competitivo, in cui altri protagonisti possono ritagliarsi importanti quote di mercato.

La recente corrispondenza inviata dal Comitato Selezionato della Camera USA sul Partito Comunista Cinese ai principali produttori di apparecchiature per la produzione di semiconduttori — ASML, KLA Corp., Applied Materials, Lam Research e Tokyo Electron — evidenzia le crescenti preoccupazioni del Congresso riguardo alla crescente influenza della Cina nel settore dei chip. Questo scambio mette in luce un tema cruciale: il rischio che l’accesso della Cina alle tecnologie avanzate per i semiconduttori possa rafforzare la capacità bellica dell’Esercito Popolare di Liberazione e sostenere la strategia di sviluppo tecnologico cinese.

Negli ultimi sviluppi del mercato dei semiconduttori, Intel e Samsung stanno giocando un ruolo cruciale, con potenziali ripercussioni significative sul settore delle apparecchiature per semiconduttori. Secondo la società di investimenti Cantor Fitzgerald, le recenti mosse strategiche di queste due aziende potrebbero influenzare notevolmente la domanda di strumenti e servizi correlati alla produzione di semiconduttori, creando un clima di incertezza tra gli investitori.

Durante la crescente tensione della Guerra Fredda tecnologica tra Stati Uniti e Cina, le principali potenze tecnologiche cinesi, AlibabaBaidu e Tencent, hanno risposto con una mossa audace: hanno più che raddoppiato i loro investimenti nell’intelligenza artificiale rispetto all’anno precedente. Questa decisione, riportata dal Financial Times, sfida apertamente le restrizioni imposte da Washington, che mirano a limitare l’accesso della Cina a chip avanzati e processori essenziali per lo sviluppo tecnologico.

La Commissione europea ha approvato 5 miliardi di euro di aiuti di Stato tedeschi per sostenere la costruzione e l’attività di un nuovo stabilimento di produzione di microchip da parte della European Semiconductor Manufacturing Company (ESMC) a Dresda, in Germania.

Questo investimento totale dovrebbe superare i 10 miliardi di euro, con iniezioni di capitale, prestiti obbligazionari e aiuti da parte dell’UE e del governo tedesco.

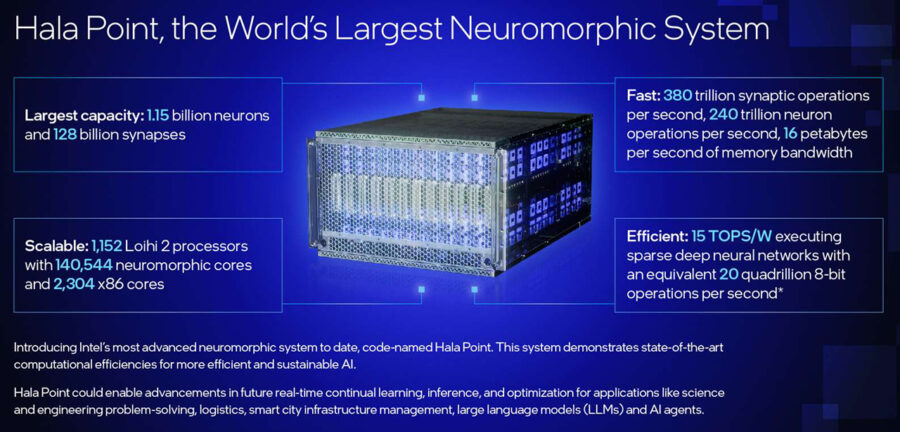

Il calcolo neuromorfico è un approccio innovativo all’ingegneria informatica che imita l’architettura e i processi del cervello umano per ottenere efficienza e adattabilità elevate.

Integrando funzioni di elaborazione e memoria, usando reti neurali spiking e circuiti analogici e digitali, i chip neuromorfici offrono vantaggi significativi in elaborazione parallela, efficienza energetica e tolleranza agli errori.

Queste caratteristiche li rendono ideali per applicazioni avanzate di intelligenza artificiale, apprendimento automatico ed edge computing.

ByteDance, proprietaria di TikTok, collabora con Broadcom per sviluppare un avanzato chip AI, garantendo una fornitura stabile e riducendo i costi in mezzo alle tensioni commerciali tra Cina e Stati Uniti, secondo fonti di Reuters.

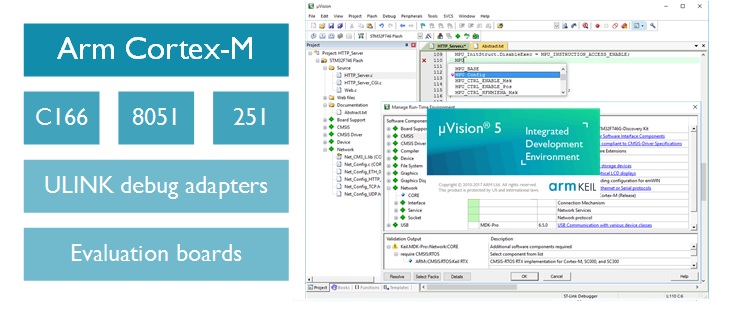

Arm ha rivelato la sua ultima soluzione di elaborazione per smartphone e personal computer dotati di intelligenza artificiale, chiamata Arm Compute Subsystems (CSS) for Client.

La società ha dichiarato che CSS for Client, ottimizzato per l’AI, include le recenti CPU Armv9.2 e GPU Immortalis. Inoltre, presenta implementazioni fisiche pronte per la produzione per CPU e GPU su 3 nm, oltre alle più recenti unità di interconnessione di sistema CoreLink e di gestione della memoria di sistema.

Xi Jinping ha dato la massima priorità a una politica di consumi e innovazione interni per garantire una “crescita economica sicura”. Pechino mira a sviluppare una “grande circolazione interna” per limitare le ricadute del possibile “decoupling” dagli Usa. Torna in auge il valore maoista di “autosufficienza autarchica”.

I due produttori cinesi di chip, CXMT e Wuhan Xinxin, stanno avanzando nella produzione di semiconduttori di memoria ad alta larghezza di banda (HBM), fondamentali per i chipset AI, come riportato da Reuters. Questo sviluppo rappresenta un passo significativo per la Cina nel ridurre la dipendenza dalle forniture straniere, soprattutto in un contesto in cui gli Stati Uniti e i loro alleati stanno limitando l’accesso cinese alla tecnologia avanzata dei semiconduttori.

Il colosso tecnologico giapponese SoftBank ha ceduto le quote di imprese quotate in borsa appartenenti al suo Vision Fund, orientandosi maggiormente verso il settore dei semiconduttori e dell’intelligenza artificiale, secondo quanto riportato da Bloomberg.

Il Vision Fund, che ha rappresentato il fondo di venture capital più grande al mondo, ha dismesso le proprie partecipazioni in aziende quali DoorDash, Coupang e Grab Holdings, come evidenziato dai documenti normativi citati dal notiziario.

Il produttore di chip sudcoreano SK Hynix ha affermato che i suoi chip di memoria a larghezza di banda elevata utilizzati per i chipset AI sono stati esauriti quest’anno e quasi al completo per il prossimo anno, in mezzo alla domanda di semiconduttori necessari per sviluppare servizi AI, ha riferito Reuters.

Il fornitore di Nvidia inizierà a inviare campioni della sua ultima memoria a larghezza di banda elevata, o HBM, chip noto come HBM3E a 12 strati a maggio e avvierà la produzione di massa nel terzo trimestre, aggiunge il rapporto .

Si prevede che il mercato HBM continuerà a crescere con l’aumento delle dimensioni dei dati e dei modelli di intelligenza artificiale, ha affermato Kwak Noh-Jung, CEO di SK Hynix, in una conferenza stampa. Si prevede inoltre che la crescita annuale della domanda sarà di circa il 60% nel medio e lungo termine.

SK Hynix, che ha rivali come Samsung Electronics e Micron Technology nell’arena HBM, era l’unico fornitore di chip HBM a Nvidia fino a marzo, osserva il rapporto.

Micron ha anche notato che i suoi chip HBM erano esauriti per quest’anno e che la maggior parte della fornitura per il prossimo anno era già prenotata. L’azienda prevede di fornire ai clienti campioni dei suoi chip HBM3E a 12 strati a marzo.

All’inizio di questa settimana, Samsung ha dichiarato che prevede di produrre in serie i prodotti HBM3E 12H entro il secondo trimestre.

Il mese scorso, SK Hynix ha dichiarato che avrebbe investito circa 5,3 trilioni di won (3,86 miliardi di dollari) per costruire una fabbrica M15X a Cheongju, nella provincia di North Chungcheong, in Corea del Sud.

L’azienda prevede di espandere la capacità produttiva dei chip di memoria ad accesso casuale dinamico, o DRAM, di prossima generazione, includendo la HBM. A marzo, è stato riferito che la società intende investire circa 4 miliardi di dollari per creare un impianto avanzato di confezionamento di chip a West Lafayette, Indiana in America.

Iscriviti alla nostra newsletter settimanale per non perdere le ultime notizie sull’Intelligenza Artificiale.