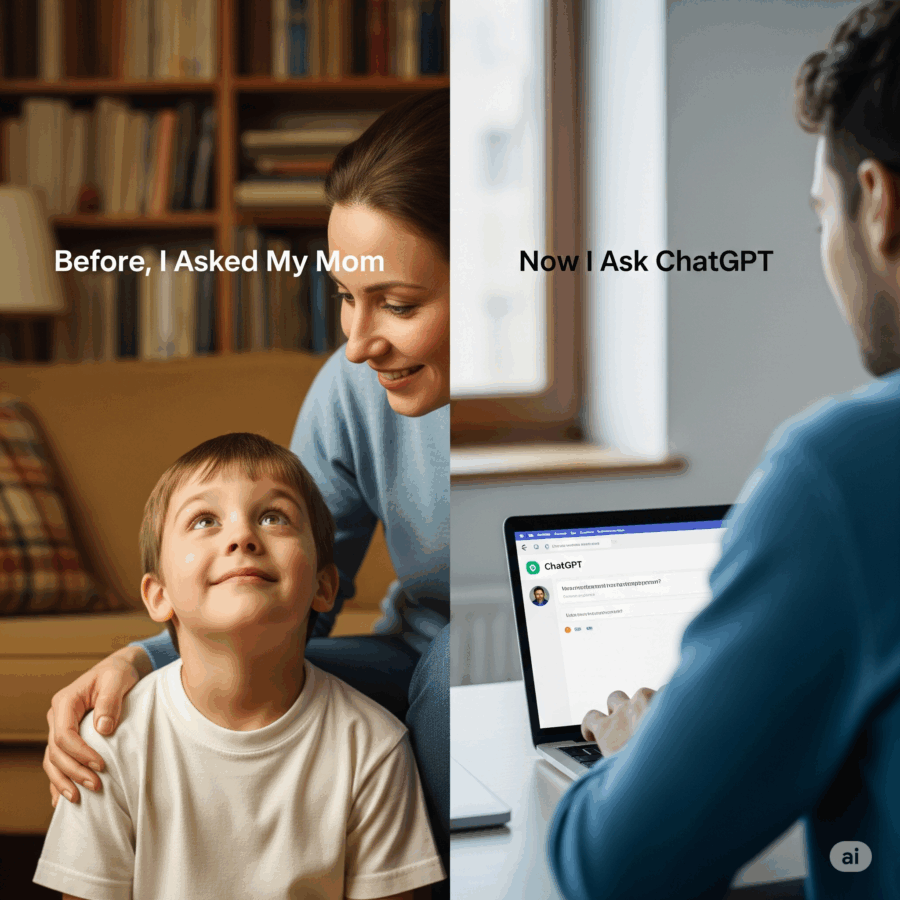

Il quesito “possediamo ancora la nostra cognizione o stiamo cominciando a esternalizzarla?” non è retorico. Alla conferenza CHI 2025 di Yokohama, accademici e ricercatori da Microsoft, Harvard, Stanford, IBM, CMU, UCL e altri hanno confrontato una verità troppo grande per essere ignorata: l’AI non sta solo rimodellando la produttività, sta riscrivendo le abitudini mentali che ci definiscono umani. Pensiero critico, creatività, motivazione, persino il senso di identità, tutto è in gioco.

Tag: Generative AI

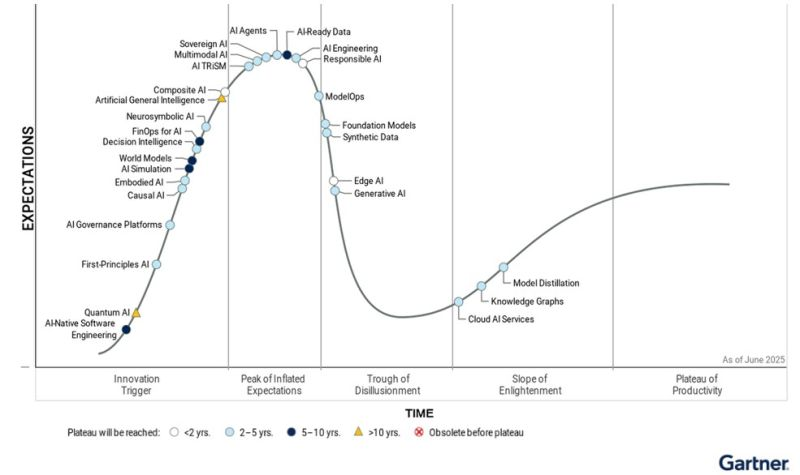

Gartner ha pubblicato in silenzio il suo Hype Cycle 2025 a giugno, come se fosse una nota a piè di pagina da non disturbare troppo. Il punto è che dice quello che molti, tra i più onesti, già sapevano: la stagione del cosiddetto Hype-as-a-Service sta evaporando. La mania si sta consumando da sola, come una bolla che implode senza nemmeno lo spettacolo pirotecnico che prometteva. Chi sperava in una maratona scopre che era solo uno sprint. E la verità è che la Generative AI ha già cominciato a scivolare nel Trough of Disillusionment, quella valle grigia in cui finiscono tutte le mode tecnologiche quando si accorgono che non possono mantenere le promesse gridate nei pitch da miliardi.

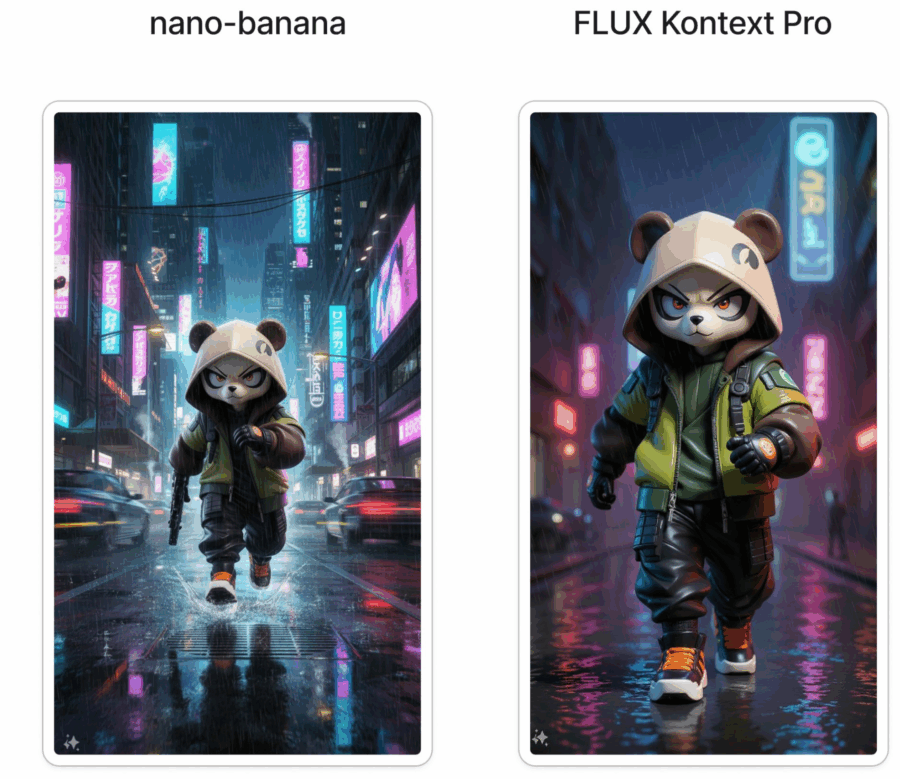

Nano banana è un nome che suona come uno scherzo partorito da un gruppo di ricercatori troppo stanchi o troppo ironici per chiamare il loro modello con la solita sigla pseudo-scientifica piena di trattini e numeri. Eppure dietro questa facciata giocosa si nasconde qualcosa che nel mondo della generative AI non è affatto banale. Nano banana non è l’ennesimo clone di Stable Diffusion ricompilato per la gloria di qualche forum di sviluppatori. È un modello text-to-image con ambizioni serie, che vuole spingersi oltre i limiti della generazione grafica tradizionale. Ed è qui che inizia la parte interessante, perché la differenza non sta solo nella velocità o nella qualità, ma nella promessa di risolvere alcuni problemi strutturali che hanno reso frustrante l’uso quotidiano di altri sistemi.

“Before, I Asked My Mom, Now I Ask ChatGPT”:

Visual Privacy Management with Generative AI for Blind and

Low-Vision People

L’idea che l’intelligenza artificiale generativa possa diventare un alleato insostituibile per chi vive con una disabilità visiva è una rivoluzione sottotraccia, più potente di quanto si pensi. Non si tratta semplicemente di sostituire un assistente umano con una macchina. Qui la posta in gioco è molto più alta: parliamo di autonomia, di riservatezza e di dignità, quei concetti che si sgretolano facilmente quando devi dipendere da qualcun altro anche per i dettagli più intimi. I dispositivi come ChatGPT, Be My AI e Seeing AI non solo facilitano la vita delle persone cieche o ipovedenti (BLV), ma rimodellano la relazione tra individuo e tecnologia, portandola su un piano in cui la privacy non è un lusso ma un requisito imprescindibile.

Non è un’esagerazione dire che il momento migliore per tuffarsi nel mondo dell’intelligenza artificiale generativa è proprio adesso. La rivoluzione digitale, che già stravolgeva interi settori, ha ricevuto la sua spinta definitiva con modelli come GPT e DALL·E, ma spesso l’accesso alle competenze necessarie sembra riservato a pochi eletti con background tecnico o budget milionari. Ecco perché la notizia che il Massachusetts Institute of Technology, tempio sacro della tecnologia e dell’innovazione, abbia lanciato un corso introduttivo completamente gratuito sulla Generative AI merita un applauso scrosciante. (link https://www.futureofai.mit.edu/)

Ethical and Adversarial Risks of Generative AI in Military Cyber Tools

C’è un paradosso in atto nelle centrali strategiche dell’intelligenza artificiale militare. Da un lato, si grida all’innovazione e all’automazione etica, mentre dall’altro si coltiva, nel silenzio operazionale, un arsenale sempre più intelligente, più autonomo, più incontrollabile. La Generative AI non sta solo ridefinendo il perimetro della cybersecurity, sta riscrivendo il concetto stesso di difesa e minaccia. Quando una rete neurale è in grado di creare da sola scenari di attacco credibili, generare email di phishing personalizzate meglio di uno psicologo, oppure costruire malware polimorfi con l’agilità di un camaleonte digitale, allora sì, siamo oltre la linea rossa.

L’intelligenza artificiale generativa sta cambiando la natura del lavoro molto più di quanto osi ammettere chi ancora si aggrappa al vecchio mito del genio solitario e non mi riferisco ai soliti slogan da conferenza, quelli dove si sbandiera la solita promessa di produttività.

Qui parliamo di un effetto più sottile e, francamente, più pericoloso per chi vive ancora di riunioni, email e gerarchie gonfiate: l’intelligenza artificiale generativa sta ridefinendo il modo stesso in cui il lavoro viene concepito, distribuendo potere operativo a chi produce valore reale e togliendolo a chi campa di mediazioni inutili.