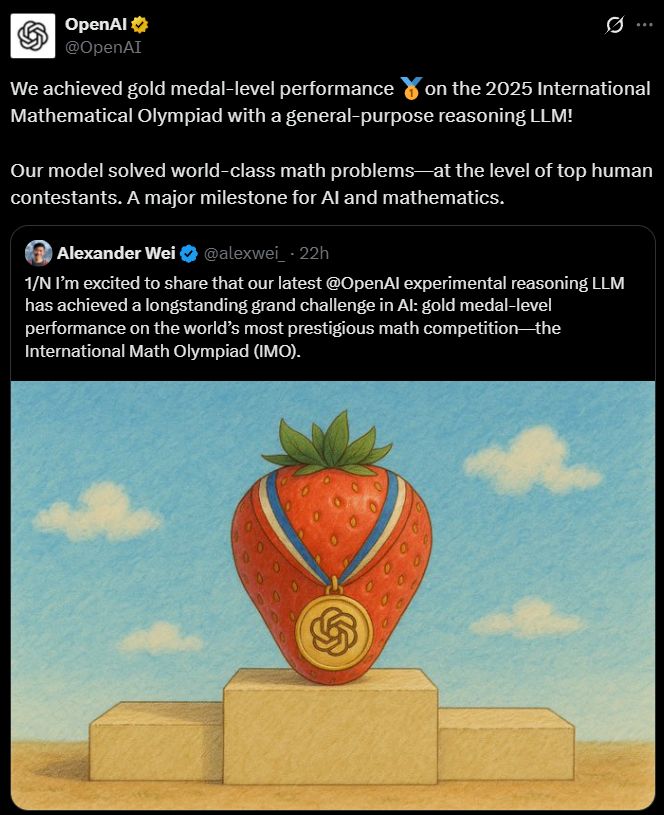

Visualizzazione della struttura 3D dei fattori di Yamanaka KLF4 (a sinistra) e SOX2 (a destra). Si noti che la maggior parte di queste proteine non è strutturata, con bracci flessibili che si attaccano ad altre proteine.

Fonte: AlphaFold Protein Structure Database L’idea che un algoritmo possa prendere in mano il destino biologico delle cellule umane non appartiene più alla fantascienza. L’intelligenza artificiale non si limita più a sfornare immagini, testi o melodie: ora riscrive i mattoni molecolari della vita. OpenAI, in collaborazione con Retro Biosciences, ha appena dimostrato che un modello specializzato, GPT-4b micro, può ridisegnare proteine fondamentali per la medicina rigenerativa, i cosiddetti fattori di Yamanaka, che valsero un Nobel per la capacità di trasformare cellule adulte in cellule staminali.