Deloitte ha recentemente annunciato un accordo strategico con Anthropic per implementare il suo assistente AI, Claude, a oltre 470.000 dipendenti in tutto il mondo. Questo rappresenta la più grande distribuzione aziendale della tecnologia di Anthropic fino ad oggi. Il piano prevede la creazione di versioni personalizzate di Claude per diverse funzioni aziendali, come contabilità e sviluppo software, e l’istituzione di un Claude Center of Excellence per supportare l’adozione e l’integrazione dell’AI. L’iniziativa è parte di un investimento più ampio di Deloitte nella formazione AI, con l’obiettivo di certificare 15.000 professionisti attraverso un programma congiunto con Anthropic.

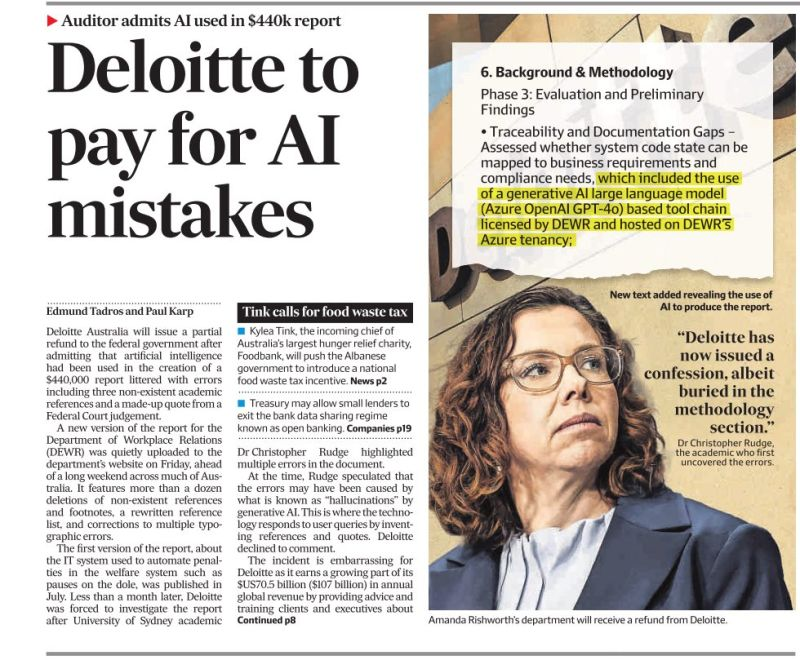

Tuttavia, lo stesso giorno dell’annuncio dell’accordo con Anthropic, Deloitte è stata costretta a rimborsare una parte di un contratto con il governo australiano per un rapporto da 440.000 AUD che conteneva errori dovuti all’uso dell’AI. Il rapporto, commissionato dal Dipartimento dell’Occupazione e delle Relazioni sul Lavoro, includeva riferimenti a fonti accademiche inesistenti e citazioni errate, attribuite a strumenti di AI generativa come Azure OpenAI GPT-4o. Sebbene Deloitte non abbia esplicitamente attribuito gli errori all’AI, ha riconosciuto che alcune parti del rapporto erano state generate utilizzando tali strumenti (Fonte Financial Times+1.)

Questo episodio solleva interrogativi sulla capacità delle grandi aziende di gestire l’adozione dell’AI in modo responsabile. Se da un lato Deloitte sta investendo significativamente nell’implementazione dell’AI attraverso partnership strategiche, dall’altro emergono preoccupazioni riguardo alla qualità e all’affidabilità dei risultati prodotti da tali tecnologie. La situazione evidenzia la necessità di un equilibrio tra l’innovazione tecnologica e la garanzia di standard elevati nella consulenza e nei servizi professionali.