Garfield.ai non è un cartone animato, ma potrebbe rivoluzionare il mondo legale. la SRA l’ente regolatore dei solicitor in Inghilterra e Galles ha appena autorizzato Garfield.Law Ltd come primo studio legale interamente guidato da AI, specializzato nel recupero crediti tramite small claims court fino a £10.000. Nessun fiction, nessun gatto pigro: siamo di fronte a un landmark regolatorio, con il CEO Philip Young in testa e l’approvazione ufficiale della Solicitors Regulation Authority.

Tag: uk

350.000.

No, non è il numero di biscotti che un inglese medio consuma con il tè in un anno, ma il volume di richieste di pianificazione urbanistica che ogni singolo anno intasa le scrivanie, reali o virtuali, dei consigli comunali del Regno Unito. O, meglio, le intasava.

Perché ora, grazie a Gemini – il modello multimodale di Google – e un’applicazione audace chiamata Extract, quello che richiedeva due ore di maledizioni, caffè tiepido e zoom infiniti su PDF stropicciati può essere svolto in… 40 secondi. E con una precisione che farebbe arrossire l’archivista più zelante di Westminster.

Lancaster House non è solo un palazzo neoclassico con moquette spessa e stucchi dorati. Questa settimana è il set di una commedia geopolitica in stile kafkaiano: Stati Uniti e Cina fingono di negoziare, mentre tutti – loro per primi – sanno che qui non si tratta di trovare accordi, ma di decidere chi scriverà le regole dell’intelligenza artificiale, dell’export tecnologico e del controllo sulle materie prime del XXI secolo. Welcome to la nuova Guerra Fredda, versione 5G.

Non è un vertice, non è una conferenza, non c’è un comunicato ufficiale. Solo stanze chiuse, facce tese e un’unica vera valuta sul tavolo: il dominio strategico su chip, rare earths e software di progettazione avanzata. La parola “tariffa” non compare più, ha lasciato il posto a un linguaggio più crudo, chirurgico, spietato: “export controls”.

Inizia così, con l’arroganza diplomatica di chi ha imparato a parlare come un CEO dopo aver fallito come politico: Nick Clegg, ex vice primo ministro britannico e oggi cavaliere errante di Meta, sale in cattedra per spiegarci che chiedere il permesso agli artisti per usare le loro opere nei modelli di intelligenza artificiale… beh, “ucciderebbe l’industria dell’AI in UK”. Boom.

L’affermazione (The Times) suona come una minaccia mafiosa, detta col sorriso di un PR siliconizzato: “non è fattibile”, dice. Non è fattibile chiedere. Non è fattibile informare. Non è fattibile rispettare il diritto d’autore, perché l’industria dell’AI che, ricordiamolo, genera miliardi e decide chi vive o muore nel futuro dell’economia globale è fragile come un castello di carte. Basta un po’ di copyright e puff, addio all’innovazione. La parola chiave qui è: addestramento AI. Le secondarie? copyright e consenso artistico. Tre entità che non riescono a stare nella stessa frase senza esplodere.

Sei pronto per una guerra combattuta da software e sensori invece che da uomini? No? Peccato, perché il Regno Unito ha deciso che è esattamente lì che stiamo andando. Il segretario alla Difesa britannico John Healey, con una dichiarazione dal sapore vagamente apocalittico e una strategia che sembra uscita da un pitch di venture capital del 2015, ha annunciato che l’intelligenza artificiale sarà il cuore pulsante della nuova Strategic Defence Review.

Per capirci: niente più carri armati che impiegano quindici anni per arrivare (ciao, Ajax), ma algoritmi pronti in settimane, magari scritti da contractor che il giorno prima lavoravano su un’app per ordinare sushi. Il keyword principale? Intelligenza artificiale militare. Le keyword collaterali? Difesa britannica, procurement bellico. Il tono? Quello dell’urgenza tecnologica a velocità di guerra.

Il 20 marzo 2025, l’ExCeL London (Royal Victoria Dock, London) è stato il palcoscenico dell’Oracle Cloud World Tour 2025, un evento che ha catalizzato l’attenzione di leader del settore, professionisti IT e innovatori da tutto il mondo. Questo incontro ha offerto una panoramica completa sulle ultime tendenze nel cloud computing, nell’intelligenza artificiale e nelle soluzioni aziendali integrate.

Sir Keir Starmer ha promesso di rivoluzionare il settore pubblico britannico con l’intelligenza artificiale. Una narrazione affascinante, perfetta per i titoli dei giornali e per placare un elettorato sempre più insofferente verso una macchina burocratica inefficiente e costosa.

Ma la realtà è un’altra: il governo fatica persino a comprendere il funzionamento di queste tecnologie, figuriamoci ad applicarle in modo efficace.

Oggi, in un raro momento di armonia, i principali giornali britannici sono finalmente d’accordo su qualcosa. No, non è un miracolo, né un evento astrologico straordinario. È solo che le loro prime pagine sono state sommerse dallo stesso messaggio: un enorme “MAKE IT FAIR” stampato su sfondi blu, un grido disperato delle industrie creative per proteggere il diritto d’autore dallo sfruttamento selvaggio dell’intelligenza artificiale.

La trovata pubblicitaria fa parte dell’iniziativa “Make It Fair”, che cerca di convincere i lettori a difendere la creatività britannica da un piano del governo che, con il pretesto di incentivare l’innovazione, permetterebbe alle aziende di AI di addestrare i loro modelli su contenuti protetti da copyright… senza nemmeno disturbarsi a chiedere il permesso. Perché sì, l’idea brillante è quella di trasformare il lavoro di giornalisti, scrittori, musicisti e artisti in un gigantesco buffet gratuito per gli algoritmi.

Ho speso una buona parte della mia vita lavorando per Anglo Americani quello che li ha sempre caratterizzati, forse come ex potenza coloniale, è avere una Roadmap questa è la dimostrazione : Devi avere un Piano

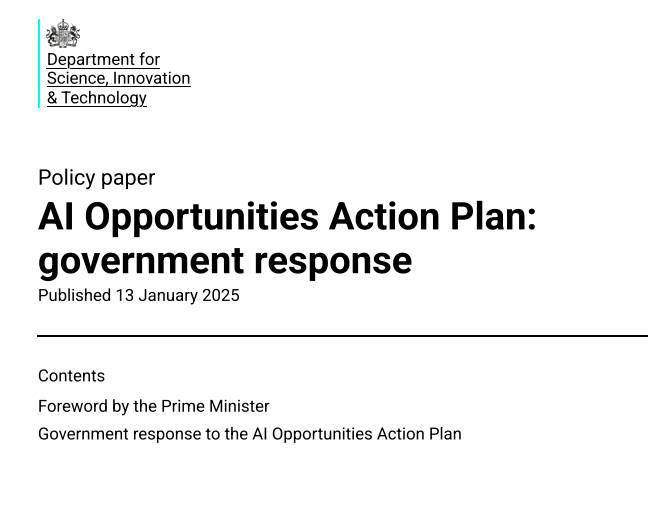

Il governo britannico ha appena rilasciato un documento di policy destinato a rafforzare la sua posizione come potenza globale nell’intelligenza artificiale. Questa iniziativa, basata su 50 misure specifiche, non è solo una dichiarazione d’intenti, ma un piano strategico ben strutturato che dimostra la volontà di guidare il futuro dell’AI con investimenti mirati, regolamentazioni intelligenti e un ecosistema favorevole all’innovazione.

A differenza dell’Europa continentale, spesso intrappolata in un labirinto normativo e burocratico che rallenta lo sviluppo tecnologico, il Regno Unito adotta un approccio pragmatico, delineando obiettivi concreti e misurabili. Questa roadmap comprende l’espansione delle capacità di calcolo, lo sviluppo di hub dedicati all’AI, la creazione di zone di crescita specializzate, incentivi alla condivisione dei dati e un investimento strategico nella formazione e nel talento.

Il panorama antitrust del Regno Unito sta vivendo un cambiamento significativo con l’inaspettata rimozione di Marcus Bokkerink, presidente della Competition and Markets Authority (CMA), sostituito ad interim da un ex dirigente di Amazon. Secondo il Financial Times, questa decisione riflette la volontà del governo britannico di favorire un approccio più orientato alla crescita economica, allineandosi così a una tendenza globale che privilegia politiche pro-business.

La CMA, nel corso degli ultimi anni, aveva acquisito una reputazione per un atteggiamento particolarmente rigido, talvolta percepito come eccessivamente conservatore e poco pragmatico. Un esempio eclatante è stato il caso che ha visto Meta Platforms costretta a vendere Giphy. Nonostante si trattasse di una piattaforma americana che non generava ricavi nel Regno Unito al momento dell’acquisizione, la CMA giustificò la sua decisione sostenendo che Giphy avrebbe potuto, in futuro, rappresentare un potenziale concorrente per Meta. Questo tipo di ragionamenti prospettici, privi di un impatto tangibile immediato, hanno generato critiche sulla rigidità dell’approccio dell’ente.

Il governo del Regno Unito sta lanciando un’innovativa iniziativa per integrare l’intelligenza artificiale (AI) nei propri processi burocratici e amministrativi, chiamata “Humphrey”.

Il nome, dal richiamo volutamente britannico, fa riferimento al celebre personaggio della sitcom degli anni ’80 “Yes Minister”, un omaggio ironico alla politica e alla burocrazia del paese.

Il governo britannico sta preparando un piano per incrementare di venti volte la capacità di calcolo sovrana del Paese, con l’obiettivo di raggiungere 100.000 unità di elaborazione grafica (GPU) controllate dallo Stato per scopi accademici e di ricerca entro il 2030. L’iniziativa, derivante da un rapporto commissionato al consulente Matt Clifford, mira a potenziare l’ecosistema dell’intelligenza artificiale nel Regno Unito e a rafforzare la sua posizione nell’economia globale dell’IA.

L’amministrazione stima che l’intelligenza artificiale possa aggiungere 47 miliardi di sterline (57 miliardi di dollari) all’anno all’economia del Regno Unito nei prossimi dieci anni. In particolare, aziende tecnologiche come Vantage Data Centres, Nscale e Kyndryl hanno promesso investimenti per 14 miliardi di sterline nell’IA nel Regno Unito, con la possibilità di generare oltre 13.000 nuovi posti di lavoro.

Il CEO di Apple, Tim Cook, ha recentemente incontrato il Primo Ministro britannico Rishi Sunak per discutere dell’impegno strategico dell’azienda nel Regno Unito, che ha ormai superato i 18 miliardi di sterline di investimenti dal 2019. Questo sforzo ha generato oltre 550.000 posti di lavoro diretti e indiretti, coinvolgendo settori che spaziano dall’ingegneria ai contenuti creativi, come la produzione di Apple TV+.

Nel pieno della corsa agli armamenti digitali alimentata dall’intelligenza artificiale, il Regno Unito si posiziona in prima linea annunciando il Laboratory for AI Security Research (LASR), una nuova iniziativa strategica progettata per affrontare le minacce provenienti da Russia e altri attori ostili. Con un finanziamento iniziale di 8,22 milioni di sterline (10,3 milioni di dollari), questa struttura mira a rafforzare la sicurezza nazionale attraverso collaborazioni pubblico-private e un modello di “finanziamento catalitico“.

Il governo del Regno Unito ha recentemente pubblicato un rapporto sul mercato dell’assicurazione dell’intelligenza artificiale (AI), evidenziando che questo settore potrebbe crescere fino a 6,5 miliardi di sterline entro il 2035. Questo sviluppo è parte di un’iniziativa più ampia per garantire la sicurezza e l’affidabilità dei sistemi AI, che sono sempre più integrati nelle operazioni quotidiane delle aziende.

Il Regno Unito si prepara a svelare un’importante serie di annunci strategici sull’intelligenza artificiale (IA) nel mese di novembre, con l’obiettivo di rafforzare la propria posizione come leader globale nell’innovazione tecnologica. In un contesto di crescente competizione internazionale, il governo britannico si propone di attirare talenti di alto livello e incentivare l’adozione di soluzioni IA nei settori chiave dell’economia. Secondo quanto riportato dal Financial Times, l’iniziativa centrale di questi annunci sarà il Piano d’azione per le opportunità di intelligenza artificiale, firmato da Matt Clifford, il principale consigliere del primo ministro Rishi Sunak per le politiche di intelligenza artificiale.

La Gran Bretagna sta intensificando i propri sforzi per regolamentare i grandi modelli linguistici, cercando di instaurare un controllo stringente sul potere crescente delle tecnologie IA. In una mossa che mette in evidenza un impegno serio verso la sicurezza nazionale e sociale, il ministro della tecnologia Peter Kyle ha avviato un dialogo diretto con i giganti della Silicon Valley, discutendo le misure che il nuovo governo laburista intende adottare per tutelare il pubblico dai rischi emergenti associati ai modelli di frontiera dell’intelligenza artificiale.

Negli ultimi anni, il progresso nell’Intelligenza Artificiale ha iniziato a trasformare ogni settore della società e a riscrivere le regole del conflitto e della sicurezza internazionale. In questo articolo, esploreremo le implicazioni per la Difesa e analizzeremo come il Ministero della Difesa del Regno Unito (MOD UK) stia rivalutando le sue priorità alla luce del rapido sviluppo dell’AI e dell’AGI (Intelligenza Artificiale Generale). Questo tema non riguarda solo il futuro prossimo, ma avrà effetti strategici di vasta portata fino al 2050 e oltre, ridefinendo la natura della guerra e la sicurezza globale.

CoreWeave, un fornitore di cloud specializzato sostenuto da Nvidia, è tra le aziende che hanno annunciato un investimento complessivo di 8,2 miliardi di dollari nei data center nel Regno Unito. Questo investimento segna un passo significativo nella crescita dell’infrastruttura AI nel paese, contribuendo a rafforzare la posizione del Regno Unito come hub tecnologico.

La tecnologia sta prendendo sempre più piede nelle decisioni strategiche di molti governi, e il Regno Unito non fa eccezione. In un passaggio epocale per la gestione della difesa nazionale, il governo britannico sta utilizzando l’intelligenza artificiale (AI) per elaborare la sua revisione delle capacità militari, segnando una svolta radicale nel funzionamento del Ministero della Difesa e di Whitehall. Questa revisione della difesa, considerata uno dei documenti più importanti del periodo post-Brexit, mira a ridefinire le strategie militari del paese in un contesto globale sempre più incerto.

Peter John Kyle (nato il 9 settembre 1970) è un politico britannico che è

Segretario di Stato per la scienza, l’innovazione e la tecnologia dal luglio 2024.

Recentemente, il Segretario Peter Kyle ha partecipato a un evento del Washington Post a Londra, dove ha discusso le sfide e le opportunità legate all’intelligenza artificiale (IA). Questo articolo esplorerà le sue posizioni e il contesto attuale della regolamentazione dell’IA, evidenziando l’importanza di un approccio equilibrato che consideri sia la sicurezza che le opportunità offerte da questa tecnologia.

Il ministro britannico per l’intelligenza artificiale, Feryal Clark, ha recentemente fatto un passo indietro riguardo alla proposta di una nuova legislazione sul copyright per l’addestramento dell’intelligenza artificiale (IA). In una dichiarazione, Clark ha affermato che il governo sta cercando “una via da seguire” che potrebbe non richiedere necessariamente l’introduzione di leggi specifiche. Questo cambiamento di direzione è significativo, considerando le crescenti preoccupazioni espresse dai settori creativi riguardo all’uso di contenuti protetti da copyright da parte degli sviluppatori di IA.

Google ha avvertito che il Regno Unito rischia di essere “lasciato indietro” nella competizione globale per l’intelligenza artificiale (AI) se non si investe nella costruzione di nuovi centri dati. Questo avviso arriva in un contesto di crescente preoccupazione per l’infrastruttura necessaria a supportare le crescenti esigenze energetiche e computazionali delle tecnologie AI.

Il governo del Regno Unito ha annunciato un progetto, primo nel suo genere, da 4 milioni di sterline per potenziare gli strumenti di Intelligenza Artificiale a supporto degli insegnanti nella pianificazione delle lezioni e nella correzione dei compiti.

Il mercato dell’Intelligenza Artificiale in Gran Bretagna vale più di 16,8 miliardi di sterline e si prevede che crescerà fino a 801,6 miliardi di sterline entro il 2035, mentre il numero di aziende operanti sul campo nel Paese è aumentato di oltre il 600% negli ultimi 10 anni. Secondo una ricerca governativa, il 68% delle grandi aziende, il 33% delle aziende di media grandezza e il 15% delle piccole hanno adottato almeno una tecnologia basata sull’Intelligenza Artificiale.

Amazon Web Services ha annunciato un investimento di 8 miliardi di sterline nel Regno Unito nei prossimi cinque anni, come parte di un ambizioso piano di espansione dell’infrastruttura dei data center nel Paese.

L’Autorità per la concorrenza e i mercati del Regno Unito (CMA) ha approvato il piano di Microsoft di assumere il team di Inflection AI, classificando l’accordo come una “fusione” piuttosto che un semplice processo di assunzione. Questa classificazione consente alla CMA di monitorare più da vicino le implicazioni dell’accordo, garantendo che non influisca negativamente sulla concorrenza nel mercato dell’IA.

Il governo del Regno Unito ha annunciato un investimento di circa 90 milioni di sterline (113 milioni di dollari) per la creazione di nove nuovi centri di ricerca e per una partnership con gli Stati Uniti focalizzata sull’intelligenza artificiale responsabile.

Questi hub avranno il compito di potenziare le competenze britanniche in intelligenza artificiale nei settori della sanità, chimica, matematica e altri ambiti.Inoltre, sono previsti circa 2 milioni di sterline (2,5 milioni di dollari) di finanziamenti dall’Arts and Humanities Research Council per sostenere progetti di ricerca volti a definire l’intelligenza artificiale responsabile in settori come l’istruzione, la polizia e le industrie creative.

Ulteriori 19 milioni di sterline (23,8 milioni di dollari) saranno destinati a 21 progetti orientati allo sviluppo di soluzioni di apprendimento automatico e intelligenza artificiale responsabilità.Il governo ha anche annunciato la creazione di un comitato direttivo per supportare le attività di regolamentazione, che inizieranno a operare in primavera.

Questo passo è parte di un’iniziativa più ampia, che include l’AI Safety Institute, istituito con un budget di 100 milioni di sterline (125,5 milioni di dollari) per valutare i rischi associati ai nuovi modelli di intelligenza artificiale.

Tuttavia, alcuni esperti, come Tamara Quinn dello studio legale Osborne Clarke, hanno espresso delusione per l’assenza di misure più incisive, sottolineando che l’approccio del governo sembra concentrarsi troppo su regolatori esistenti piuttosto che su nuove legislazioni.

Il governo ha stanziato anche 10 milioni di sterline (12,5 milioni di dollari) per migliorare le competenze degli enti regolatori, che dovranno presentare entro il 30 aprile i loro piani per la gestione dei rischi legati all’intelligenza artificiale.

Gli analisti di Jefferies hanno stilato 10 politiche attuabili e le relative implicazioni azionarie nel caso in cui Kamala Harris vincesse il seggio presidenziale questo novembre.

Aniket Shah, responsabile della strategia di sostenibilità e transizione, ha affermato che il suo team ha utilizzato le idee della piattaforma democratica del 2024 e le recenti dichiarazioni di Harris per delineare 10 proposte attuabili che richiedono un’azione legislativa minima.

Ascolta il podcast :

Nvidia, il produttore di chip AI, ha raggiunto una capitalizzazione di mercato di 3 trilioni di dollari questa settimana, aumentando l’entusiasmo per la London Tech Week. Londra e’ il principale hub tecnologico in Europa e secondo nel mondo, Londra ospita aziende come Microsoft AI, OpenAI e Google DeepMind

La Gran Bretagna ha deciso di ospitare il suo primo vertice globale sull’intelligenza artificiale, l’AI Safety Summit, a Bletchley Park, proprio nel sito considerato il luogo di nascita dell’informatica grazie ai progressi nei processi crittografici e di intelligence durante la Seconda Guerra Mondiale.

I timori sull’impatto che l’Intelligenza Artificiale potrebbe avere sulle economie e sulla società sono esplosi nel novembre dello scorso anno quando OpenAI ha reso disponibile al pubblico la sua tecnologia. ChatGPT, utilizzando strumenti di elaborazione del linguaggio naturale per creare un dialogo simile a quello umano, ha alimentato i timori (anche tra alcuni pionieri dell’intelligenza artificiale), che le macchine potrebbero col tempo raggiungere un’intelligenza maggiore rispetto agli umani, portando a conseguenze illimitate e non intenzionali.

Negli ultimi tempi si rileva un grande fermento sotto questo aspetto, con i Governi e la politica che stanno cercando di tracciare una via da seguire insieme alle aziende di intelligenza artificiale che temono dal canto loro di essere appesantite dalla regolamentazione prima ancora che la tecnologia raggiunga il suo pieno potenziale.

Mentre l’Unione Europea ha concentrato la sua supervisione sull’AI, l’AI Act, sui temi come la privacy, la sorveglianza dei dati e il loro potenziale impatto sui diritti umani – un po’ come fatto dall’amministrazione Biden con l’Ordine Esecutivo sull’AI – il vertice britannico ha invece come obiettivo principale quello di esaminare i cosiddetti rischi esistenziali derivanti da modelli generici altamente capaci chiamati “AI di frontiera”, anche perché la Gran Bretagna non ha in programma, almeno per il momento, una legislazione specifica per regolamentare l’Intelligenza Artificiale.

Il vertice, che si è tenuto il 1° e 2 novembre scorsi, nasce per volontà del primo ministro britannico Rishi Sunak, che vorrebbe ritagliare per la Gran Bratagna post-Brexit un ruolo come intermediario tra i blocchi economici di Stati Uniti, Cina e UE.

Anche se l’evento è stato un po’ offuscato dalla decisione della vicepresidente americana Kamala Harris di tenere un discorso a Londra proprio il giorno di inizio del summit sulla risposta del suo governo all’intelligenza artificiale, esponendo la sua visione su come il mondo dovrebbe governare questa tecnologia (e auspicando che tutti i Paesi aderiscano all’approccio USA su questa tematica), il Summit ha comunque avuto il merito di coinvolgere anche la Cina, un partecipante chiave al vertice, dato il ruolo del Paese nello sviluppo dell’Intelligenza Artificiale, sia pure con il solito doppio standard di Pechino.

Alla fine, sebbene ogni delegazione presente fosse ansiosa di rivendicare la propria preminenza nella regolamentazione dell’IA, i rappresentanti dei 25 Paesi partecipanti, assieme ad altri attori pubblici e privati, tra cui il segretario generale dell’Onu, Antònio Guterres e la presidente della Commissione europea, Ursula Von der Leyen, hanno firmato la “Dichiarazione di Bletchley” in cui si afferma che i Paesi devono lavorare insieme e stabilire un approccio comune sulla supervisione.

La dichiarazione definisce un’agenda su due fronti incentrata sull’identificazione dei rischi di preoccupazione condivisa e sulla costruzione della loro comprensione scientifica, sviluppando allo stesso tempo politiche transnazionali per mitigarli.

Difficile in ogni caso dire se la Gran Bretagna a guida Sunak possa davvero riuscire a ritagliarsi un ruolo nella corsa a mettere il cappello sulla regolamentazione di un tema come quello dell’Intelligenza Artificiale dove ognuno, singoli Paesi come gli USA ma anche organizzazioni, come l’Onu, l’UE e il G7 vogliono affermare la propria leadership.

L’AI Safety Summit sull’Intelligenza Artificiale, organizzato dal Primo Ministro inglese Rishi Sunak si è concluso con un accordo noto come la Dichiarazione di Bletchley, che mira a gestire i rischi dell’IA e a promuovere la collaborazione attraverso organizzazioni internazionali esistenti e nuove iniziative.

Quali sono i punti Chiave della Dichiarazione di Bletchley

La Dichiarazione di Bletchley traccia una visione condivisa per promuovere la sicurezza e le considerazioni etiche nello sviluppo e nell’implementazione dell’Intelligenza Artificiale (IA).

Di seguito i principi fondamentali inclusi nella dichiarazione:

Cooperazione Internazionale

Si pone un forte accento sulla promozione della cooperazione internazionale per affrontare il complesso panorama della sicurezza dell’IA. La dichiarazione sottolinea la necessità di un fronte unito nel far fronte alle sfide e nel sfruttare le opportunità che l’IA presenta su scala globale.

Standard di Sicurezza

La dichiarazione sostiene l’istituzione e l’adesione a standard di sicurezza elevati nella progettazione, sviluppo e implementazione dei sistemi di IA. Ciò include un impegno condiviso a ridurre i rischi associati all’IA e assicurare che queste tecnologie siano sviluppate con un approccio orientato alla sicurezza.

IA Etica

Una forte bussola morale guida la dichiarazione, enfatizzando l’importanza delle considerazioni etiche nell’IA. Questo include assicurare che le tecnologie di IA rispettino i diritti umani, la privacy e i valori democratici, promuovendo un approccio centrato sull’essere umano all’IA.

Trasparenza e Responsabilità

La dichiarazione mette in luce anche l’importanza critica della trasparenza e della responsabilità nei sistemi di IA. Questo è visto come un pilastro fondamentale per costruire la fiducia e la comprensione del pubblico, essenziali per l’integrazione di successo delle tecnologie di IA nella società.

Condivisione della Conoscenza

L’incoraggiamento alla condivisione della conoscenza e alla ricerca collaborativa tra le nazioni è un aspetto chiave della dichiarazione. Questo mira ad accelerare la comprensione globale e la mitigazione dei rischi legati all’IA, promuovendo una cultura di apprendimento condiviso e miglioramento continuo nelle pratiche di sicurezza dell’IA.

Sotto il testo integrale della Dichiarazione di Bletchley:

“L’intelligenza artificiale (AI) presenta enormi opportunità globali: ha il potenziale per trasformare e migliorare il benessere umano, la pace e la prosperità. Per realizzare ciò, affermiamo che, per il bene di tutti, l’intelligenza artificiale dovrebbe essere progettata, sviluppata, implementata e utilizzata in modo sicuro, in modo tale da essere incentrata sull’uomo, affidabile e responsabile. Accogliamo con favore gli sforzi compiuti finora dalla comunità internazionale per cooperare sull’intelligenza artificiale per promuovere la crescita economica inclusiva, lo sviluppo sostenibile e l’innovazione, per proteggere i diritti umani e le libertà fondamentali e per promuovere la fiducia del pubblico nei sistemi di intelligenza artificiale per realizzare appieno il loro potenziale.

I sistemi di intelligenza artificiale sono già utilizzati in molti ambiti della vita quotidiana, tra cui alloggio, occupazione, trasporti, istruzione, sanità, accessibilità e giustizia, e il loro utilizzo è destinato ad aumentare. Riconosciamo che questo è quindi un momento unico per agire e affermare la necessità di uno sviluppo sicuro dell’IA e di utilizzare le opportunità di trasformazione dell’IA per il bene e per tutti, in modo inclusivo nei nostri paesi e a livello globale. Ciò include servizi pubblici come sanità e istruzione, sicurezza alimentare, scienza, energia pulita, biodiversità e clima, per realizzare il godimento dei diritti umani e per rafforzare gli sforzi verso il raggiungimento degli obiettivi di sviluppo sostenibile delle Nazioni Unite.

Oltre a queste opportunità, l’intelligenza artificiale comporta anche rischi significativi, anche negli ambiti della vita quotidiana. A tal fine, accogliamo con favore gli sforzi internazionali volti a esaminare e affrontare il potenziale impatto dei sistemi di intelligenza artificiale nei forum esistenti e in altre iniziative pertinenti, e il riconoscimento che la tutela dei diritti umani, la trasparenza e la spiegabilità, l’equità, la responsabilità, la regolamentazione, la sicurezza, un’adeguata È necessario affrontare il problema del controllo umano, dell’etica, della mitigazione dei pregiudizi, della privacy e della protezione dei dati. Notiamo inoltre i potenziali rischi imprevisti derivanti dalla capacità di manipolare contenuti o generare contenuti ingannevoli. Tutte queste questioni sono di fondamentale importanza e affermiamo la necessità e l’urgenza di affrontarle.

Particolari rischi per la sicurezza emergono alla “frontiera” dell’IA , intesa come quei modelli di IA per scopi generali altamente capaci , compresi i modelli di base, che potrebbero svolgere un’ampia varietà di compiti, così come l’ IA specifica e ristretta che potrebbe mostrare capacità che causano danno – che corrispondono o superano le capacità presenti nei modelli più avanzati di oggi. Rischi sostanziali possono derivare da un potenziale uso improprio intenzionale o da problemi di controllo non intenzionali relativi all’allineamento con l’intento umano. Questi problemi sono in parte dovuti al fatto che tali capacità non sono completamente comprese e sono quindi difficili da prevedere. Siamo particolarmente preoccupati da tali rischi in settori quali la sicurezza informatica e la biotecnologia, nonché laddove i sistemi di intelligenza artificiale di frontiera possono amplificare rischi come la disinformazione. Esiste il rischio di danni gravi, persino catastrofici, deliberati o involontari, derivanti dalle capacità più significative di questi modelli di intelligenza artificiale . Dato il tasso di cambiamento rapido e incerto dell’intelligenza artificiale e nel contesto dell’accelerazione degli investimenti nella tecnologia, affermiamo che approfondire la nostra comprensione di questi potenziali rischi e delle azioni per affrontarli è particolarmente urgente.

Molti rischi derivanti dall’intelligenza artificiale sono intrinsecamente di natura internazionale e quindi possono essere affrontati meglio attraverso la cooperazione internazionale. Decidiamo di lavorare insieme in modo inclusivo per garantire un’IA incentrata sull’uomo, affidabile e responsabile che sia sicura e sostenga il bene di tutti attraverso i forum internazionali esistenti e altre iniziative pertinenti, per promuovere la cooperazione per affrontare l’ampia gamma di rischi posti da AI . In tal modo, riconosciamo che i paesi dovrebbero considerare l’importanza di una governance e di un approccio normativo proporzionato e pro-innovazione che massimizzi i benefici e tenga conto dei rischi associati all’intelligenza artificiale . Ciò potrebbe includere, ove opportuno, classificazioni e categorizzazioni dei rischi basate sulle circostanze nazionali e sui quadri giuridici applicabili. Notiamo inoltre l’importanza della cooperazione, ove opportuno, su approcci quali principi comuni e codici di condotta. Per quanto riguarda i rischi specifici riscontrati molto probabilmente in relazione all’IA di frontiera, decidiamo di intensificare e sostenere la nostra cooperazione e di ampliarla con altri paesi, per identificare, comprendere e, se del caso, agire, attraverso i forum internazionali esistenti e altre iniziative pertinenti, tra cui futuri vertici internazionali sulla sicurezza dell’intelligenza artificiale .

Tutti gli attori hanno un ruolo da svolgere nel garantire la sicurezza dell’IA : le nazioni, i forum internazionali e altre iniziative, le aziende, la società civile e il mondo accademico dovranno lavorare insieme. Rilevando l’importanza di un’intelligenza artificiale inclusiva e di colmare il divario digitale, riaffermiamo che la collaborazione internazionale dovrebbe cercare di coinvolgere un’ampia gamma di partner, a seconda dei casi, e accogliere con favore approcci e politiche orientati allo sviluppo che potrebbero aiutare i paesi in via di sviluppo a rafforzare lo sviluppo e l’effetto leva delle capacità dell’intelligenza artificiale . il ruolo abilitante dell’intelligenza artificiale per sostenere la crescita sostenibile e colmare il divario di sviluppo.

Affermiamo che, sebbene la sicurezza debba essere considerata in tutto il ciclo di vita dell’IA , gli attori che sviluppano capacità di IA di frontiera , in particolare quei sistemi di IA insolitamente potenti e potenzialmente dannosi, hanno una responsabilità particolarmente forte nel garantire la sicurezza di questi sistemi di IA , anche attraverso sistemi per i test di sicurezza, attraverso valutazioni e altre misure appropriate. Incoraggiamo tutti gli attori rilevanti a fornire trasparenza e responsabilità adeguate al contesto sui loro piani per misurare, monitorare e mitigare le capacità potenzialmente dannose e gli effetti associati che potrebbero emergere, in particolare per prevenire abusi e problemi di controllo e l’amplificazione di altri rischi.

Nel contesto della nostra cooperazione, e per informare l’azione a livello nazionale e internazionale, la nostra agenda per affrontare il rischio dell’IA di frontiera si concentrerà su:

- identificare i rischi per la sicurezza dell’IA di interesse condiviso, costruire una comprensione scientifica condivisa e basata sull’evidenza di questi rischi e sostenere tale comprensione mentre le capacità continuano ad aumentare, nel contesto di un approccio globale più ampio alla comprensione dell’impatto dell’IA nelle nostre società .

- costruendo rispettive politiche basate sul rischio in tutti i nostri paesi per garantire la sicurezza alla luce di tali rischi, collaborando in modo appropriato e riconoscendo che i nostri approcci possono differire in base alle circostanze nazionali e ai quadri giuridici applicabili. Ciò include, oltre a una maggiore trasparenza da parte degli attori privati che sviluppano capacità di intelligenza artificiale di frontiera , parametri di valutazione adeguati, strumenti per test di sicurezza e lo sviluppo di capacità pertinenti del settore pubblico e della ricerca scientifica.

A sostegno di questo programma, decidiamo di sostenere una rete inclusiva a livello internazionale di ricerca scientifica sulla sicurezza dell’IA di frontiera che comprenda e integri la collaborazione multilaterale, plurilaterale e bilaterale esistente e nuova, anche attraverso forum internazionali esistenti e altre iniziative pertinenti, per facilitare la fornitura di la migliore scienza disponibile per l’elaborazione delle politiche e il bene pubblico.

Riconoscendo il potenziale positivo di trasformazione dell’IA e come parte della garanzia di una più ampia cooperazione internazionale sull’IA , decidiamo di sostenere un dialogo globale inclusivo che coinvolga i forum internazionali esistenti e altre iniziative pertinenti e contribuisca in modo aperto a discussioni internazionali più ampie, e continuare la ricerca sulla sicurezza dell’IA di frontiera per garantire che i vantaggi della tecnologia possano essere sfruttati in modo responsabile per il bene e per tutti. Non vediamo l’ora di incontrarci di nuovo nel 2024″.

La Gran Bretagna ha deciso di ospitare il suo primo vertice globale sull’intelligenza artificiale (l’AI Safety Summit) a Bletchley Park, nel sito considerato il luogo di nascita dell’informatica grazie ai progressi nei processi crittografici e di intelligence durante la Seconda Guerra Mondiale.

Durante la II guerra mondiale, un gruppo di matematici, crittografi, esperti in enigmistica e maestri di scacchi si riunirono in una casa di campagna vittoriana a 45 miglia a nord-ovest di Londra per intraprendere una guerra segreta contro la Germania nazista. Il loro obiettivo: decifrare i codici inviolabili di Adolf Hitler.

L’impresa più famosa di Bletchley Park fu quella di superare in astuzia la macchina di crittografia tedesca Enigma, che produceva un codice in costante cambiamento ed era ampiamente considerata indecifrabile. Per riuscirci, il matematico Alan Turing sviluppò una macchina considerata il precursore dei computer moderni.

I messaggi Enigma decifrati rivelarono dettagli sui movimenti delle flotte di sottomarini tedeschi e fornirono informazioni cruciali per la campagna nel deserto del Nord Africa e l’invasione alleata della Francia. Alcuni storici sostengono che decifrare il codice abbia contribuito ad abbreviare la guerra fino a due anni.

Il lavoro a Bletchley Park ha accelerato lo sviluppo dell’informatica. Gli scienziati che vi lavoravano costruirono quella che può essere considerata come la prima generazione di computer praticamente dal nulla.

Quando finì la guerra, i decifratori tornarono alla vita civile, giurando di mantenere il segreto sul loro lavoro in quel posto. Fu solo negli anni ’70 che quanto successo a Bletchley Park divenne ampiamente conosciuta in Gran Bretagna e nel mondo.

Non c’è da sorprendersi quindi se Bletchley Park, aperto come museo nel 1994 e riportato al suo aspetto degli anni ’40, completo di macchine da scrivere manuali, telefoni d’epoca e tazze smaltate, si stato scelto come sede del primo vertice internazionale sull’Intelligenza Artificiale dal primo ministro britannico Rishi Sunak, che vorrebbe ritagliare per il suo Paese un ruolo post-Brexit come intermediario tra i blocchi economici di Stati Uniti, Cina e UE.