Dopo un negoziato fiume durato oltre 36 ore i politici e i legislatori dell’Unione europea hanno raggiunto venerdì un accordo sul primo insieme completo di norme al mondo che regolano l’uso dell’Intelligenza Artificiale.

Nelle prossime settimane verranno elaborati i dettagli di quello che di fatto può essere definito un accordo politico, che dovrà poi passare dall’approvazione finale degli Stati membri oltre che dal Parlamento europeo.

I punti chiave su cui si è arrivati ad un accordo riguardano principalmente i cosidetti sistemi ad alto rischio, quelli che si ritiene possano avere una significativa potenzialità potenziale di nuocere alla salute, alla sicurezza, ai diritti fondamentali, all’ambiente, alla democrazia, alle elezioni e allo Stato di diritto. Questi sistemi, in particolare, dovranno rispettare una serie di requisiti e sono previsti una serie di obblighi nei confronti dei fornitori e dei sviluppatori di sistemi di IA a seconda dei livelli di rischio identificati.

I sistemi di intelligenza artificiale che si ritiene presentino rischi limitati sarebbero soggetti a obblighi di trasparenza molto leggeri, come etichette informative che dichiarino che il contenuto è stato generato dall’intelligenza artificiale per consentire agli utenti di decidere come utilizzarlo.

Uno dei capitoli più importanti, su cui il negoziato si è incagliato per ore, è quello delle pratiche di AI vietate perché potenzialmente in grado di minare i diritti fondamentali, come il divieto di sistemi di identificazione biometrica in tempo reale e a distanza, come il riconoscimento facciale, il cui uso sarà limitato a casi specifici.

L’uso di sistemi di identificazione biometrica remota in tempo reale negli spazi pubblici da parte delle forze dell’ordine sarà consentito solo per aiutare a identificare le vittime di rapimenti, tratta di esseri umani, sfruttamento sessuale e per prevenire una minaccia terroristica specifica e attuale. Sarà inoltre autorizzato per rintracciare persone sospettate di reati di terrorismo, tratta, sfruttamento sessuale, omicidio, rapimento, stupro, rapina a mano armata, partecipazione a un’organizzazione criminale e crimini ambientali.

Tra i punti controversi, anche quello sui modelli di fondazione come GPT-4, alla base di ChatGPT. L’accordo prevede obblighi più stringenti per i modelli ad alto impatto con rischio sistemico che saranno soggetti a requisiti di trasparenza come la stesura di documentazione tecnica, il rispetto della normativa UE sul copyright e la diffusione di riepiloghi dettagliati sui contenuti utilizzati per la formazione degli algoritmi.

Sono invece espressamente proibite attività come i sistemi di categorizzazione biometrica che utilizzano caratteristiche sensibili come convinzioni politiche, religiose, filosofiche, orientamento sessuale e razza; il recupero non mirato di immagini facciali da Internet o tramite filmati di video sorveglianza per creare database di riconoscimento facciale; il riconoscimento delle emozioni sul posto di lavoro e nelle scuole; il punteggio sociale basato sul comportamento sociale o sulle caratteristiche personali (come invece avviene in Cina); i sistemi di intelligenza artificiale che manipolano il comportamento umano per aggirare il loro libero arbitrio e, più in generale, tutte quelle applicazioni dell’AI volte a sfruttare le vulnerabilità delle persone a causa della loro età, disabilità, situazione sociale o economica.

“L’UE diventa il primo continente a stabilire regole chiare per l’uso dell’intelligenza artificiale“, ha scritto su X il commissario per il mercato interno Thierry Breton, secondo cui l’AI Act “è molto più di un regolamento: è un trampolino di lancio per startup e ricercatori dell’UE per guidare la corsa globale all’intelligenza artificiale”.

Dello stesso tono anche il commento di uno dei correlatori della legge sull’Intelligenza Artificiale, il deputato Dragoș Tudorache: “Siamo i primi al mondo a mettere in atto una vera regolamentazione per il futuro mondo digitale guidato dall’intelligenza artificiale, guidando lo sviluppo e evoluzione di questa tecnologia in una direzione incentrata sull’uomo.“

Tuttavia non mancano reazioni critiche come quella del deputato del Ppe Axel Voss che si è detto “non convintoche questo sia il modo giusto per garantire che l’Europa rimanga competitiva nell’IA. L’innovazione si farà comunque altrove“.

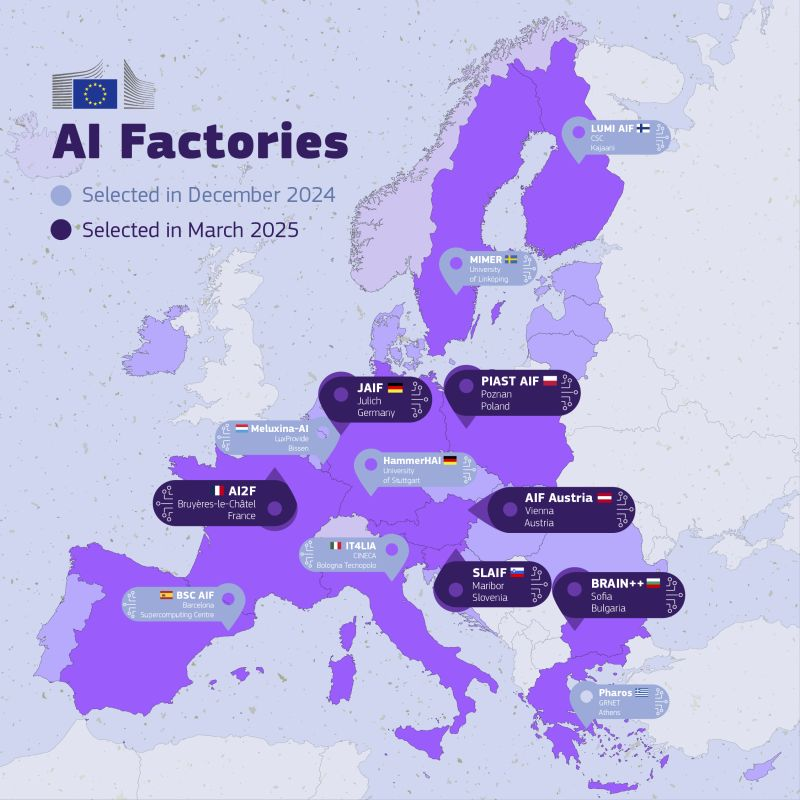

E il punto forse è proprio questo. L’Europa ha sicuramente vinto la gara per legiferare in materia di Intelligenza Artificiale, ma l’innovazione su questo campo si sta facendo altrove, negli Stati Uniti e in Cina. Bene guardare ad uno sviluppo responsabile dell’Intelligenza Artificiale che, come tutte le tecnologie va prima o poi regolamentata. Ma occorre anche che non si mettano troppi vincoli alle aziende europee che già sono destinate a rincorrere, perché il Vecchio Continente su questo tema non è competitivo. Non si parla poi di investimenti, di una cornice unica europea in grado di favorire la ricerca e lo sviluppo in questo ambito, con finanziamenti e interventi nel capitale di rischio di start up e piccole imprese. Perché altrimenti, ancora una volta, l’Europa rischia di perdere il treno dell’innovazione, così come è già stato per Internet e per i Social.